今日,腾讯在X平台上正式宣布推出其最新AI模型Hunyuan-TurboS,这款被誉为“首款超大型Hybrid-Transformer-Mamba MoE模型”的产品迅速引发全球科技圈的热议。根据X用户披露的信息,Hunyuan-TurboS通过融合Mamba的高效长序列处理能力和Transformer的强大上下文理解能力,成功克服了传统纯Transformer模型在长文本训练和推理上的瓶颈,展现出令人瞩目的性能突破。

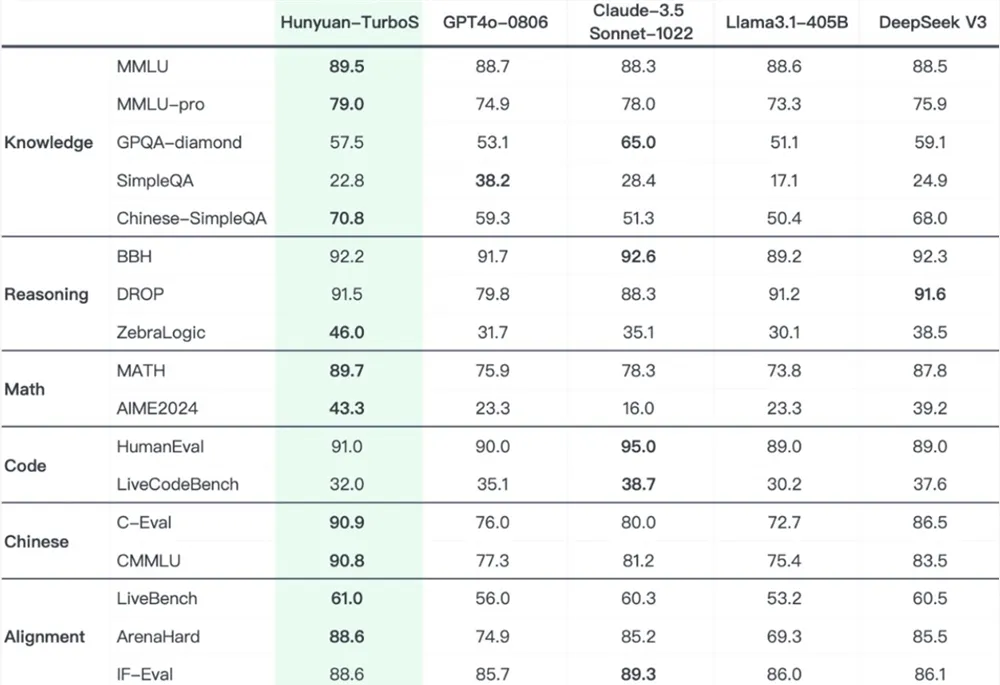

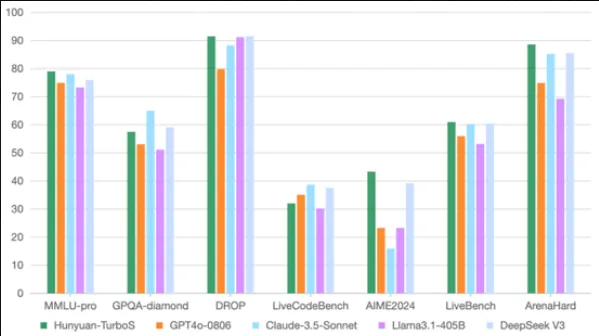

据介绍,传统Transformer模型因O(N²)复杂度和KV-Cache问题,在处理长文本时往往面临效率低下和高成本的挑战。而Hunyuan-TurboS巧妙结合了两大技术优势,不仅大幅提升了计算效率,还在多项关键基准测试中超越了业界顶尖模型。X用户bayrashad指出,该模型在数学、推理和对齐性(Alignment)上击败了GPT-4o-0806、DeepSeek-V3以及多个开源模型,同时在知识领域(包括MMLU-Pro基准)也表现出强劲竞争力。此外,其推理成本仅为前代Turbo模型的七分之一,显示出极高的性价比。

Hunyuan-TurboS的成功离不开腾讯在后训练阶段的全面优化。据csdognin在X上的帖子透露,该模型整合了“慢思考”机制,显著提升了数学、编程和推理能力;通过精细化的指令调整,进一步增强了对齐性和智能代理执行效率;同时针对英语训练的优化也使其通用性能更上一层楼。更值得一提的是,腾讯为Hunyuan-TurboS升级了奖励系统,采用基于规则的评分、一致性验证以及代码沙盒反馈机制,确保了在STEM(科学、技术、工程和数学)领域的更高准确性。此外,生成式奖励机制的引入有效提升了问答质量和创造力,同时减少了奖励操控的风险。

业界对Hunyuan-TurboS的发布反响热烈。X用户koltregaskes称其为“AI未来的象征”,而ANDREW_FDWT则强调了其技术创新对长文本处理的革命性意义。有分析人士指出,Hunyuan-TurboS的亮相不仅巩固了腾讯在全球AI竞赛中的地位,也为高效、低成本AI模型的发展树立了新标杆。

目前,腾讯尚未公布Hunyuan-TurboS的具体开源计划或商业部署细节,但其卓越性能已足以引发业界期待。正如csdognin在帖子中所言:“AI的未来已来!”这款模型的问世无疑将推动人工智能技术迈向新的高度,为学术研究和产业应用带来更多可能性。