主动学习

谷歌推出新方法:训练数据量减少 1 万倍,提升模型精准度

近日,谷歌在其研究中提出了一种新颖的主动学习筛选流程,旨在大幅降低微调大型语言模型所需的训练数据量。 根据实验结果,这种方法能够将训练数据量降低至原来的1万分之一,同时提高模型与人类专家判断的一致性达65%。 在实际应用中,如广告内容分类、金融数据安全分析等领域,对高保真训练数据的需求一直很高,但筛选出符合要求的数据不仅难度大,成本也极为昂贵。

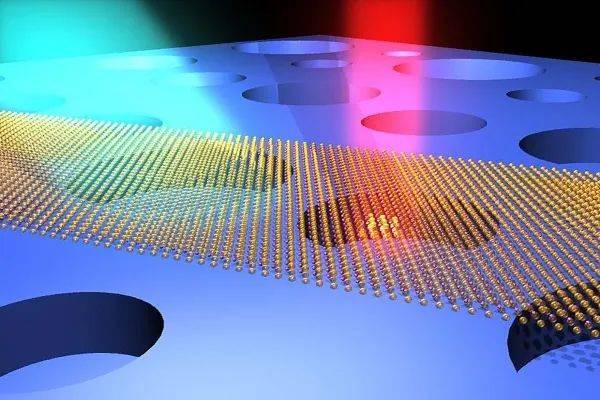

厦大团队材料预测迁移学习范式登Nature子刊,发现高性能催化剂

编辑 | KX传统的材料发现依赖反复试验或偶然发现,效率低下且成本高昂。AI 在发现新型催化剂方面潜力巨大。然而,受到算法的选择,以及数据质量和数量的影响。在此,来自厦门大学、深圳大学、武汉大学、南京航空航天大学和英国利物浦大学的研究团队开发了一种迁移学习范式,结合了预训练模型、集成学习和主动学习,能够预测未被发现的钙钛矿氧化物,并增强该反应的通用性。通过筛选 16,050 种成分,鉴定和合成了 36 种新的钙钛矿氧化物,其中包括 13 种纯钙钛矿结构。Pr0.1Sr0.9Co0.5Fe0.5O3(PSCF)和 P

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉