长度

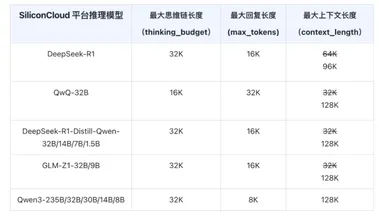

硅基流动升级DeepSeek-R1 等推理模型API ,支持 128K 上下文长度

硅基流动(SiliconCloud)宣布对其 DeepSeek-R1等推理模型 API 进行了一次重要升级,旨在更好地满足开发者对长上下文和灵活参数配置的需求。 此次升级中,多个推理模型的最大上下文长度被提升至128K,使得模型在思考时能够更加充分,输出内容也更为完整。 在此次升级中,多个知名模型,如 Qwen3、QWQ、GLM-Z1等,均支持128K 的最大上下文长度,而 DeepSeek-R1则支持96K。

想把半本《红楼梦》搬进ChatGPT输入框?先把这个问题解决掉

从 GPT-4 的 32k 到谷歌 CoLT5 的 64k 再到最新研究的 200万 token,类ChatGPT 模型们可以处理的文本长度正在急剧增加,这意味着它们的应用范围也越来越广。或许有一天,ChatGPT 能帮乔治·马丁把《冰与火之歌》(权力的游戏)写完呢?过去两年,斯坦福大学 Hazy Research 实验室一直在从事一项重要的工作:增加序列长度。 他们有一种观点:更长的序列将开启机器学习基础模型的新时代 —— 模型可以从更长的上下文、多种媒体源、复杂的演示等中学习。目前,这项研究已经取得了新进展。H

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉