尤洋

NUS尤洋教授深度探讨智能增长的瓶颈:或许我们将这样实现AGI?

2026 年即将到来,AI 的发展也已经进入了一个新的阶段:我们已经取得了惊人成就,却同时面临进一步增长的瓶颈。 新加坡国立大学(NUS)的尤洋教授近期发表了一篇深度分析:《智能增长的瓶颈》。 原文链接:,尤洋教授从技术本质出发,直指智能增长的核心矛盾,为我们揭示了 AGI(通用人工智能)的可能路径。

用扩散模型生成神经网络?NUS 尤洋团队:这不是开玩笑

作者:赖文昕编辑:郭思、陈彩娴说起扩散模型生成的东西,你会立刻想到什么? 是OpenAI的经典牛油果椅子? 是英伟达Magic3D生成的蓝色箭毒蛙?

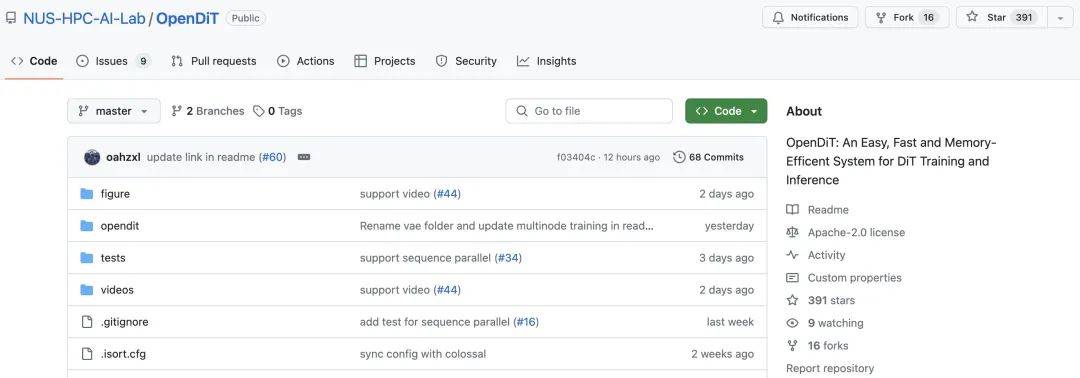

想训练类Sora模型吗?尤洋团队OpenDiT实现80%加速

作为 2024 开年王炸,Sora 的出现树立了一个全新的追赶目标,每个文生视频的研究者都想在最短的时间内复现 Sora 的效果。根据 OpenAI 披露的技术报告,Sora 的核心技术点之一是将视觉数据转化为 patch 的统一表征形式,并通过 Transformer 和扩散模型结合,展现了卓越的扩展(scale)特性。在报告公布后,Sora 核心研发成员 William Peebles 和纽约大学计算机科学助理教授谢赛宁合著的论文《Scalable Diffusion Models with Transform

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉