TVM

编译 ONNX 模型

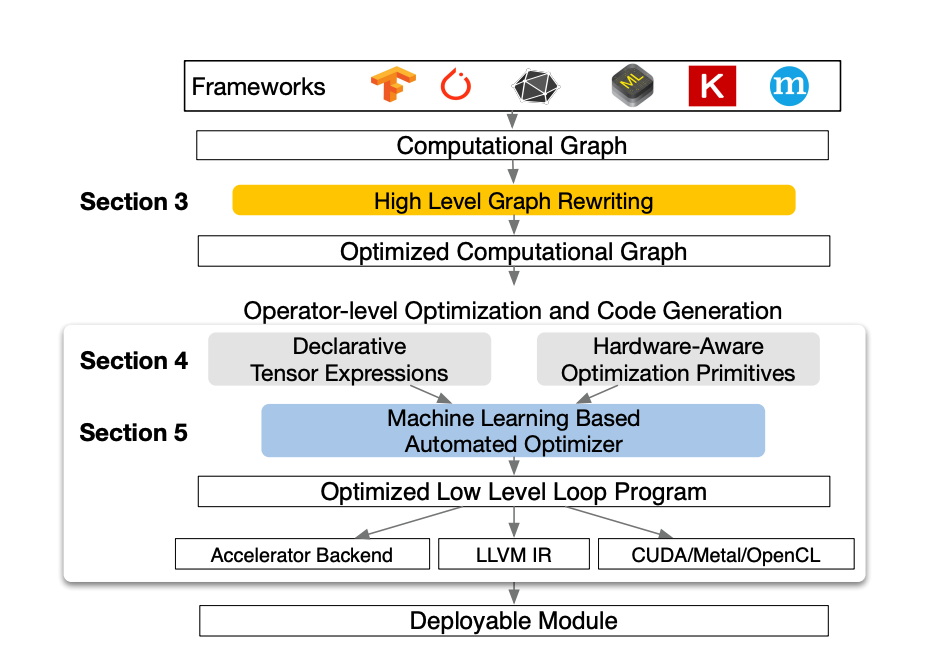

本篇文章译自英文文档Compile ONNX Models — tvm 0.13.dev0 documentation作者是 Joshua Z. Zhang更多 TVM 中文文档可访问 →Apache TVM 是一个端到端的深度学习编译框架,适用于 CPU、GPU 和各种机器学习加速芯片。 | Apache TVM 中文站。本文将介绍如何用 Relay 部署 ONNX 模型。首先安装 ONNX 包,最便捷的方法推荐安装 protobuf 编译器:或参考官方网站: ONNX 模型下面示例中的超分辨率模型与 ONNX

编译 Keras 模型

本文介绍如何用 Relay 部署 Keras 模型。

TVM 中文站正式上线!最全机器学习模型部署「参考书」它来了

内容一览:近日,由 MLC 社区志愿者共同翻译校对的 TVM 中文文档正式发布,现已托管至超神经官网 Hyper.AI。关键词:TVM 开源 机器学习编译器 本文首发自微信公众号:HyperAI超神经

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉