Reka

盛名一时的BERT哪去了?这个问题的答案昭示了LLM范式的转变

编码器模型哪去了?如果 BERT 效果好,那为什么不扩展它?编码器 - 解码器或仅编码器模型怎么样了?在大型语言模型(LLM)领域,现在是仅解码器模型(如 GPT 系列模型)独领风骚的时代。那编码器 - 解码器或仅编码器模型发展如何呢?为什么曾经盛名一时的 BERT 却渐渐少有人关注了?近日,AI 创业公司 Reka 的首席科学家和联合创始人 Yi Tay 发布了一篇博客文章,分享了他的看法。Yi Tay 在参与创立 Reka 之前曾在 Google Research 和谷歌大脑工作过三年多时间,参与过 PaLM、

三年16篇一作,前谷歌研究科学家Yi Tay官宣新模型,21B媲美Gemini Pro、GPT-3.5

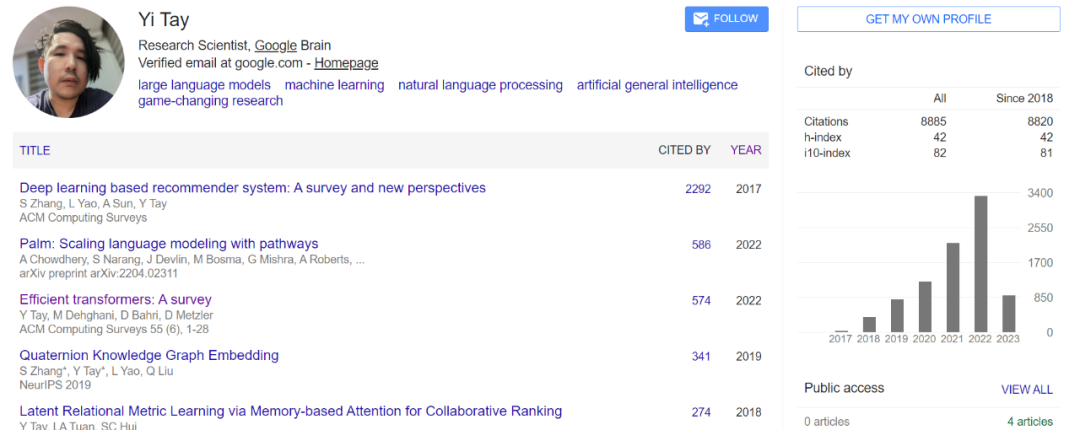

该团队的新模型在多个基准测试中都与 Gemini Pro 、GPT-3.5 相媲美。如果你经常读 AI 大模型方向的论文,Yi Tay 想必是一个熟悉的名字。作为前谷歌大脑高级研究科学家,Yi Tay 为许多知名的大型语言模型和多模态模型做出了贡献,包括 PaLM、UL2、Flan-U-PaLM、LaMDA/Bard、ViT-22B、PaLI、MUM 等。根据 Yi Tay 个人资料统计,在谷歌大脑工作的 3 年多的时间里,他总共参与撰写了大约 45 篇论文,是其中 16 篇的一作。一作论文包括 UL2、U-PaL

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉