迁移学习

终于把深度学习中的微调、提炼和迁移学习搞懂了!!!

大家好,我是小寒今天给大家分享深度学习中的三个重要知识点,微调、提炼和迁移学习在深度学习中,微调(Fine-tuning)、提炼(Distillation,即知识蒸馏)和迁移学习(Transfer Learning)是三种常见的模型优化技术,主要用于提高模型的泛化能力、减少训练时间以及优化资源利用率。 微调微调是指在一个已经训练好的模型(通常是预训练模型)的基础上,对部分或全部参数进行进一步训练,以适应特定的新任务。 通常,预训练模型是在大规模数据集(如ImageNet)上训练得到的,它能够学习到一些通用的特征。

3/3/2025 1:50:00 AM

程序员小寒

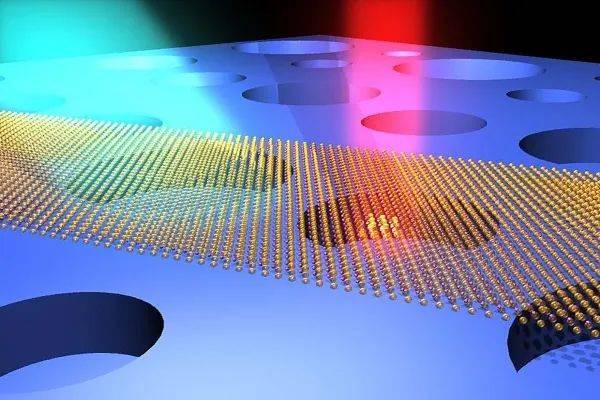

厦大团队材料预测迁移学习范式登Nature子刊,发现高性能催化剂

编辑 | KX传统的材料发现依赖反复试验或偶然发现,效率低下且成本高昂。AI 在发现新型催化剂方面潜力巨大。然而,受到算法的选择,以及数据质量和数量的影响。在此,来自厦门大学、深圳大学、武汉大学、南京航空航天大学和英国利物浦大学的研究团队开发了一种迁移学习范式,结合了预训练模型、集成学习和主动学习,能够预测未被发现的钙钛矿氧化物,并增强该反应的通用性。通过筛选 16,050 种成分,鉴定和合成了 36 种新的钙钛矿氧化物,其中包括 13 种纯钙钛矿结构。Pr0.1Sr0.9Co0.5Fe0.5O3(PSCF)和 P

7/31/2024 2:18:00 PM

ScienceAI

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI绘画

大模型

机器人

数据

AI新词

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

智能体

技术

Gemini

英伟达

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

代码

苹果

AI for Science

算法

Agent

腾讯

Claude

芯片

Stable Diffusion

具身智能

蛋白质

xAI

开发者

人形机器人

生成式

神经网络

机器学习

3D

AI视频

RAG

大语言模型

Sora

百度

研究

字节跳动

GPU

生成

工具

华为

AGI

计算

大型语言模型

AI设计

生成式AI

搜索

视频生成

亚马逊

AI模型

DeepMind

特斯拉

场景

深度学习

Transformer

架构

Copilot

MCP

编程

视觉