PowerInfer

手机流畅运行 470 亿大模型:上交大发布 LLM 手机推理框架 PowerInfer-2,提速 29 倍

苹果一出手,在手机等移动设备上部署大模型不可避免地成为行业关注焦点。然而,目前在移动设备上运行的模型相对较小(苹果的是 3B,谷歌的是 2B),并且消耗大量内存,这在很大程度上限制了其应用场景。即使是苹果,目前也需要与 OpenAI 合作,通过将云端 GPT-4o 大模型嵌入到操作系统中来提供能力更强的服务。这样一来,苹果的混合方案引起了非常多关于数据隐私的讨论和争议,甚至马斯克都下场讨论。如果苹果在操作系统层面集成 OpenAI,那么苹果设备将被禁止在我的公司使用。这是不可接受的安全违规行为。既然终端侧本地部署大

4090成A100平替?token生成速度只比A100低18%,上交大推理引擎火了

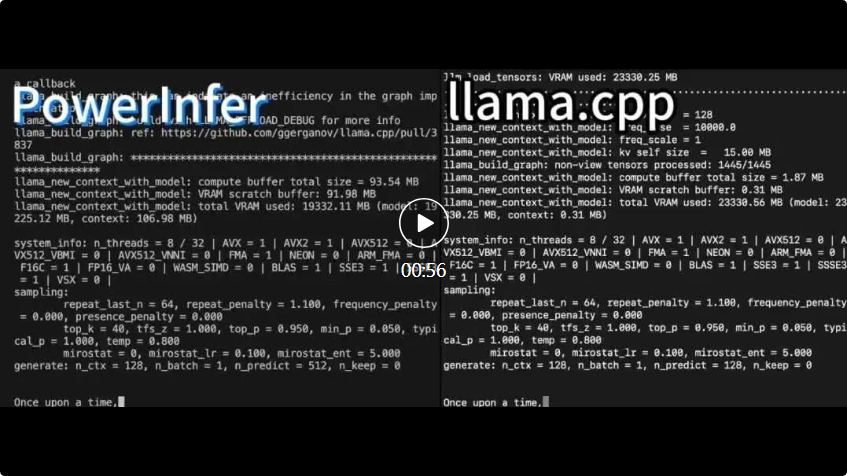

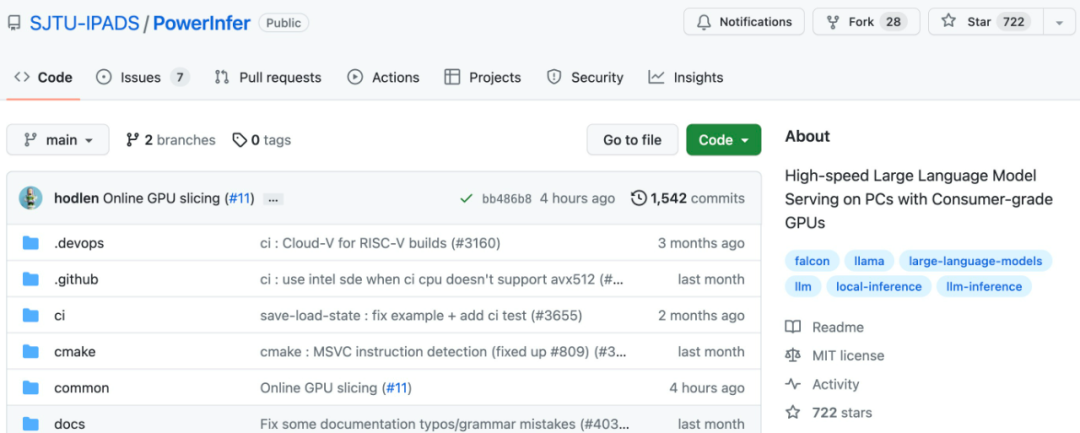

PowerInfer 使得在消费级硬件上运行 AI 更加高效。上海交大团队最新推出了超强 CPU/GPU LLM 高速推理引擎 PowerInfer。 PowerInfer 和 llama.cpp 都在相同的硬件上运行,并充分利用了 RTX 4090 上的 VRAM。 这个推理引擎速度有多快?在单个 NVIDIA RTX 4090 GPU 上运行 LLM ,PowerInfer 的平均 token 生成速率为 13.20 tokens/s,峰值为

4090成A100平替?上交大推出推理引擎PowerInfer,token生成速率只比A100低18%

机器之心报道机器之心编辑部PowerInfer 使得在消费级硬件上运行 AI 更加高效。上海交大团队,刚刚推出超强 CPU/GPU LLM 高速推理引擎 PowerInfer。项目地址::?在运行 Falcon (ReLU)-40B-FP16 的单个 RTX 4090 (24G) 上,PowerInfer 对比 llama.cpp 实现了 11 倍加速!PowerInfer 和 llama.cpp 都在相同的硬件上运行,并充分利用了 RTX 4090 上的 VRAM。在单个 NVIDIA RTX 4090 GPU

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉