面壁智能

国产端侧小模型超越 GPT-4V,「多模态」能力飞升

在刚刚过去的机器人学术顶会 ICRA 2024 上,「具身智能」成为热议,其中围绕具身智能的一个普遍疑问是:若将 AI 大模型应用到消费级机器人领域,首先是模型适配终端,还是终端适配模型? 过去一年,由于 6B、7B 等小模型的成果井喷,以及 MoE 训练技术的越发成熟,将模型跑在手机、学习机、平板电脑、机器人甚至汽车等等终端应用上的想象力开始变大,无论算法层还是硬件层都「蠢蠢欲动」。 诚然,这已经成为一个明朗的行业方向,但在系统整合上却要面临不同话语体系之间的博弈。

面壁新模型:早于Llama3、比肩 Llama3、推理超越 Llama3!

图注:面壁Eurux-8x22B 模型在 LeetCode 和 TheoremQA这两个具有挑战性的基准测试中,刷新开源大模型推理性能 SOTA。 图注:面壁Eurux-8x22B 模型综合性能比肩 LlaMa3-70B,超越开源模型 WizardLM-2-8x22b, Mistral-8x22b-Instruct,DeepSeek-67b,以及闭源模型 GPT-3.5-turbo。 Eurux-8x22B 由 Mistral-8x22B对齐而来。

被低估的面壁:打造出不输 OpenAI 的 Scaling Law 曲线

大约 1 个月前,马斯克所创办的 xAI 团队宣布开源 Grok-1——一个参数量为 3140 亿的 MoE 大模型。 从参数量来看,Grok-1 超越了 70B 的 LLaMA 2,是当前开源模型中最大的一个,被调侃为「庞然大物」。 然而,有研究人员测试却发现,参数规模量如此巨大的 Grok-1 ,效果竟然只与 Mistral AI 的 8x7B MoE 模型相当。

企业级AI Agent如何落地汽车行业,这是国内首份系统阐述白皮书

一年多来,大模型技术的进步日新月异,模型能力的上限不断抬高。但从产业变革的角度看,大模型的落地或许刚刚处于开端阶段。如何才能发挥出大模型的巨大潜力,并推动生产力更快更好地变革,仍然是一个充满探索空间的课题。每个行业都关心一个问题:将大模型应用到业务层面的最优方法论是什么?当我们谈及这个问题,自然无法避开「AI Agent」(智能体)。当 AI 从学术前沿跨越到实际应用,大模型驱动的智能体正成为推动革新的核心动力。连比尔盖茨也预言,AI Agent 将是人工智能的未来。到那时,AI Agent 将具备规划、执行、感知

中文OCR超越GPT-4V,参数量仅2B,面壁小钢炮拿出了第二弹

OpenAI后,大模型新增长曲线来了。大语言模型的效率,正在被这家「清华系」创业公司发展到新高度。从 ChatGPT 到 Sora,生成式 AI 技术遵从《苦涩的教训》、Scaling Law 和 Emerging properties 的预言一路走来,让我们已经看到了 AGI 的冰山一角,但技术的发展的方向还不尽于此。最近一段时间,科技公司大力投入生成式 AI,一系列新的概念正在出现:手机厂商认为「AI 手机」正在引领手机形态的第三次转变;PC 厂商认为「AI PC」可能会改变个人电脑的形态;而对于更多科技公司来

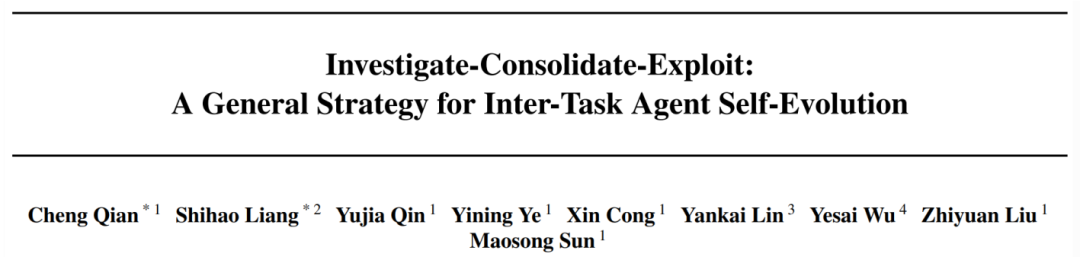

向完全自主性更进一步,清华、港大全新跨任务自我进化策略让智能体学会「以经验为鉴」

「以史为鉴,可以知兴替。」 人类的进步史,可以看作是一个不断吸取过去经验、不断推进能力边界的自我演化过程。在这个过程中,我们吸取过去失败的教训以纠正错误,借鉴成功的经验以提升效率和效果。这种自我进化的过程在我们的生活中无所不在:从如何总结经验以更好地解决工作中的问题,到如何利用规律更精确地预测天气,我们都在不断地从过去的经验中学习和进化。成功从过去的经验中提取知识并将其应用于未来的挑战,这是人类进化之路上重要的里程碑。那么在人工智能时代,AI 智能体是否也可以做到同样的事情呢?近年来,GPT 和 LLaMA 等语言

专访面壁曾国洋:踩过 1000 次大模型的坑后 ,造一个性能小钢炮

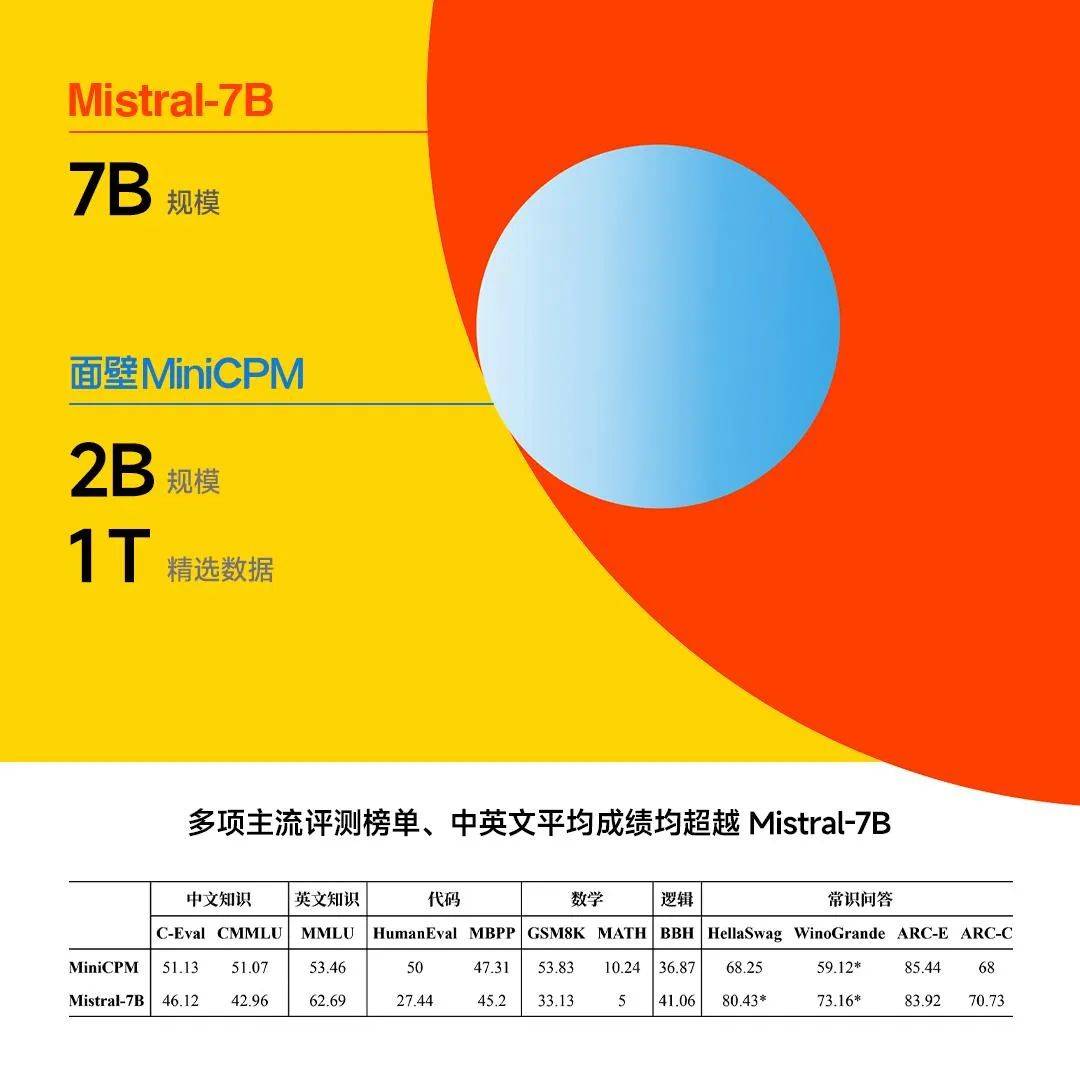

2月1日,刚成立一年的面壁智能发布了两个在海内外大模型领域「炸裂级」的存在——面壁 MiniCPM 2B 旗舰端侧大模型与面壁OmniLMM多模态大模型。 MiniCPM 2B 有着当之无愧的「小钢炮」称号,其炸裂的点在于,从规模大小和性能来看,仅用2B 规模和1T tokens精选数据,便已在多项主流评测榜单、中英文平均成绩中超越被称为“欧洲最佳大模型”的Mistral-7B。 在与其他同等规模大模型的对比中,面壁MiniCPM表现依旧领先,大幅超越了 Llama2-7B, Mistral7B,Gemini Nano,Qwen-1.8B等一众模型,甚至还能越级比肩 Llama2-13B、Falcon 40B和Cohere 54B此类比自己庞大数十倍规模的模型。

2B参数性能超Mistral-7B:面壁智能多模态端侧模型开源

千元机也能本地运行。在大模型不断向着大体量方向前进的同时,最近一段时间,人们在优化和部署方面也取得了成果。2 月 1 日,面壁智能联合清华 NLP 实验室在北京正式发布了旗舰端侧大模型「面壁 MiniCPM」。新一代大模型被称为「性能小钢炮」,直接拥抱终端部署,同时也具有同量级最强的多模态能力。面壁智能本次提出的 MiniCPM 2B 参数量仅有 20 亿,使用 1T token 的精选数据训练。这是一个参数量上与 2018 年 BERT 同级的模型,面壁智能在其之上实现了极致的性能优化与成本控制,让该模型可以「越

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉