LRM

研究人员发现奇怪现象:思考时间越长,大模型越笨

Michael Nuñez@MichaelFNunez译者 | 核子可乐审校 | 重楼Anthropic一项最新研究表明,AI模型耗费更长时间“思考”后表现未必更好,在某些情况下性能甚至会显著下降。 这一发现,挑战了AI行业推理浪潮的理论根基。 这项由Anthropic公司AI安全研究员Aryo Pradipta Gema及其他几位研究人员主导的项目,发现了所谓“测试时计算反比例”迹象,即延长大语言模型的推理长度实际上会降低其在多种任务中的表现。

苹果揭示当今先进模型存在严重缺陷,给企业高管敲响警钟

一份具有开创性的苹果研究论文在AI社区引发了轩然大波,该论文揭示了当今最先进模型中存在的严重局限性,这些缺陷此前一直未被发现。 论文《思考的错觉》表明,像GPT-4、Deep Seek和Claude Sonnet这样的高级模型所应用的“思维链”推理,在任务变得过于复杂时,会出现“完全的准确性崩溃”。 最令人担忧的方面似乎是,一旦任务复杂到一定程度,再投入更多的处理能力、标记或数据也无济于事。

ALPHAONE(α1):LRM 自适应推理效率与准确性的平衡之道

大家好,我是肆〇柒。 今天,我们来聊大型推理模型(LRM)领域的一项研究 ——ALPHAONE(α1)框架。 当前,大型推理模型如 OpenAI 的 o1 和 DeepSeek-R1 等,已经在诸多复杂推理任务上展现出了强大的能力,但它们在推理过程中也面临着一些挑战,比如容易陷入过度推理或推理不足的困境。

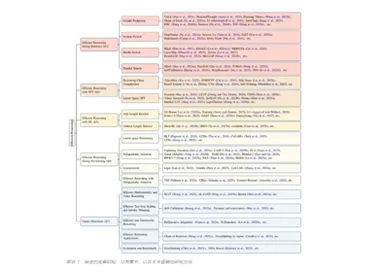

250多篇论文,上海AI Lab综述推理大模型高效思考

最近,像 OpenAI o1/o3、DeepSeek-R1 这样的大型推理模型(Large Reasoning Models,LRMs)通过加长「思考链」(Chain-of-Thought,CoT)在推理任务上表现惊艳。 但随之而来的是一个日益严重的问题:它们太能「说」了! 生成的推理过程往往充斥着冗余信息(比如反复定义)、对简单问题过度分析,以及对难题的探索浅尝辄止。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉