带宽

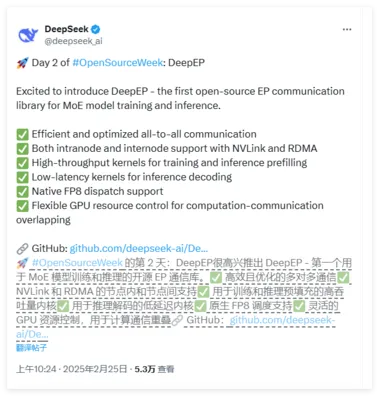

DeepSeek开源周第二日:首个面向MoE模型的开源EP通信库

Deepseek 公布了开源周第二天的产品,首个面向MoE模型的开源EP通信库,支持实现了混合专家模型训练推理的全栈优化。 DeepEP 是一个专为混合专家(MoE)和专家并行(EP)设计的高效通信库。 它致力于提供高吞吐量和低延迟的多对多 GPU 内核,通常被称为 MoE 调度和组合。

Meta 发布新一代 AI 训练与推理芯片,性能为初代芯片三倍

Meta Platforms 当地时间 10 日发布了其训练与推理加速器项目(MTIA)的最新版本,MTIA 是 Meta 专门为 AI 工作负载设计的定制芯片系列。据介绍,此次发布的新一代 MTIA 与第一代 MTIA 相比,显著改进了性能,并有助于强化内容排名和推荐广告模型。其架构从根本上侧重于提供计算、内存带宽和内存容量的适当平衡。该芯片还可帮助提高训练效率,使推理(即实际推理任务)变得更容易。Meta 在其官方博客文章中表示,“实现我们对定制芯片的雄心壮志,意味着我们不仅要投资于计算芯片,还要投资于内存带宽

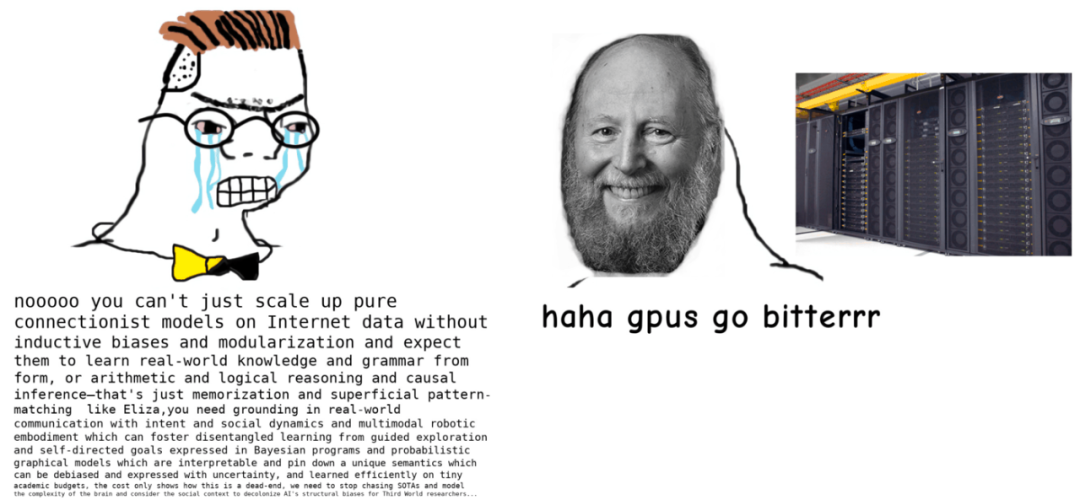

用什么tricks能让模型训练得更快?先了解下这个问题的第一性原理

深度学习是门玄学?也不完全是。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉