部署

绝!三招教你私有化部署 DeepSeek

在数字化转型的进程中,企业不仅需要高效、智能的工具来提升运营效率,还需确保数据安全与满足隐私保护要求。 DeepSeek 私有化部署正是为解决这一需求而生的,它通过将 DeepSeek 智能助手从公共云端迁移至企业内部服务器,为企业提供了一种安全、可控且高度定制化的解决方案。 这种部署方 式不仅能够满足企业对敏感数据的保护需求,还能根据具体业务场景进行灵活 调整,从而为企业数字化转型提供强有力的支持。

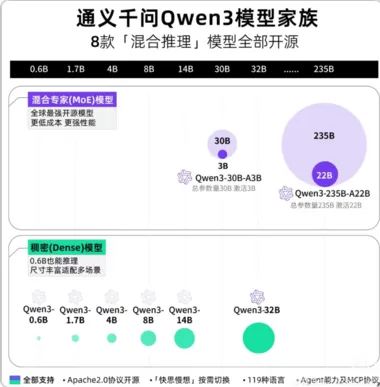

性能与效率的双赢:Qwen3横空出世,MoE架构大幅降低部署成本

阿里云旗下通义千问(Qwen)团队正式发布Qwen3系列模型,共推出8款不同规格的模型,覆盖从移动设备到大型服务器的全部应用场景。 这是国内首个全面超越DeepSeek R1的开源模型,也是首个配备混合思维模式的国产模型。 模型阵容丰富,满足各类部署需求Qwen3系列包含6款Dense模型和2款MoE模型:Dense模型:0.6B、1.7B、4B、8B、14B、32BMoE模型:Qwen3-235B-A22B (总参数235B,激活参数22B)Qwen3-30B-A3B (总参数30B,激活参数3B)所有模型均支持128K上下文窗口,并配备了可手动控制的"thinking"开关,实现混合思维模式。

这样在本地搭建DeepSeek可以直接封神:本地部署+避坑指南(升级版)

本文旨在提供一个全面且详细的DeepSeek本地部署指南,帮助大家在自己的设备上成功运行DeepSeek模型。 无论你是AI领域的初学者还是经验丰富的开发者,都能通过本文的指导,轻松完成DeepSeek的本地部署。 一、本地部署的适用场景DeepSeek本地部署适合以下场景:高性能硬件配置:如果你的电脑配置较高,特别是拥有独立显卡和足够的存储空间,那么本地部署将能充分利用这些硬件资源。

三分钟部署自己的 DeepSeek R1 满血版,彻底告别服务器繁忙!

Hello,大家好,我是 Sunday。 网上有很多教大家部署 DeepSeek 的教程,但是大多数都是 小模型 部署,参数最多也就给你打到 14b。 这样的小模型相比满血版的 R1 简直 弱爆了。

直接通过 Node 部署,把任意网站变为 API 接口?firecrawl有点牛了!

最近看到了一个爬虫类框架:firecrawl 号称 可以抓取任何网站并将其转换为干净的 markdown 或结构化数据。 并且可以直接通过 Node 进行部署。 看这样的描述有点厉害了,所以,咱们今天就来看看这个 firecrawl01:什么是 firecrawlFirecrawl 是一种 API 服务,它获取 URL、对其进行抓取并将其转换为干净的 markdown 或结构化数据。

荣耀 MagicOS 9.0 升级支持 30 亿参数端侧大语言模型:功耗下降 80%,内存占用减少 1.6GB

感谢荣耀今日正式发布 MagicOS 9.0,号称是“行业首个搭载智能体的个人化全场景 AI 操作系统”。 在 MagicOS 9.0 中,MagicOS 全新魔法大模型家族迎来升级,支持端云资源灵活调配,不同设备灵活部署,AI在线附各版本如下:500 万参数图像大模型,端侧部署,全系列支持4000 万参数图像大模型,端侧部署,中高端系列30 亿参数大语言模型,端侧部署,中高端系列10 亿参数多模态大模型,端侧部署,中高端系列1500 万参数语音大模型,端侧部署,全系列支持荣耀表示,MagicOS 9.0 升级支持 30 亿参数端侧大语言模型,相比 MagicOS 8.0 的 70 亿参数魔法大模型,加载速度提升 77%、出词速度提升 500%、功耗下降 80%。 此外,新版大模型的内存占用减少 1.6GB,存储占用减少 1.8GB。

中国算力大会,联想重磅发布两款明星算力新品

9月27日,为期3天的2024中国算力大会正式拉开帷幕。在大会异构智算产业生态联盟技术论坛上,联想集团正式发布新一代AI服务器联想问天WA7880a G3和联想AIPod应用部署解决方案两款重磅产品和解决方案。联想AI基础设施“一横五纵”的战略版图进一步丰富和完善。联想问天WA7880a G3是针对AI大模型训练推出的新一代AI服务器,具备多元算力、灵活配置和节能高效三大特点。它也是国内首款支持OAM 2.0模组的服务器,可兼容国内主流GPU厂商的OAM GPU;在配置选择上支持CPU和GPU之间单上行和双上行拓扑

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉