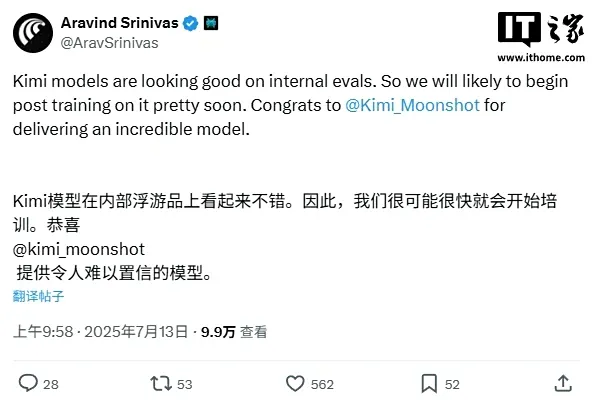

AI在线 7 月 13 日消息,美国 AI 初创公司 Perplexity 的 CEO 阿拉温德(Aravind Srinivas)今日发文称,月之暗面 Kimi K2 模型在测试中良好表现,公司后续可能会基于 K2 进行后训练。

Live Mint 今年 1 月报道显示,此前 DeepSeek R1 也曾被 Perplexity 用于模型训练。

Kimi K2 是月之暗面 Kimi 昨日刚发布的旗下首个万亿参数开源模型,强调代码能力和通用 Agent 任务能力。这是一个更擅长通用 Agent 任务的 MoE 架构基础模型,总参数 1T,激活参数 32B。

AI在线从月之暗面官方获悉,Kimi K2 在 SWE Bench Verified、Tau2、AceBench 等基准性能测试中均取得开源模型中的 SOTA 成绩,展现出在代码、Agent、数学推理任务上的领先能力。

相关阅读:

《月之暗面发布旗下首个万亿参数开源模型 Kimi K2,擅长代码与 Agentic 任务》