在当今人工智能迅速发展的浪潮中,MiniMax M2 作为一款新的预训练模型,吸引了众多关注。其采用的全注意力机制(Full Attention)引发了广泛讨论,许多技术专家和爱好者不禁疑惑:“为何不继续发展线性或稀疏注意力技术?” 对此,MiniMax M2 的预训练负责人决定深入探讨这一决策的背后原因。

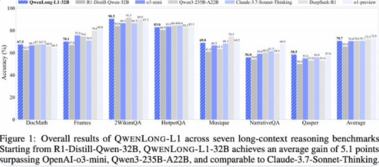

首先,开发团队认为,在现有工业环境中,尽管线性和稀疏注意力技术具有节省计算资源的潜力,但要完全取代全注意力机制仍需时日。大型语言模型(LLM)在实际应用中面临着各种复杂场景,例如代码解析、数学计算及多模态数据处理,评估模型的表现不仅需要理论上的支持,更需要在实际应用中进行验证。

其次,尽管研究人员一直在探索更高效的注意力机制,但在实际应用中,表现优越的模型往往需要配合出色的工程优化。MiniMax M2 团队清楚地意识到,模型的效果、速度(TPS)和成本是用户最为关注的三个方面。为了提升模型性能,研究人员必须克服评测体系的不完善及观察成本过高的难题。

最后,MiniMax M2 团队还面临着基础设施的挑战。相较于全注意力,线性和稀疏注意力的基础设施相对薄弱,开发者需要为获得性能提升而付出更多努力。随着计算资源的限制和数据处理需求的不断增长,线性和稀疏注意力的优势可能会逐渐显现,因此,团队正在为这一转变提前布局。

MiniMax M2 团队将继续探索更为高效的模型架构,并对现有的基础设施进行优化,以满足未来的计算需求。在不断前行的道路上,团队始终保持着对技术的探索热情,期望在不久的将来推出更具竞争力的产品。