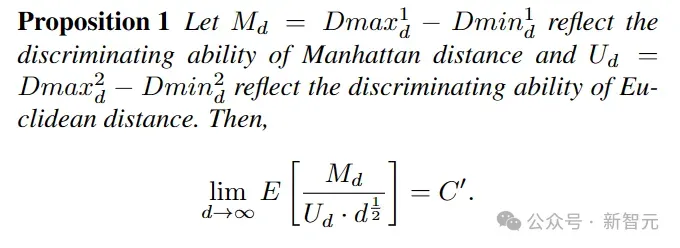

虽然无法彻底解决维度诅咒带来的问题,根据理论证明,曼哈顿距离在高维空间中的识别能力要远远好于常用的欧式距离,可以缓解维度诅咒效应。

方法框架

即便曼哈顿距离有着更好的识别效力,但是研究人员也不认为在识别后门攻击的时候曼哈顿就能完全替代欧氏距离。

除此以外,先前的工作已经表明[3],有的后门攻击会在欧氏距离上表现区分度,有的则会在余弦相似度(Cos 距离)上表现差异。

于是研究人员决定采用曼哈顿、欧氏和 Cos 距离共同去识别后门,如上图所示。

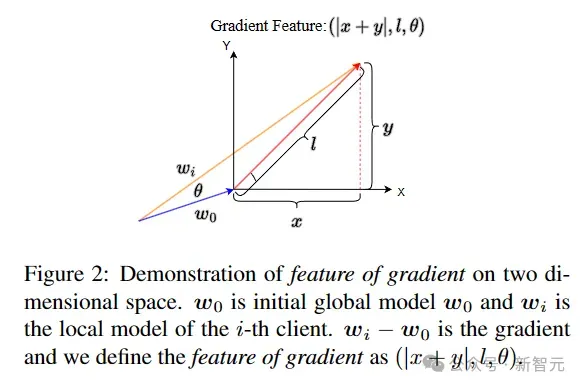

在定义好了识别梯度时的指标之后,在研究人员面前也有两个障碍:

1. 三种距离有着不同的尺度,由于每个度量都是相关的,因此需要一种新的正则化方法,而不是通常的按最大值进行归一化;

2. 不同的数据分布(如不同程度的非 IID)会使恶意客户端和良性客户端的梯度不同。

因此,需要动态加权来应对各种环境和攻击,以实现通用防御。

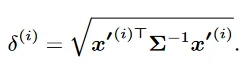

为了解决上述问题,研究人员提出了一种通过浓度矩阵(协方差矩阵的逆)进行白化的方法如上图所示,其中x为客户端距离特征向量,Σ为协方差矩阵,其能够根据每个客户端上三个指标特征的分布动态地决定每个指标的权重,以适应不同的数据分布情况和攻击策略。

在得到了客户端的距离得分δ后,便可以根据该分数聚合更优梯度。通过这种机制,方法不仅能够容纳三种指标,同时也能根据需要容纳更多的指标去分析各个梯度。

论文2:TIFS 2025

论文题目:Scope: On Detecting Constrained Backdoor Attacks in Federated Learning(第一作者:黄思铨;通讯作者:高英)

论文链接:https://ieeexplore.ieee.org/document/10852410

代码链接:https://github.com/siquanhuang/Scope

摘要

联邦学习(Federated Learning,FL)使多个客户端能够协同训练高效的深度学习模型,但其也易受到后门攻击的威胁。

传统的基于检测的防御方法依赖特定度量标准来区分客户端的梯度。然而,具备防御认知的攻击者可以利用这一点,通过在这些度量上对攻击梯度施加约束,从而逃避检测,形成度量约束攻击。

研究人员具体实现了这类威胁,并提出了余弦约束攻击,这种攻击能够成功突破基于余弦距离的先进防御方法。

为应对上述挑战,研究人员提出了一种新颖的防御机制 Scope。该方法通过揭示攻击梯度中被约束的后门维度,在使用余弦距离的同时,能够检测出余弦约束攻击。

Scope采用逐维归一化和差异化缩放策略,以放大后门维度与正常或未被使用维度之间的差异,有效对抗高级攻击者掩盖后门特征的行为。

此外,研究人员还设计了一种全新的聚类方法主导梯度聚类,用于隔离并剔除后门梯度。

在多个数据集、模型、联邦学习设置以及不同攻击者场景中进行的广泛实验表明,Scope在检测和防御后门攻击方面显著优于现有方法,特别是在应对余弦约束攻击方面效果尤为突出。

研究人员还提出了一种专门针对Scope的定制攻击,试图最大限度地增强其隐蔽性以规避Scope的检测,但实验结果显示该攻击依然失败,这进一步凸显了Scope防御机制的鲁棒性和先进性。

背景

由于大多数后门检测方法依赖特定的度量标准(如欧几里得距离或余弦距离)来区分正常梯度与恶意梯度,因此它们容易受到度量约束攻击(metric-constrained attacks)的影响。

当攻击者完全了解服务器端部署的防御算法时,他们可以有针对性地对其恶意梯度在防御所使用的度量上进行约束,从而绕过检测。

这种针对防御机制精心设计的攻击给联邦学习系统的安全性带来了巨大挑战。

已有研究表明,基于欧几里得距离的防御方法无法有效抵御在该度量下受到约束的攻击。尽管使用余弦距离的方法能够识别受欧几里得距离约束的攻击,但却难以抵挡余弦约束攻击(cosine-constrained attack)。

值得注意的是,尽管已有研究提出了使用多重度量的方法以应对这一挑战,这些方法依然未能有效防御此类攻击。

在该研究中,研究人员采用了一个全新的视角,聚焦于检测恶意梯度向量中潜藏的后门特征。已有研究表明,神经网络(Neural Networks, NNs)的不同维度承载着不同的任务,例如正常任务与后门任务。

基于这一观点,可以将神经网络的权重划分为三类维度:正常维度(benign dimensions),后门维度(backdoor dimensions),其余未被利用的维度(unused dimensions)。

后门梯度主要作用于后门维度,而正常梯度则主要更新正常维度。研究人员认为,度量约束攻击中后门维度难以被区分的原因有两个:

1. 被正常维度掩盖,

2. 被未被使用的维度稀释。

于是,该论文聚焦于以下问题:如何在后门维度被掩盖和稀释的情况下找到后门梯度的差异性?

方法

逐维归一化

由于变化绝对值较大的维度在梯度中占主导地位,导致现有防御方法难以有效检测出恶意梯度。

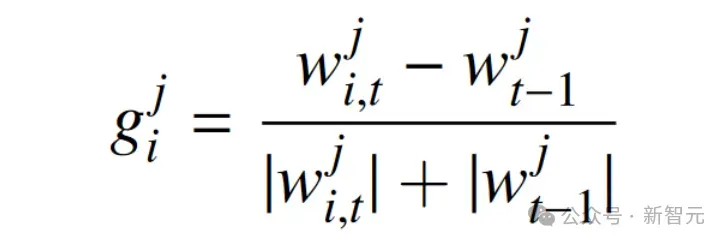

因此,研究人员将重点转向关注各维度的变化率而非其具体数值,以消除高绝对值维度对检测结果的显著干扰。为了计算每个维度上的变化率,研究人员将客户端的梯度(即 )在全局模型和客户端模型之间逐维分解,并将每个维度的梯度变化缩放到区间 [0,1],从而统一量纲并实现对不同维度变化的相对比较。

)在全局模型和客户端模型之间逐维分解,并将每个维度的梯度变化缩放到区间 [0,1],从而统一量纲并实现对不同维度变化的相对比较。

差异化缩放

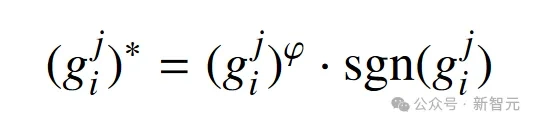

由于所有维度在归一化后被映射到区间[0,1][0,1],研究人员将每个维度的归一化值gi自身幂乘ϕ次,以进一步压低更新幅度较小的维度值,使其趋近于0,从而消除这些微弱更新维度的影响。

相反,对于接近1的维度,保持其影响不变,甚至增强,从而放大各维度之间的差异,形成「强者愈强」的效应。

通过这种方式,有效削弱了大量未被使用维度对少数关键后门维度的干扰,使后门相关的关键维度在梯度向量中占据主导地位。

最终,梯度向量的方向将完全由这些后门维度主导,忽略了微弱维度的干扰,从而提升后门特征的可检测性。