白铂 博士,华为 2012 实验室理论研究部主任 信息论首席科学家

2022 年底,ChatGPT 横空出世,其能力震惊了整个世界。2024 年底,DeepSeek 以极低的训练成本和极高的性能再次震惊了世界。短短几年间,大模型疯狂迭代,能力不断提升,仅在美国,AI 领域的投资规模便超过了许多国家全年的 GDP!2025 年底,Google 强势推出 Gemini 3,模型能力突飞猛进,TPU 训练范式也对英伟达的生态发起了颠覆式挑战。

业界普遍认为 Gemini 3 是迈向通用人工智能(Artificial General Intelligence,AGI) 和超级人工智能(ASI,Artificial Super Intelligence,ASI)的关键突破,是人类和机器合作的惊人之作。然而,正如 Ilya Sutskever 于 11 月 26 日的访谈中指出:大模型 Scaling Law 和摩尔定律一样,迟早会因为物理限制而失效。因此,如何打开大模型训练的炼丹炉,看清黑盒子背后的基本原理,回答大模型是否已逼近其能力极限就成为迫在眉睫的问题了。但是,前人对大模型的理论研究一直停留在单一维度,使得人们只能看到大模型背后原理的冰山一角,对黑盒子的理解也失之片面。

11 月 3 日,我们在 arXiv 上挂出了一篇论文 Forget BIT, It is All about TOKEN: Towards Semantic Information Theory for LLMs [1]。该研究将统计物理、信号处理和信息论三者有机结合,系统地总结了对大模型背后数学原理的思考和理解,期望给全面揭示大模型的第一性原理带来曙光。过去一段时间,我们在以下的学术会议上分别报告了这方面的工作:

11 月 2 日:中国电子学会第 32 届信息论学术年会

11 月 15 日:中国工业与应用数学学会第 3 届信息通信数学及应用大会

11 月 17 日:The 2nd Conference-School on Tensor Methods in Mathematics and Artificial Intelligence Computing

11 月 29 日:福州大学图论与组合研讨会

会上和专家、学者们有很多互动,也收到了不少有价值的反馈。同时也将论文发给了一些海内外的专家、学者们,也收到了不少意见和建议。但是,原论文涉及的领域很多、概念体系复杂,加之写法上很学术,因而比较晦涩难懂。

为了便于理解,这里尝试用通俗易懂的语言写一个文章系列来解读这篇论文,其中一些内容也是原论文没有包含的。预计至少包括以下三篇文章,每一篇围绕一个专题展开:

大模型的第一性原理:(一)统计物理篇,主要内容和结论包括:

Attention 模块和 Transformer 架构都可以用统计物理中的能量模型来描述,因而推理是输出能量函数最小的下一个 Token;而训练则是逼近平均能量函数最小的参数组态;

大模型的记忆容量随着模型参数的线性增加而指数增长,因而小模型也可以具备很强的能力,但由于记忆容量的限制,小模型增训很容易导致模型崩塌;

大模型泛化误差上界的核心参数是 Logits 的绝对值的和,因而模型缩减,如剪枝、蒸馏和量化等,必须谨慎的控制对 Logits 的影响;

大模型的能力极限是时间序列维度的 Granger 因果推断,因而 Scaling Law 还会延续,但不会产生真正的符号化、概念抽象和逻辑推理能力。

大模型的第一性原理:(二)信号处理篇,主要内容和结论包括:

大模型的输入是向量化的 Token 序列,因而可将基于概率统计的自然语言处理问题转化为易于数值计算的信号处理问题;

向量内积描述了 Token 之间的语义相关性,因而 Gromov-Wasserstein 距离是天然的语义向量空间距离,Johnson-Lindenstrauss 引理和压缩感知等技术可用于语义压缩 / 降维;

大模型的目标是预测下一个 Token,因而可以用倒向定向信息为优化目标来实现信息论意义下最优的 Token 向量化;

Transformer 是时变向量自回归时间序列,它建模的是作为时间序列的自然语言,因而预测下一个 Token 是时间序列维度的 Granger 因果推断。

大模型的第一性原理:(三)信息论篇,主要内容和结论包括:

大模型的信息论抽象是有状态、带反馈的信道,因而符合该抽象的任何结构(不一定是神经网络)都能达到相同的效果;

大模型的端到端性能指标以定向信息为基础,包括预训练阶段的定向速率 - 失真函数、后训练阶段的定向报酬 - 失真函数和推理阶段的定向信息密度,因而只要将核心概念从 Bit 转换为 Token 就可以在 Shannon 信息论的框架下研究大模型;

大模型在推理阶段可以定义语义信息容量,因而上下文工程(或提示词工程)的信息论本质就是通过优化上下文的概率分布来逼近语义信息容量,这与信道编码逼近 Shannon 容量的思想一致;

定向信息是 Granger 因果强度的测度,因而统计物理、信号处理和信息论三个维度共同印证了大模型的能力极限是时间序列维度的 Granger 因果推断。

需要指出,我们的研究并不是要否定大模型的重要价值,它是一个非常强大的工具,当前形态就能极大提升人们整合和处理信息的效率,这是谁也无法否认的。我们想要探讨的是当前大模型的第一性原理,从而界定其能力极限,并探讨面向未来的技术路径。

神经网络与统计物理

2024 年诺贝尔物理学奖授予了 John Hopfield 和 Geoffrey Hinton,颁奖词为:For foundational discoveries and inventions that enable machine learning with artificial neural networks。许多人不太理解,甚至一些 AI 领域的人也认为诺贝尔奖开始蹭热点了。但实际上从早期的 Hopfield 网络开始,神经网络和统计物理就有非常深刻的联系。

Hopfield 本身就是一位物理学家,他于 1982 年提出了 Hopfield 网络,其联想记忆能力震惊了当时的世界 [2]。这一突破重新激发了人们对神经网络和 AI 的大范围研究。可以说,他对 AI 研究走出寒冬做出了不可磨灭的贡献。被称为 “AI 教父” 的 Hinton 则是第一位认识到统计物理方法在神经网络中有巨大价值的计算机科学家。1985 年,他与另外两位合作者提出了 Boltzmann 机,其关键就是引入了统计物理中的能量模型(Energy-based Model,EBM)[3][4]。除了两位诺奖得主外,还有一位女物理学家 Elizabeth Gardner 非常关键。1988 年,Gardner 三度出手,系统地研究了 Hopfield 网络的记忆容量问题,即到底能记住多少个随机模式 [5][6][7]。后来人们将这个容量称为 Gardner 容量。Gardner 用的方法就是统计物理中的 Spin Glass 模型和 Replica 方法。Replica 方法的提出者则是 2021 年诺贝尔物理学奖得主 Giorgio Parisi [8][9]。我们今年和他有一场访谈(视频链接:https://weixin.qq.com/sph/AlRVrYjAi),深入探讨了 AI 与统计物理的关系。

Attention 模块的 EBM 形式

人们逐步认识到大模型的目标只有一个:预测下一个 Token。Transformer 是当前实现这一目标的有效架构。考虑一个 Decoder-only 的 Transformer 架构,按照从输入到输出的顺序,可以分解为 Attention 和 FFN 两个主要模块 [10]。本节将重点讨论 Attention 模块。

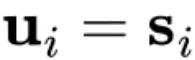

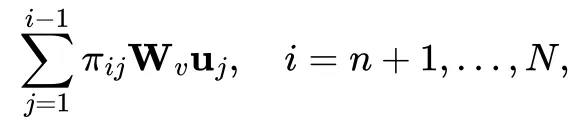

考虑提示词的长度为 n,用向量序列  来表示。当前要预测第 i 个 Token,表示为向量

来表示。当前要预测第 i 个 Token,表示为向量  ,其中 i=n+1,…,N。为表示方便,令

,其中 i=n+1,…,N。为表示方便,令  ,其中 i=1,…,n。那么 Attention 模块的输出可以为:

,其中 i=1,…,n。那么 Attention 模块的输出可以为:

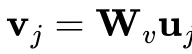

其中  是注意力权重,

是注意力权重, 是值向量。根据 softmax 函数的定义,

是值向量。根据 softmax 函数的定义, 可以展开写成:

可以展开写成:

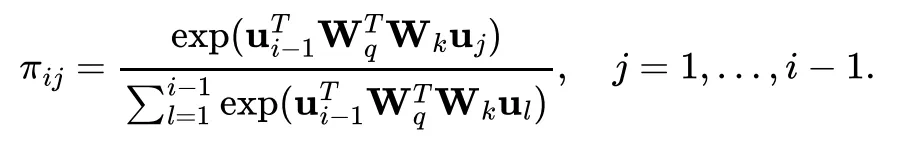

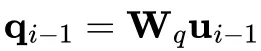

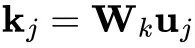

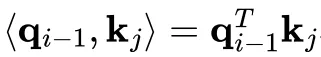

根据定义, 表示查询向量,而

表示查询向量,而  表示键值向量。它们的内积

表示键值向量。它们的内积  表示用

表示用  查询

查询  时,对于预测

时,对于预测 的语义匹配程度。如果令

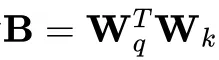

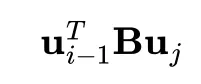

的语义匹配程度。如果令  ,那么:

,那么:

就是一个双线性型(Bilinear Form)。在数学上,双线性型是基于内积建模非对称关系的最简形式。因此,Attention 机制能够有效的捕捉自然语言中两个 Token 之间的非对称语义关系。

中的 softmax 函数是很关键的。基于 Jaynes 的极大熵原理,softmax 函数所导出的分布是在均值约束(或者说在神经网络平均激活程度)的条件下,熵最大的离散分布 [11]。通俗地说, softmax 函数的最大值输出,就是在最不靠谱的条件下的最靠谱估计。 如果这个估计也靠谱的话,那么就真的很靠谱了。

中的 softmax 函数是很关键的。基于 Jaynes 的极大熵原理,softmax 函数所导出的分布是在均值约束(或者说在神经网络平均激活程度)的条件下,熵最大的离散分布 [11]。通俗地说, softmax 函数的最大值输出,就是在最不靠谱的条件下的最靠谱估计。 如果这个估计也靠谱的话,那么就真的很靠谱了。

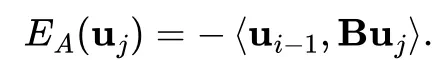

基于 Hinton 的思路,可以写出 Attention 模块的 EBM 形式。定义能量函数  :

:

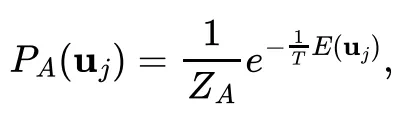

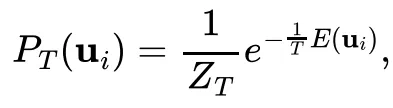

那么,关于 Attention 机制的 Boltzmann 分布就可以写成

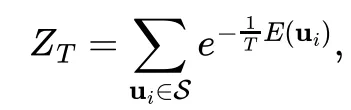

其中 T 是温度, 是 Attention 模块的配分函数(Partition Function),即

是 Attention 模块的配分函数(Partition Function),即

从这个角度看,Attention 机制的关键之一是学习一个组态(Configuration)B,使得语义相关性最高等价于能量函数最低。这个逻辑和面向 Attention 机制的基于隐变量 J 的变分推理解释,即证据下界(Evidence Lower Bound, ELBO)相吻合。详细推导参见论文中 ELBO 的相关章节,这里不再赘述。

以上分析可至少得到两点启发:

Mamba/Mamba2 等线性注意力机制虽能显著降低计算量,但不能有效建模 Token 之间的语义非对称性 [12][13]。模型能力因而大打折扣是在情理之中的。因此,Qwen3-Next 等模型采用了混合注意力机制。

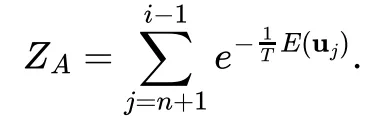

如何在保持语义非对称建模能力的前提下,降低计算复杂度是非常重要的。稀疏注意力(Sparse Attention)机制是当前的研究热点之一。DeepSeek-V3.2 已经应用了称为 DSA 的稀疏注意力机制,并取得了很好的效果 [14]。从数学上看,最优的稀疏注意力就是对每个 i=1,…,N 求解如下优化问题:

Transformer 的 EBM 形式

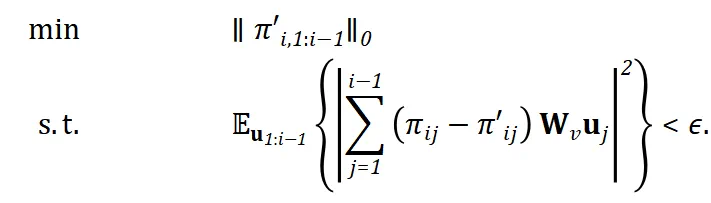

参照 Attention 模块的 EBM 形式,也可以写出 Transformer 的 EBM 形式,从而为后续推导记忆容量、泛化误差界,进而分析推理能力奠定基础。这里将 FFN 模块抽象为函数  ,并用

,并用  来表示各层权重矩阵和偏置向量的集合。定义能量函数

来表示各层权重矩阵和偏置向量的集合。定义能量函数  :

:

事实上, 就是输入到 softmax 函数的 Logits。那么,Transformer 的 Boltzmann 分布就可以写成:

就是输入到 softmax 函数的 Logits。那么,Transformer 的 Boltzmann 分布就可以写成:

其中 T 是温度, 是 Transformer 架构的配分函数,即

是 Transformer 架构的配分函数,即

其中,S 是所有可能的 Token 的集合。在机器学习领域,S 一般称之为词表;在信息论中叫码本(Codebook);而在通信中则体现为星座图(Constellation)。因此,大模型推理的本质就是要找到下一个 Token,使得能量函数最小,即 Boltzmann 分布最大。在训练阶段,则是要找到一个组态  ,使得对于训练集平均能量函数最小。

,使得对于训练集平均能量函数最小。

Transformer 的记忆容量

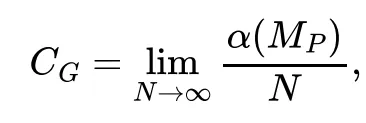

最初的 Gardner 容量描述了 Hopfield 网络到底能记住多少个随机模式,即多少个长度为 N 的随机序列。这里 N 就是 Hopfield 网络包含的神经元数量。令  表示模型记住的随机模式的数量,定义广义 Gardner 容量如下:

表示模型记住的随机模式的数量,定义广义 Gardner 容量如下:

其中, 是一个归一化函数,在原始定义中是没有的。如果把记住的模式,换成成功传输的模式,

是一个归一化函数,在原始定义中是没有的。如果把记住的模式,换成成功传输的模式, 取为对数函数,那么广义 Gardner 容量就变成了 Shannon 容量。事实上,信息论专家、1990 年香农奖得主 Thomas Cover 在 1965 年曾解决过 Gardner 容量的一个特例 [15]。需要指出,Gardner 等人所用的 Replica 方法代表了物理学家的天才直觉,但在数学上并不严格。2024 年阿贝尔奖得主,数学家 Michel Talagrand 在统计物理方面也功力深厚,他用严格的数学方法系统研究了多层感知器和 Hopfield 网络的原理,推导了球模式和离散立方体模式下的 Gardner 容量 [16][17]。这些物理方法和数学工具为彻底打开大模型黑盒子奠定了坚实的理论基础。

取为对数函数,那么广义 Gardner 容量就变成了 Shannon 容量。事实上,信息论专家、1990 年香农奖得主 Thomas Cover 在 1965 年曾解决过 Gardner 容量的一个特例 [15]。需要指出,Gardner 等人所用的 Replica 方法代表了物理学家的天才直觉,但在数学上并不严格。2024 年阿贝尔奖得主,数学家 Michel Talagrand 在统计物理方面也功力深厚,他用严格的数学方法系统研究了多层感知器和 Hopfield 网络的原理,推导了球模式和离散立方体模式下的 Gardner 容量 [16][17]。这些物理方法和数学工具为彻底打开大模型黑盒子奠定了坚实的理论基础。

关于 Transformer 的记忆容量问题,学界已经取得了一些初步结果,归纳如下:

Attention 模块的记忆容量:近期研究指出 Attention 模块通过学习

记住了

记住了  [18]。该工作还证明:通过设计新的能量函数,Attention 机制可以等效为一个连续变量的现代 Hopfield 网络,从而得出 Attention 模块的记忆容量随参数量的线性增加而指数增长。因此,模型参数量不用太大就能无差错地记住足够多知识。这就解释了为什么小模型依然有很强的能力。同时,由于小模型记住的模式数量更接近于其记忆容量,因此小模型的增训是很困难的,稍有不慎就会导致模型崩塌。

[18]。该工作还证明:通过设计新的能量函数,Attention 机制可以等效为一个连续变量的现代 Hopfield 网络,从而得出 Attention 模块的记忆容量随参数量的线性增加而指数增长。因此,模型参数量不用太大就能无差错地记住足够多知识。这就解释了为什么小模型依然有很强的能力。同时,由于小模型记住的模式数量更接近于其记忆容量,因此小模型的增训是很困难的,稍有不慎就会导致模型崩塌。FFN 模块的记忆容量:一些研究认为 FFN 记住的是(k,v),是大模型以参数化的方式储存知识的地方 [19],因而对于模型能力非常重要。在此基础上,模型编辑技术通过修改 FFN 层的对应参数来直接更新目标知识,而无需模型增训 [20]。我们在这个方向也取得了一些初步研究成果 [21]。

近年来,人们经常会用能力涌现来描述大模型为什么大就是好。从 Gardner 容量的角度看,其本质可以理解为随着参数量的增加,大模型记住的知识量超过了某个阈值,就出现了统计物理中的相变现象。实际上,Parisi 教授也是从相变的角度来研究 Shannon 容量的,并且提出:即使通信速率小于信道容量,也存在计算上困难的区域。因此,通过统计物理方法,有望从理论上解释模型规模和模型能力的尺度定律(Scaling Law),并最终解释能力涌现的相变现象。我们在这个方向也取得了一些初步成果 [22]。

Transformer 的泛化误差界

泛化误差是刻画大模型实际效果的关键指标。基于 Transformer 的 EBM 形式,可以从理论上推导泛化误差界。详细的数学证明可以参见论文的对应章节。主要用到的数学工具是 Rademacher 复杂度和 Talagrand 不等式 [23]:

Rademacher 复杂度的核心思想是考察一个模型对于纯随机序列的拟合能力。这个序列以 0.5 的概率取值于 {−1,1},通常称之为 Rademacher 序列。后面将看到,Rademacher 复杂度项在泛化误差界中起到了核心作用。

前面提到的数学家 Talagrand,发展出了泛型链 (Generic Chaining) 理论,它能对一类非常广泛的随机过程的上确界给出极其精确的估计。这深刻地改变了人们对随机性和高维空间的理解。

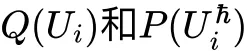

交叉熵是在训练中广泛使用的损失函数。在推理阶段,仍然可以用交叉熵来衡量大模型输出的 Token 是否符合人类期望。固定一个输入的 Token 序列,用  表示大模型在推理阶段输出的第 i 个 Token,

表示大模型在推理阶段输出的第 i 个 Token, 则表示人类对应的输出。它们的概率分布分别用

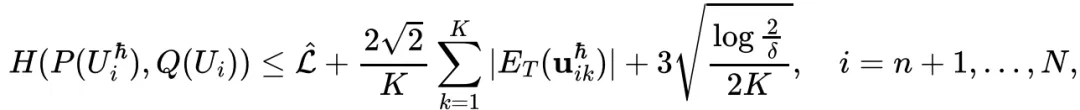

则表示人类对应的输出。它们的概率分布分别用  来表示。考虑 K 个样本,即做 K 次第 i 个 Token 的推理。那么,对任意 δ>0,应用 Talagrand 不等式,交叉熵损失函数可以被以下不等式以 1−δ 的概率控制住:

来表示。考虑 K 个样本,即做 K 次第 i 个 Token 的推理。那么,对任意 δ>0,应用 Talagrand 不等式,交叉熵损失函数可以被以下不等式以 1−δ 的概率控制住:

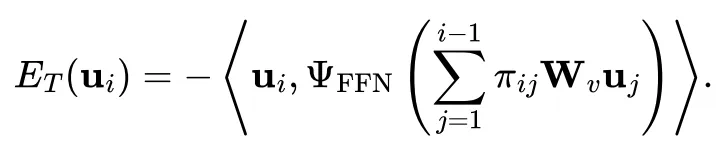

其中 是经验交叉熵损失函数,在训练阶段已被最小化。不等式右侧的第二项是 Rademacher 复杂度的具体形式,其核心是能量函数(也就是 Logits)的绝对值的和,其中

是经验交叉熵损失函数,在训练阶段已被最小化。不等式右侧的第二项是 Rademacher 复杂度的具体形式,其核心是能量函数(也就是 Logits)的绝对值的和,其中  是人类在第 k 次推理中,预测的第 i 个 Token 的向量表示。以上不等式表明,对于大模型做任何小型化的工作,如剪枝、蒸馏和量化等,都要仔细考察对能量函数(即 Logits)的影响,因为它决定了大模型的泛化误差上界。可见,基于微观组态定义的能量函数的确可以给出大模型的宏观能力,即推理泛化误差。

是人类在第 k 次推理中,预测的第 i 个 Token 的向量表示。以上不等式表明,对于大模型做任何小型化的工作,如剪枝、蒸馏和量化等,都要仔细考察对能量函数(即 Logits)的影响,因为它决定了大模型的泛化误差上界。可见,基于微观组态定义的能量函数的确可以给出大模型的宏观能力,即推理泛化误差。

大模型推理能力与 Granger 因果

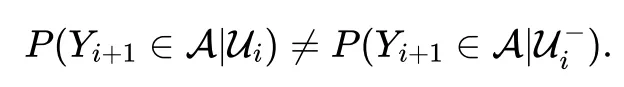

2003 年诺贝尔经济学奖得主,Clive Granger 从 1980 年开始的一系列工作给出了因果关系的一般定义,后来称之为 Granger 因果 [24]。令  表示整个宇宙在时刻 i 的所有知识,

表示整个宇宙在时刻 i 的所有知识, 则表示一个经过修改的宇宙在时刻 i 的所有知识。这里的 “修改” 指的是排除了

则表示一个经过修改的宇宙在时刻 i 的所有知识。这里的 “修改” 指的是排除了  这个时间序列。这样称

这个时间序列。这样称  引起了

引起了  ,如果

,如果

这个定义是非常普适的,但没有可操作性。随后 Granger 给出了一系列具体的方法,来检测两个时间序列是否有 Granger 因果关系。这些方法已经广泛应用于物理学、神经科学、社交网络、经济学和金融学等领域。

结合大模型记忆容量的讨论,那么在推理阶段,对于  表示大模型记住的所有知识,加上输入的 Token 序列

表示大模型记住的所有知识,加上输入的 Token 序列  和已经产生的 Token 序列

和已经产生的 Token 序列  ;而

;而  只包含大模型记住的所有知识。很显然,上述不等式在推理过程中是一定成立的。因此,大模型推理的本质,是通过预测下一个 Token 这一看似简单的训练目标,实现逼近人类水平的 Granger 因果推断。然而,机器学习领域的著名专家 Judth Pearl 教授则认为:Granger 因果并不是真正的因果关系,而属于具有时间顺序的统计关系 [25]。因此,我们可以得到类似结论:大模型的能力极限就是时间序列维度的 Granger 因果推断,因而 Scaling Law 还会延续,但大模型不会从数据中自主的抽象概念并符号化,也不会具备真正的逻辑推理能力。

只包含大模型记住的所有知识。很显然,上述不等式在推理过程中是一定成立的。因此,大模型推理的本质,是通过预测下一个 Token 这一看似简单的训练目标,实现逼近人类水平的 Granger 因果推断。然而,机器学习领域的著名专家 Judth Pearl 教授则认为:Granger 因果并不是真正的因果关系,而属于具有时间顺序的统计关系 [25]。因此,我们可以得到类似结论:大模型的能力极限就是时间序列维度的 Granger 因果推断,因而 Scaling Law 还会延续,但大模型不会从数据中自主的抽象概念并符号化,也不会具备真正的逻辑推理能力。

续篇简介

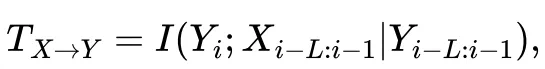

为了用信息论测度来衡量两个时间序列的 Granger 因果性,物理学界提出了传递熵的概念 [26]。从序列  到序列

到序列  的传递熵定义为

的传递熵定义为

其中 L 为相互影响的长度。后续的相关研究则进一步印证:对于向量高斯自回归过程,传递熵和 Granger 因果是等价的 [27]。另一方面,传递熵也是有限长度版本的定向信息。这一概念由 1988 年香农奖得主 James Massey 在 1990 年提出 [28]。他在论文中也讨论了带反馈的通信系统的因果性问题。由此,我们引出了后续两篇的主要内容:

本系列的第二篇,即信号处理篇,将深入探讨向量自回归时间序列与大模型之间的深刻联系。

本系列的第三篇,即信息论篇,将以定向信息为核心,探讨与结构无关的、更抽象、更本质的大模型第一性原理。

参考文献

1. B. Bai, "Forget BIT, it is all about TOKEN: Towards semantic information theory for LLMs," arXiv:2511.01202, Nov. 2025.

2. J. Hopfield, “Neural networks and physical systems with emergent collective computational abilities,” Proceedings of the National Academy of Sciences, vol. 79, no. 8, pp. 2554-2558, Apr. 1982.

3. D. Ackley, G. Hinton, and T. Sejnowski, "A learning algorithm for Boltzmann machines," Cognitive Science, vol. 9, no. 1, pp. 147-169, Jan. 1985.

4. G. Hinton, "A practical guide to training restricted Boltzmann machines," in Neural Networks: Tricks of the Trade, 2nd ed., Berlin, Germany: Springer, 2012, pp. 599-619.

5. E. Gardner, "The space of interactions in neural network models," Journal of Physics A: Mathematical and General, vol. 21, no. 1, pp. 257-270, Jan. 1988.

6. E. Gardner and B. Derrida, "Optimal storage properties of neural network models," Journal of Physics A: Mathematical and General, vol. 21, no. 1, pp. 271-284, Jan. 1988.

7. E. Gardner and B. Derrida, "Three unfinished works on the optimal storage capacity of networks," Journal of Physics A: Mathematical and General, vol. 22, no. 12, pp. 1983-1994, Jun. 1989.

8. M. Mezard, G. Parisi, and M. Virasoro, Spin Glass Theory and Beyond: An Introduction to the Replica Method and Its Applications. Singapore: World Scientific Publishing, 1987.

9. G. Parisi, In a Flight of Starlings: The Wonders of Complex Systems. Milan, Italy: Penguin Press, 2023.

10. A. Vaswani et al., "Attention is all you need," in Proc. 31st Annual Conference on Neural Information Processing Systems ’17, Long Beach, CA, USA, Dec. 2017.

11. E. Jaynes, Probability Theory: The Logic of Science. New York, NY, USA: Cambridge University Press, 2003.

12. A. Gu and T. Dao, "Mamba: Linear-time sequence modeling with selective state spaces," arXiv: 2312.00752, May 2024.

13. T. Dao and A. Gu, "Transformers are SSMs: Generalized models and efficient algorithms through structured state space duality," arXiv: 2405.21060, May 2024.

14. DeepSeek-AI, “DeepSeek-V3.2: Pushing the frontier of open large language models,” DeepSeek, Hangzhou, China, Dec. 2025.

15. T. Cover, "Geometrical and statistical properties of systems of linear inequalities with applications in pattern recognition," IEEE Transactions on Electronic Computers, vol. EC-14, no. 3, pp. 326–334, Jun. 1965.

16. M. Talagrand, Mean Field Models for Spin Glasses - Vol. 1: Basic Examples. Berlin, Germany: Springer, 2011.

17.M. Talagrand, Mean Field Models for Spin Glasses - Vol. 2: Advanced Replica-Symmetry and Low Temperature. Berlin, Germany: Springer, 2011.

18. H. Ramsauer et al., "Hopfield networks is all you need," arXiv: 2008.02217, 28 Apr. 2021.

19. M. Geva, R. Schuster, J. Berant, and O. Levy, "Transformer feed-forward layers are key-value memories," in Proc. ACL Conference on Empirical Methods in Natural Language Processing ‘21, Punta Cana, Dominican Republic, Nov. 2021, pp. 5484–5495.

20. J. Fang et al., "AlphaEdit: Null-space constrained knowledge editing for language models," arXiv: 2410.02355, 22 Apr. 2025.

21. W. Fei et al., "NeuralDB: Scaling knowledge editing in LLMs to 100,000 facts with neural KV database," arXiv: 2507.18028, 24 July 2025.

22. X. Niu, B. Bai, L. Deng, and W. Han, "Beyond scaling laws: Understanding transformer performance with associative memory," arXiv: 2405.08707, 14 May 2024.

23. M. Mohri, A. Rostamizadeh, and A. Talwalkar, Foundations of Machine Learning, 2nd ed. Cambridge, MA, USA: The MIT Press, 2018.

24. C. Granger, "Testing for causality: A personal viewpoint," Journal of Economic Dynamics and Control, vol. 2, no. 1, pp. 329-352, Jan. 1980.

25. J. Pearl, Causality: Models, Reasoning, and Inference, 2nd ed. New York, NY, USA: Cambridge University Press, 2009.

26. T. Schreiber, "Measuring information transfer," Physical Review Letters, vol. 85, no. 2, pp. 461-464, Jul. 2000.

27. L. Barnett, A. B. Barrett, and A. K. Seth, "Granger causality and transfer entropy are equivalent for Gaussian variables," Physical Review Letters, vol. 103, no. 23, p. 238701, Dec. 2009.

28. J. Massey, “Causality, feedback and directed information,” in Proc. IEEE International Symposium on Information Theory ‘90, Waikiki, HI, USA, Nov. 1990.