大家好,我是肆〇柒。今天要和大家分享的是一项来自香港理工大学的研究——LogicRAG。这项工作挑战了当前主流的GraphRAG范式,提出了一种无需预建图、按需生成动态逻辑结构的新型RAG框架。它不仅将复杂查询的处理成本从数千万Token降至不足两千,还在多个基准上实现了性能飞跃。接下来,让我们一起看看这项研究的核心。

大语言模型(LLM)在处理超出其知识范围的问题时常会产生幻觉,生成事实错误的陈述。检索增强生成(RAG)通过从知识库中检索与查询相关的上下文来支持LLM推理,有效缓解这一问题。RAG的核心思想是:给定输入查询Q,通过从外部知识库K中检索相关上下文C,然后使用语言模型生成回答A,即A = fRAG(Q, C),其中C = R(Q)。

假设有这样一个场景,当你的AI助手面对"比较二战期间美国和苏联的军事生产规模,并分析其对战争结果的影响"这样的复杂问题时,它会如何思考?传统RAG系统会简单地搜索"美国军事生产"、"苏联军事生产"等关键词,然后将结果拼凑成答案,往往导致逻辑断裂、事实矛盾。而GraphRAG虽然能构建知识图谱辅助推理,但构建一个高质量图谱可能需要3000万Prompt Token,相当于让GPT-4连续工作8小时,耗电约20美元——这样的成本让实时应用几乎不可能。

LogicRAG的提出,则无需预构建图谱,却能在推理时动态生成查询专属的逻辑结构,以1777.9 Prompt Token 的极低消耗,实现 64.7% 的复杂问题准确率,较最佳基线提升14.7个百分点。这项突破不仅解决了GraphRAG的效率瓶颈,更开创了一种"按需构建、逻辑驱动"的全新RAG范式。

阅读本文后,也许你将了解如何在不牺牲推理质量的前提下,将复杂查询处理成本降低80%,实现真正高效的逻辑推理增强。文内会讲到LogicRAG如何通过动态逻辑结构实现高效推理,揭示其三大核心技术模块的工作原理,并通过详实的数据解读展示其性能优势。我们通过对LogicRAG的理解,将获得一套可落地的复杂推理优化方案,以及对下一代RAG系统设计的深刻理解。

GraphRAG 的结构性困境

既然预构建图存在这些根本性问题,那么是否有方法既能保留图结构的优势,又避免其固有缺陷?LogicRAG给出了创新答案。在探讨LogicRAG之前,让我们先理解GraphRAG面临的结构性挑战。

效率瓶颈:预构建图的"隐形成本墙"

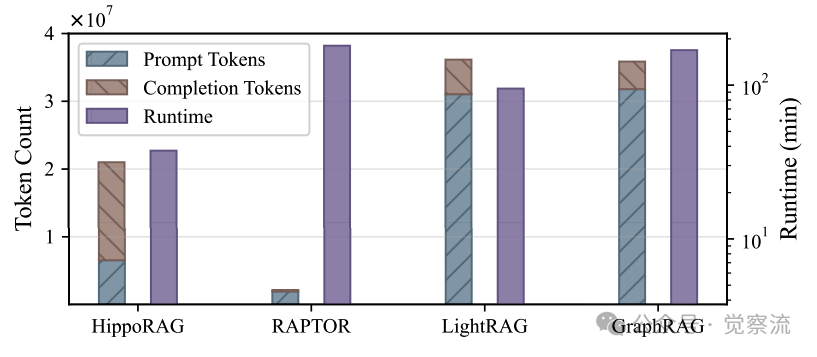

GraphRAG方法需要对整个语料库进行实体识别、关系抽取与图结构化处理。下图直观展示了这一过程的资源消耗:Microsoft GraphRAG在2WikiMQA数据集上消耗约4000万Prompt Token,HippoRAG消耗约3000万,RAPTOR和LightRAG分别消耗约1200万和1500万Prompt Token。

GraphRAG图构建的Token与运行时成本

以GPT-4的定价计算,仅图构建过程就可能花费数十美元;更严重的是,这一过程耗时可达数十甚至数百分钟,使知识库更新变得极其缓慢。在动态变化的知识场景中,昨天构建的图谱可能今天就已过时,但重新构建的成本高得令人却步。预构建图需要"一次性支付"高昂成本,却只为少数复杂查询提供价值,造成资源浪费。

结构错配:通用图谱与特定查询的"逻辑鸿沟"

预构建图是一种静态、通用的结构,而真实世界的查询类型多样、逻辑各异。研究显示,多跳问题主要分为四类:comparison(比较型)、bridge-comparison(桥接比较型)、compositional(组合型)和inference(推理型)。每种类型需要不同的逻辑结构支持:

- comparison类(如"比较A和B的特性"):需要并行检索与对比结构

- bridge类(如"A如何影响B"):需要链式推理结构

- compositional类(如"基于A、B和C推导D"):需要树状组合结构

- inference类(如"从现象推断原因"):需要因果推理结构

一个固定的图结构很难为所有查询提供最优的推理路径。实际场景中的查询类型和复杂程度各不相同,需要匹配不同的逻辑结构才能精准推理。预构建图与特定查询间的"逻辑鸿沟",导致检索出的信息与实际需求严重脱节。

拓扑排序就像安排一个项目的工作流程,确保先完成依赖任务(如先打地基再建墙),再处理后续工作,这是LogicRAG确保推理顺序逻辑一致的关键机制。而在预构建图中,这种针对特定查询的逻辑排序难以实现。

质量隐患:自动构建图的"噪声陷阱"

当前GraphRAG普遍依赖LLM自动构建图结构,缺乏有效引导。自动构建的图中常包含大量与任务无关的节点,导致检索精度下降。例如,当查询聚焦于"历史事件比较"时,图谱可能错误地包含大量无关的人物关系节点,不仅增加了噪声,还分散了推理注意力。

这些结构性困境共同指向一个根本问题:我们是否必须为所有查询"预付"高昂的图构建成本,来换取少数复杂查询的性能提升? LogicRAG给出了否定的回答。

LogicRAG 核心理念:动态生成推理结构

LogicRAG的核心思想是:推理结构不应是预设的、静态的图,而应是随查询动态生成的、专属的逻辑依赖图。这一范式转变解决了GraphRAG的根本矛盾——将"通用图索引"转变为"查询专属推理结构"。

范式转变的三大维度

LogicRAG实现了从"图索引驱动"到"逻辑结构驱动"的范式转变,具体体现在三个维度:结构生成时机从"训练/预处理时构建"变为"推理时动态构建",结构粒度从"语料级通用图"变为"查询级专属DAG",结构目的从"通用知识组织"变为"特定任务推理规划"。

在结构生成时机上,传统GraphRAG需要离线构建,一次构建,多次使用,而LogicRAG则在线构建,按查询即时生成,即用即弃。在结构粒度上,传统GraphRAG构建的是整个知识库的全局图谱,而LogicRAG只构建针对当前查询的轻量级有向无环图(DAG)。在结构目的上,传统GraphRAG为所有查询提供统一的检索框架,而LogicRAG为每个查询定制最优的推理路径。

注:有向无环图(DAG) - 一种没有循环依赖的结构,确保任务按逻辑顺序执行。就像做菜必须先备料再烹饪,不能颠倒顺序。

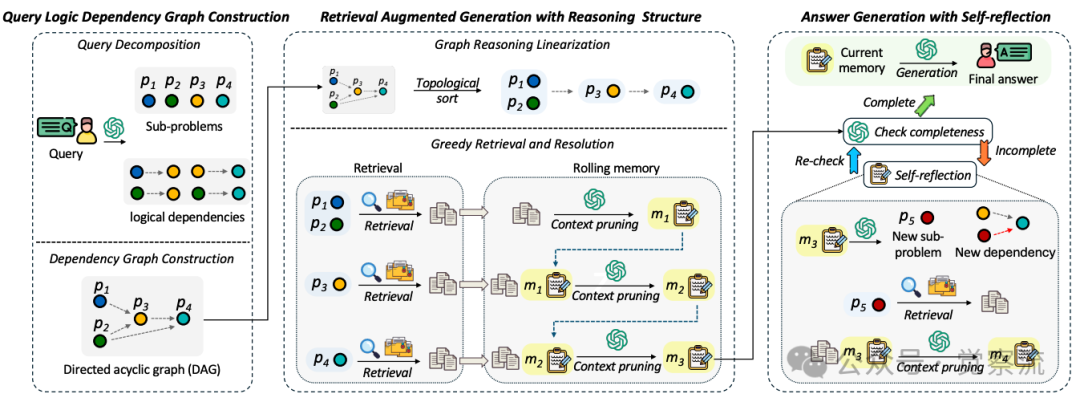

三阶段推理流水线

LogicRAG通过三个阶段形成闭环推理流水线,每个阶段都针对GraphRAG的缺陷进行了针对性优化。首先,在查询分解与图构建阶段,将复杂查询拆解为子问题,并建立逻辑依赖关系,避免预构建图的成本,仅构建当前查询所需的最小推理结构,并通过LLM+few-shot prompting确保分解精度。

其次,在图推理线性化阶段,通过拓扑排序将DAG转化为可执行序列,解决RAG与逻辑推理的"操作不对称性"问题,确保子问题按逻辑依赖顺序被解决。最后,在双维剪枝优化阶段,通过上下文剪枝防止信息膨胀,通过图剪枝减少冗余检索。

这一设计使LogicRAG既能像GraphRAG一样支持复杂逻辑推理,又避免了其高昂的预处理成本,真正实现了"按需构建、按需推理"。

LogicRAG框架流程图

LogicRAG的范式转变解决了RAG领域的一个根本矛盾——如何在不增加预处理成本的情况下支持复杂逻辑推理。它不再将图视为必须预先构建的基础设施,而是作为查询处理过程中的临时辅助工具。

关键技术模块详解

Query Logic Dependency Graph 构建

LogicRAG的起点是将输入查询 Q 分解为一组子问题 P={p1,p2,...,pn},每个子问题对应DAG中的一个节点vi。边集 E 则表示子问题间的逻辑依赖关系。

在数学上,LogicRAG将查询Q表示为有向无环图G=(V,E),其中V={v_1, v_2, ..., v_n}代表子问题节点集合,E⊆V×V表示它们之间的逻辑依赖关系。

与简单地将查询拆分为关键词不同,LogicRAG采用LLM结合few-shot prompting技术进行精准任务分解。这一设计确保了分解的准确性与合理性。

例如,对于查询"比较二战期间美国和苏联的军事生产规模,并分析其对战争结果的影响",LogicRAG会分解为:

- p1 :美国在二战期间的军事生产规模

- p2:苏联在二战期间的军事生产规模

- p3 :美国军事生产对战争结果的影响

- p4 :苏联军事生产对战争结果的影响

- p5 :美国与苏联军事生产的比较分析

每个子问题都具有明确的语义边界和可检索性,避免了传统方法中常见的模糊边界问题。

在分解后,LogicRAG通过LLM推断子问题间的逻辑依赖关系。例如,p5 依赖于p1和p2(比较需先有数据),p3依赖于p1(影响分析需先有生产数据),p4依赖于p2(同理)。这些依赖关系形成DAG的边集。随后,系统通过拓扑排序验证图的无环性,确保推理路径的逻辑一致性。如果发现循环依赖(如A依赖B,B又依赖A),系统会重新调整依赖关系。

LogicRAG最具创新性的是其动态扩展能力。当某子问题的检索结果不足以得出结论时,系统会通过LLM的自我反思机制触发图的动态扩展。系统完成检索后,LLM检查答案完整性,如发现信息不足("Self-reflection Incomplete"),触发"Re-check"模块,LLM生成新的子问题 并更新依赖关系,系统继续推理,直至答案完整。

让我们通过一个具体案例来理解这一过程。考虑MuSiQue数据集中的三跳问题:"What month did the Tripartite discussions begin between Britain, France, and the country where, despite being headquartered in the nation called the nobilities commonwealth, the top-ranking Warsaw Pact operatives originated?"

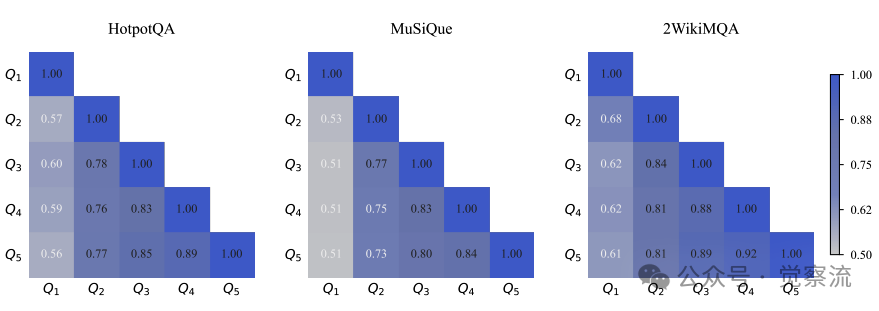

子查询相似性热力图

上图的子查询相似性热力图直观展示了多轮推理中子查询间的相似度变化。想象一个5×5的表格,左上到右下对角线是深色(相似度1.0),而右上角逐渐变浅,表明越往后生成的子查询与初始查询越不相似。

1. 第一轮检索:查询"Warsaw Pact",检索到"华沙条约是由苏联和七个东欧社会主义国家在华沙签署的集体防御条约"

2. 第二轮检索:查询"nobilities commonwealth",检索到"华沙条约成员国几乎都由苏联间接控制"

3. 第三轮检索:查询"Tripartite negotiations",检索到"在六月中旬,主要的三方谈判开始"

4. 答案生成:结合所有信息,确定"nobilities commonwealth"指代苏联,回答"六月"

这一案例展示了LogicRAG如何通过多轮检索逐步解析复杂查询,将模糊的"nobilities commonwealth"识别为苏联,并最终确定谈判开始的月份。

LogicRAG的DAG构建不是一次性完成的,而是随着检索反馈动态调整的过程,这使其能够适应实际检索结果,避免预设结构的僵化。

Graph Reasoning Linearization

尽管DAG能清晰表达逻辑依赖,但RAG系统通常以独立查询方式执行检索,难以直接处理相互依赖的子问题。若不加调度,易陷入递归调用或语义漂移。

论文中明确指出了这一核心矛盾:RAG默认每个查询都是独立且完整的,而推理则需要按顺序处理层层嵌套、彼此依赖的子问题,每一步的中间结果都要沿着逻辑链条整合并传递下去。

这种不对称性导致子问题间缺乏上下文传递、递归依赖导致效率低下、语义漂移使推理链断裂。

为解决这一问题,LogicRAG对DAG进行基于深度优先搜索(DFS)的拓扑排序,得到一个线性序列 <p(1),p(2),...,p(n)>,确保每个子问题在其所有前置依赖之后被处理。

以一个四步推理问题为例:

- p1:A的高度

- p2 :B的高度

- p3:A与B的高度差

- p4:高度差对结果的影响

拓扑排序后,序列应为p1-> p2->p3->p4,确保逻辑一致性。

该过程时间复杂度为 O(V+E),高效可行。对于典型的复杂查询,子问题数量通常在5-10个之间,拓扑排序的开销微乎其微。

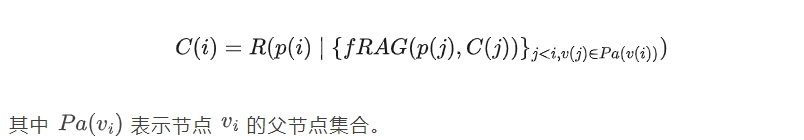

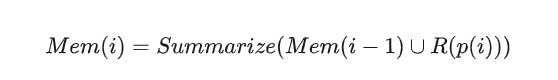

排序后,系统按此顺序贪心地解决每个子问题。关键在于,每个子问题 的检索上下文不仅基于其自身,还依赖于其父节点的已解决结果:

这表示第i个子问题的检索不仅基于其自身语义,还动态依赖其父节点的推理结果。例如,要回答"A比B高多少?",必须先检索"A的高度"和"B的高度",再进行比较。

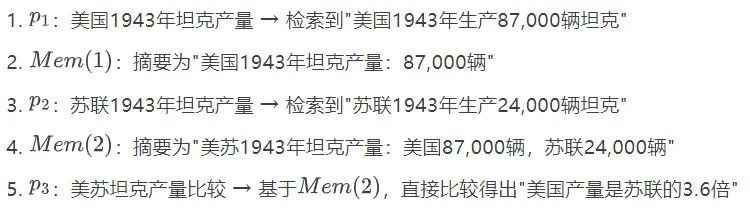

在实现中,系统维护一个"滚动记忆"(Rolling Memory),在每一步将新检索内容与历史记忆合并,并通过LLM摘要提炼关键信息:

这相当于一个"滚动记忆"机制,每一步都将新检索内容与历史摘要合并,并由LLM提炼关键事实,防止上下文爆炸,类似人类"边读边记要点"。

以一个具体案例说明:

这种上下文感知的检索确保了推理的连贯性与准确性,避免了传统多步RAG中常见的语义漂移问题。

双维剪枝机制

为控制推理成本,LogicRAG设计了"图剪枝"与"上下文剪枝"双重机制,显著减少冗余操作。

上下文剪枝通过"滚动记忆"机制解决上下文膨胀问题。随着推理推进,累积的上下文可能迅速膨胀。例如,一个5步推理问题可能累积50+文档片段,远超LLM的上下文窗口。

"滚动记忆"机制将新检索内容与历史记忆合并,并通过LLM摘要提炼关键信息,仅保留最相关事实用于下游推理。在实现中,系统使用LLM的摘要能力,将冗长的上下文压缩为关键事实。例如,将"美国1943年生产87,000辆坦克,其中谢尔曼坦克占70%"压缩为"美国1943年坦克产量:87,000辆(谢尔曼70%)"。

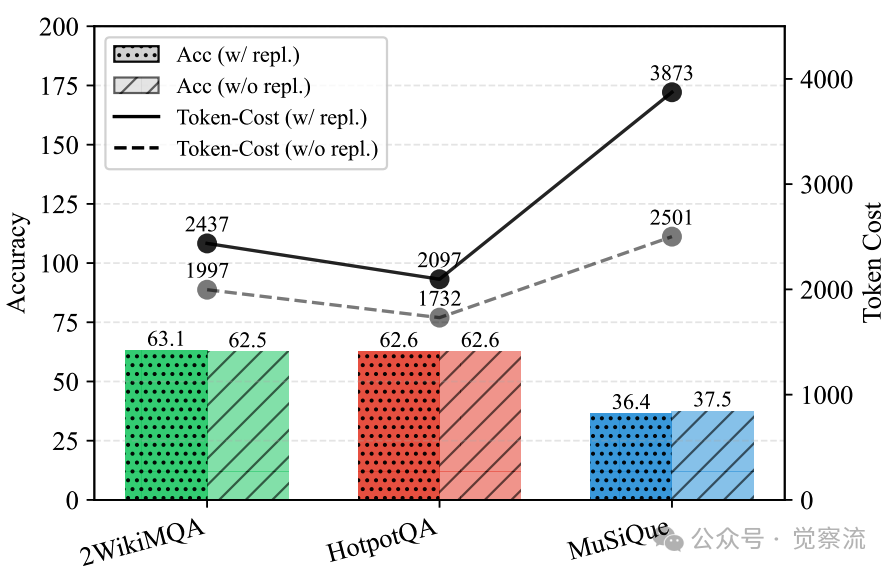

图剪枝针对语义相近的子问题。对于处于同一拓扑层级(即具有相同"topological rank")的子问题集合 S(i),若其逻辑独立或语义相似,系统将其合并为一个统一查询:

对于同一层级的并行子问题(如"查A的出生地"和"查B的出生地"),系统将其合并为"查A和B的出生地",一次检索完成多项任务,减少冗余调用。

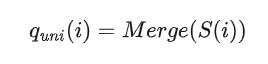

下图的实验数据直观展示了这一效果:图剪枝使compositional类问题的平均检索轮次从4.2降至2.1,效率提升近一倍;在bridge-comparison类问题上,检索轮次从3.8降至2.5,同样显著减少。

图剪枝效果对比

这一机制特别适用于comparison类问题,如"比较A和B的特性",其中多个子问题往往具有高度相似的检索需求。

采样策略:防止犹豫的前向推进机制

在多轮推理中,LLM常因不确定性而反复生成相似子查询,陷入"犹豫"("hesitation")状态。

图3的热力图清晰展示了这一问题:随着推理轮次推进,后续生成的子查询与前一轮的Jaccard相似度普遍超过0.7,表明LLM陷入语义重复的"犹豫"状态。在HotpotQA中,第五轮子查询与第一轮的相似度仍高达0.56;在MuSiQue中,这一数字为0.51;在2WikiMQA中甚至达到0.61。

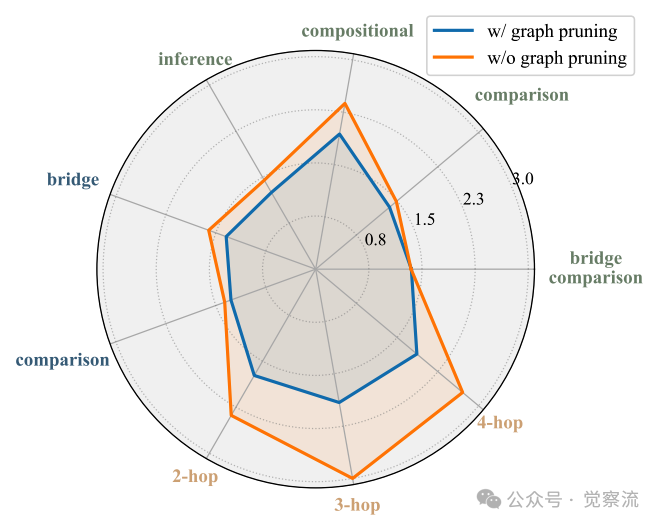

下图的对比实验清晰展示了无放回采样策略的优势:无放回采样在HotpotQA上将Token消耗从3873降至2501,降幅达35%,而准确率保持在62.6%不变。

有放回与无放回采样对比

这一设计确保了推理过程的高效与确定性,有效解决了多步推理中的"犹豫问题"。在三个数据集上,不放回采样始终能在保持答案质量相当的前提下,显著降低每个问题的token成本。

实施从传统RAG迁移到LogicRAG的主要工作量在于实现查询分解和DAG构建模块,预计需要2-3周开发时间。但收益显著:无需图构建的预处理成本,推理Token消耗降低40%,复杂查询准确率提升14.7%。

实验验证:性能与效率双优

在HotpotQA、MuSiQue和2WikiMQA三大多跳问答基准上的实验表明,LogicRAG在性能与效率上均优于现有方法。

主结果对比:全面领先

下表展示了LogicRAG与各基线模型在三个数据集上的表现:

类型 | 模型 | HotpotQA | 2WikiMQA | MuSiQue |

Str-Acc. | LLM-Acc. | Str-Acc. | ||

Zero-shot LLM | GPT-4o-mini | 38.7 | 36.3 | 26.4 |

Vanilla RAG | VanillaRAG(Top-5) | 44.1 | 53.9 | 46.7 |

Graph-based RAG | HippoRAG2 | 56.7 | 61.9 | 50.0 |

Ours | LogicRAG | 54.8 | 62.6 | 64.7 |

关键发现:LogicRAG在2WikiMQA上实现64.7%字符串准确率,较最佳基线HippoRAG2提升14.7个百分点;在MuSiQue上达到30.4%字符串准确率,优于HippoRAG2 3.4个百分点;在HotpotQA上获得54.8%字符串准确率,略低于HippoRAG2但推理更高效。

这些结果验证了动态逻辑结构对复杂推理的有效支持。特别值得注意的是,LogicRAG在2WikiMQA上的巨大优势(+14.7%)表明,其动态推理结构特别适合处理需要复杂逻辑组合的问题。

效率优势:无需图构建的轻量级优势

表4对比了各模型在2WikiMQA上的查询时效率:

方法 | 平均时间(秒) | 平均Token |

HippoRAG2 | 5.89 | 2809.2 |

LogicRAG | 9.83 | 1777.9 |

RAPTOR | 5.79 | 2568.0 |

LightRAG | 35.14 | 5730.6 |

虽然LogicRAG的响应时间略长于部分基线,但其Token消耗显著更低(1777.9 vs. HippoRAG2的2809.2)。更重要的是,这一成本不包含图构建开销——而其他GraphRAG方法的图构建本身即需数千万Prompt Token与数十分钟时间。

这一效率优势使LogicRAG特别适合动态更新的知识库场景、低延迟部署环境以及资源受限的边缘设备。

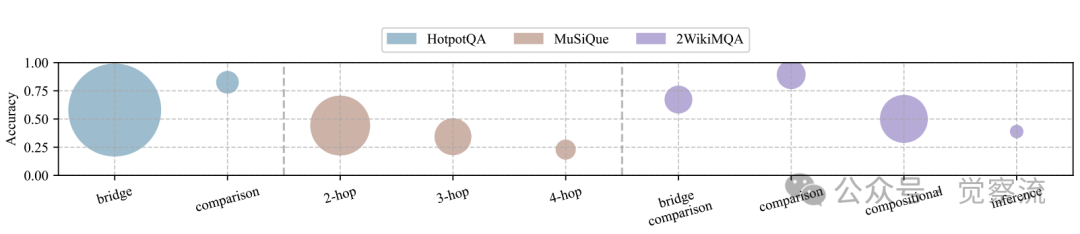

问题类型性能分析:结构归因的深度洞察

下图通过球形图展示了LogicRAG在不同问题类型上的表现分布,每个球体的Y轴位置表示准确率,半径反映该类型在数据集中的占比。

不同问题类型上的准确率分布

上图中,球体的Y轴位置越高表示准确率越高,半径越大表示该问题类型在数据集中占比越大。例如,在HotpotQA中,comparison类问题(位于顶部)准确率高达83%,且占比适中。

关键发现与归因分析:在HotpotQA上,comparison类问题准确率达83%,显著高于bridge问题(58%)。这归因于comparison类问题逻辑结构清晰(A vs B),DAG易于建模为"先查A属性→查B属性→比较",且图剪枝能高效合并并行检索。

在2WikiMQA中,compositional类问题占比44.4%,但准确率仅50%。这是因为compositional类问题涉及多实体、多关系的复杂组合,LLM在分解时易遗漏隐含依赖,导致推理链断裂。

在MuSiQue中,准确率随推理步数增加而下降。这归因于多步推理中上下文累积导致信息稀释,且LLM的"过早自信"现象使4-hop问题的平均检索轮次反而低于3-hop问题。

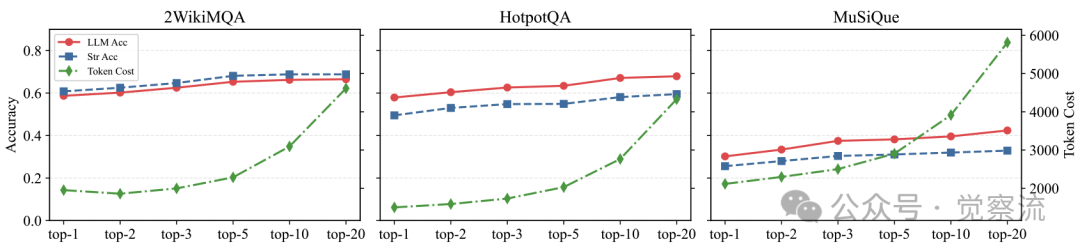

Top-k选择的效率-效果权衡

下图展示了top-k选择对效率与效果的影响,形成了清晰的Pareto前沿。

top-k选择的效率-效果权衡

上图的Pareto前沿显示,k值增加会提升准确率但Token成本急剧上升。在2WikiMQA中,k=5后准确率提升显著放缓;在MuSiQue中,k=20时Token成本超过6000,但准确率提升有限。

关键发现:所有数据集上,准确性随k增加而提升,但收益递减。2WikiMQA上,k=5后提升显著放缓;HotpotQA上,LLM准确率在k=10左右饱和;MuSiQue上,提升更平缓,反映其知识分布更分散。同时,k增加导致Token成本急剧上升,尤其在MuSiQue中,k=20时平均成本超6000 tokens。

这一分析表明,k=3或k=5通常提供最佳平衡,这也解释了为什么LogicRAG的"滚动记忆"上下文剪枝机制如此重要——它能在不增加k值的情况下保持高质量上下文。

新范式的意义与边界

范式意义:从"图增强"到"逻辑感知"

LogicRAG的提出,标志着RAG技术从"图增强"向"逻辑感知"的演进。其核心贡献不在于某个具体模块,而在于将查询的内在逻辑显式建模为可执行的推理结构,并以此动态指导检索与生成。

与IRCoT依赖固定检索计划不同,LogicRAG动态构建推理结构;与Think-on-Graph依赖静态知识图谱不同,LogicRAG无需预构建任何图结构。这种差异使LogicRAG在处理多样化查询时具有天然优势。

这一新范式在三类场景中优势显著:复杂多跳推理中,通过DAG建模逻辑依赖,支持结构化推理;动态知识库中,无需重复图构建,支持即时更新;低延迟部署中,避免预处理开销,适合实时应用。

LogicRAG的成功证明:推理结构不应是预设的、静态的图,而应是随查询动态生成的、专属的逻辑依赖图。

LogicRAG的三大核心价值

LogicRAG不仅是一项技术改进,更代表了一种新的RAG设计哲学。通过本文的深入分析,我们可以将其核心价值结构化为以下三点:

效率革命:通过消除预构建图的成本,使复杂推理变得轻量可行。LogicRAG消除了数千万Prompt Token的图构建开销,通过双维剪枝将Token消耗降至1777.9,同时保持9.83秒的低延迟响应。

逻辑显式化:将隐式推理过程转化为显式逻辑结构。LogicRAG通过DAG建模子问题间的逻辑依赖,通过拓扑排序确保推理顺序的逻辑一致性,通过动态扩展适应实际检索反馈。

按需构建:从"一刀切"到"定制化"的范式转变。LogicRAG为每个查询生成专属推理结构,根据问题类型自适应调整推理策略,仅构建当前查询所需的最小推理结构。

LogicRAG的核心思想——"按需构建、逻辑驱动"——不仅限于问答任务,其潜力远超当前应用。在任务扩展方面,可应用于规划、决策等需多步推理的场景;在领域扩展方面,在医疗诊断、法律分析等专业领域大有可为;在系统集成方面,可与符号推理、形式化方法结合,构建混合推理系统。

如何应用LogicRAG

对于希望将LogicRAG应用于实际场景的开发者,下面是一份简单的应用直男。

最适合的应用场景:多跳问答任务(如HotpotQA、MuSiQue类型的问题);需要逻辑推理的任务(比较、因果推断等);知识库频繁更新的场景(避免图重建成本)。

实现关键步骤:首先,使用few-shot prompt模板进行精准查询分解;其次,通过LLM推断子问题间的逻辑依赖关系,形成有向无环图;然后,对DAG进行拓扑排序,确保子问题按逻辑顺序处理;接着,实施双维剪枝:图剪枝(合并具有相同拓扑层级的语义相似子问题)和上下文剪枝(实现滚动记忆机制);最后,采用无放回采样策略,强制推理过程向前推进,避免"犹豫"状态。

常见挑战及解决方案:当LLM在查询分解时遗漏关键子问题,应增强few-shot示例,明确包含compositional类问题的分解案例;当多步推理中出现信息稀释,应优化滚动记忆的摘要策略,保留关键事实和数值,避免过度概括;当复杂问题的DAG构建质量不高,应引入验证机制,确保DAG的逻辑一致性,如通过LLM检查是否存在循环依赖。

现在开始,我们可以尝试用LogicRAG框架重新审视你当前的RAG系统:

1. 识别一个需要多跳推理的复杂查询

2. 手动绘制其逻辑依赖图(DAG)

3. 设计拓扑排序后的执行序列

4. 实现简单的上下文剪枝机制你将立即体验到动态逻辑结构带来的推理质量提升!

在知识快速更新、查询高度多样化的现实世界中,这种灵活适应查询需求的推理增强范式,有望成为下一代RAG系统的核心设计理念。

LogicRAG告诉我们:真正智能的RAG系统不应被静态结构所束缚,而应具备根据查询动态生成推理策略的能力。这一思想将引领RAG技术进入一个更高效、更灵活、更智能的新时代。