应用

微软深夜放大招:GPT-4 、DALL·E 3、GPTs免费用,自研大模型专用AI芯片

今天凌晨,微软公司召开最新一场 Ignite 大会,CEO 萨提亚・纳德拉在大会上介绍了 100 多项产品和技术的发布与更新,涉及范围非常广泛,包括应用、生产力以及安全性等多个方面。Microsoft Ignite 是该公司为开发人员和 IT 专业人士举办的年度会议,而生成式 AI 的一切无疑是本年度的最大热点。不出意外,在本次大会上,我们看到了来自 Bing Chat、专用 AI 芯片、Windows、Microsoft 365 和 Azure 等业务的最新动态。大会现场还请来了英伟达创始人黄仁勋,之后微软会将

当韩国女团BLACKPINK进军二次元,清华叉院AI神器原来还能这么玩

看看这个 AI 生成的女团 MV 效果如何。如果你手机里有一些修图软件,你可能用过里面的「AI 绘画」功能,它通常会提供一些把照片转换为不同风格的选项,比如动漫风格、写真风格。但如今,视频也可以这么做了:这些动图来自 X 平台(原推特)网友 @CoffeeVectors 生成的一段视频。他把韩国女团 BLACKPINK 代表作《DDU-DU DDU-DU》的原版 MV 输入了一个 AI 工具,很快就得到了动漫版的 MV。完整效果是这样的:这个视频是借助一个名叫 ComfyUI 的工具来完成的。ComfyUI 是一个

当数据成为「生产资料」,三篇论文总结如何用水印技术保护AI训练数据版权

1、引言 -- 为什么要在 AI 训练数据中添加水印?深度神经网络(DNN)以其高效率和高效益被广泛应用于许多关键任务应用和设备中。高质量的已发布(如开源或商业)数据集是 DNNs 技术发展的关键因素之一。研究人员和开发人员利用这些数据集验证其模型的有效性,进而加快 DNN 的开发。这些已发布数据集非常有价值,但收集数据的过程通常耗时且非常昂贵。在这样的应用背景下,在 AI 训练数据中添加水印,对于保护数据集免遭未经授权的使用以及保护数据创作者的版权具有重大的意义,值得深入研究和探讨。目前,已有的一些数据保护技术,

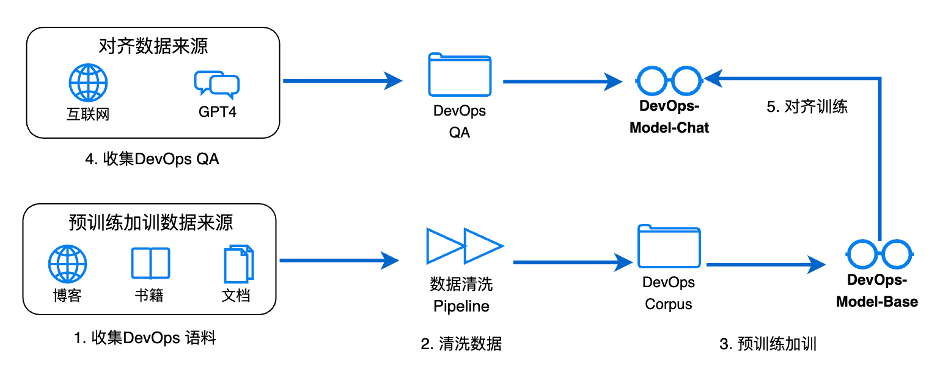

让天下没有难做的开发和运维,DevOps终于有了专属大模型,蚂蚁和北大联合发布

大语言模型在各类 NLP 下游任务上都取得了显著进展,各种垂直领域大模型更是如雨后春笋般层出不穷。然而在 DevOps 领域,却迟迟没有相关大模型问世。为填补这方面的空白,蚂蚁集团联合北京大学发布了面向中文 DevOps 领域的首个开源大语言模型,即 DevOps-Model 。该大模型旨在帮助开发人员在软件开发和运维的整个生命周期中提高效率,最终目标是实现在 DevOps 流程中面临任何问题时,都可以通过向 DevOps-Model 提问来获取解决方案!当前已经开源了 7B 和 14B 两种规格的 Base 和

230页长文,涵盖5大科学领域,微软团队使用GPT-4探索LLM对科学发现的影响

编辑 | 紫罗前不久,微软 DeepSpeed 团队启动了一个名为 DeepSpeed4Science 的新计划,旨在通过 AI 系统优化技术实现科学发现。11 月 13 日,微软团队在 arXiv 预印平台发表题为《大型语言模型对科学发现的影响:使用 GPT-4 的初步研究》(「The Impact of Large Language Models on Scientific Discovery: a Preliminary Study using GPT-4」)的文章。文章篇幅长达 230 页。论文链接:,自然

WPS AI开启公测,将面向全体用户陆续开放体验

11 月 16 日,金山办公宣布旗下具备大语言模型能力的人工智能办公应用 WPS AI 开启公测,AI 功能面向全体用户陆续开放体验。即日起,用户可以前往 WPS AI 官网 (ai.wps.cn) 申请权益,并下载最新版 WPS PC 客户端限时体验文字 / 智能文档、表格 / 智能表格、PPT 演示组件的 AI 能力。另外,安卓、iOS 和 Mac 端的 AI 功能也将于 11 月底陆续开放。WPS AI 自今年 4 月 18 日首次对外亮相以来,持续优化了产品体验。5 月 16 日,WPS AI 对外展示了类

超详细!Stable Diffusion 卡通IP调整姿势保姆级教程

已有 IP 如下所示图左,希望将改成类似图右的姿势,该怎么用Stable Diffusion 实现呢,完整教程来了!

往期教程:首先经过测试 SD 的 Controlnet Openpose 无法识别卡通形象的骨骼,因此需要我们用 Openpose editer 手动添加骨骼图,大致得到以下骨骼图,点击按钮发送到 Controlnet,为了方便后续使用,可以将骨骼图下载下来备用;接下来的思路:首先需要在 SD 中跑出和图 1 形象,这样后续才可以在 SD 中做控制和重绘等工作,并让形象按新骨骼换姿势

得到相似度高的

比ChatGPT早发两周,被喷下线的Galactica成了LeCun最大的意难平

今天我们提到大型语言模型(LLM),第一个想到的就是 OpenAI 的 ChatGPT。一年来,ChatGPT 因其强大的性能,广泛的应用前景而爆火出圈。但谈到大型语言模型,ChatGPT 并不是第一个。一年前,也就是 OpenAI 发布 ChatGPT 的前两周,Meta 发布了一个名为 Galactica 的试用版模型。作为一个大型语言模型,Galactica 是在大量的论文、参考资料、知识库和许多其他来源的科学语料库上进行训练的,包括超过 4800 万篇论文、教科书和讲义、数百万种化合物和蛋白质知识、科学网站

幻觉率直降40%,中国电信千亿参数「星辰大模型」炸场,业界首提缓解多轮幻觉解决方案

经历了 2023 年「百模大战」的洗礼,不管是国内还是海外,不管是开源还是闭源,各家大模型都从追赶和超越中获得了实质的进步。在语言、语音、视觉领域,大模型已经获得了强大的生成能力,不仅能在几秒钟之内生成非常合理的内容,甚至可以媲美拥有多年技能和知识储备的专家。这些进展似乎为「大模型超越人类智能」的说法提供了令人信服的证据,也具象化了大模型规模化落地的前景。按照目前的进展情况,2024 年很可能会成为大模型部署元年。但同样需要注意的是,大模型在技术上仍然存在一些关键缺陷,这或许会导致应用之路并不一定如想象中顺利。业界

最强AI芯片英伟达H200深夜发布,Llama2-70B推理提速90%,2024年二季度发货

芯片巨头英伟达,又打出一张王牌。英伟达在 2023 年全球超算大会(SC2023)上发布了目前世界上最强的 AI 芯片 H200。这款新的 GPU 基于 H100 进行了升级,内存带宽提高了 1.4 倍,内存容量提高了 1.8 倍,提高了处理生成式 AI 任务的能力。该公司高性能计算和超大规模数据中心业务副总裁 Ian Buck 表示:「英伟达在硬件和软件上的创新正在缔造新型 AI 超算。」英伟达在官方博客中表示:NVIDIA H200 Tensor Core GPU 具有改变游戏规则的性能和内存功能,可增强生成式

可跨学科理解、多尺度建模,MIT LAMM发布微调的大语言模型 MechGPT

编辑 | 萝卜皮几个世纪以来,研究人员一直在寻找连接不同领域知识的方法。随着人工智能的出现,我们现在可以探索跨领域(例如,力学-生物学)或不同领域(例如,失效力学-艺术)的关系。为了实现这一目标,麻省理工学院(MIT)原子与分子力学实验室 (Laboratory for Atomistic and Molecular Mechanics,LAMM)的研究人员使用了经过微调的大型语言模型 (LLM),来获取多尺度材料失效的知识子集。该方法包括使用通用 LLM 从原始来源中提取问答对,然后进行 LLM 微调。由此产生的

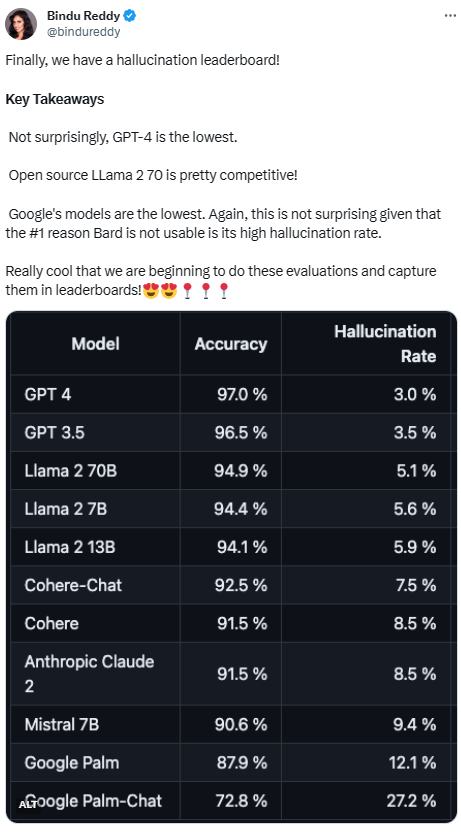

大模型幻觉率排行:GPT-4 3%最低,谷歌Palm竟然高达27.2%

排行榜一出,高下立见。人工智能发展进步神速,但问题频出。OpenAI 新出的 GPT 视觉 API 前脚让人感叹效果极好,后脚又因幻觉问题令人不禁吐槽。幻觉一直是大模型的致命缺陷。由于数据集庞杂,其中难免会有过时、错误的信息,导致输出质量面临着严峻的考验。过多重复的信息还会使大模型形成偏见,这也是幻觉的一种。但是幻觉并非无解命题。开发过程中对数据集慎重使用、严格过滤,构建高质量数据集,以及优化模型结构、训练方式都能在一定程度上缓解幻觉问题。流行的大模型有那么多,它们对于幻觉的缓解效果如何?这里有个排行榜明确地对比了

三秒4张图!让 Stable Diffusion 出图速度暴增的新一代生成模型LCM

大家好,这里是和你们一起探索 AI 的花生~

最近一种新的图像生成形式逐渐兴起,即生成的图像会随输入的文字或笔画动作迅速变化,这让图像生成有了更多灵活探索和准确控制的空间。这种「实时反馈」的感觉源于模型能在几秒钟内,根据输入生成新的内容,而之所以能有这么快的生成速度,依靠的就是 LCM 这项新技术。视频内容来源: :

一、LCM 简介

LCM 项目主页:

Github 主页:

LCM 全称 Latent Consistency Models(潜在一致性模型),是清华大学交叉信息科学研究院研发的一款生成模型。它

AI浪潮下,XR设计师一定要掌握的设计工具(上篇)

引言

随着 AI 浪潮的爆发,各种赋能于绘画、UI 及 3D 美术领域的设计工具都发生了革新,提升了设计效。本期作者将介绍从上百个 AI 设计工具及插件中筛选出好用的提效设计工具,这些对 XR 设计师及产品经理可以快速上手且高效赋能的好工具,希望能帮助到大家日常的学习和工作。

更多XR干货:一、文案生成

1. ChatGPT

业界知名的公司 Open AI 出品的 AI 聊天机器人程序,ChatGPT 是一个由 OpenAI 开发的自然语言处理模型,这个模型被设计用于各种自然语言处理任务,如聊天对话、问答、文本生成

基于LLaMA却改张量名,李开复公司大模型开源行为引争议,官方回应来了

机器之心报道机器之心编辑部有研究者发现,李开复「零一万物」公司的 Yi-34B 模型基本上采用了 LLaMA 的架构,只是重命名了两个张量。对此,「零一万物」给出了官方回应。前段时间,开源大模型领域迎来了一个新的模型 —— 上下文窗口大小突破 200k,能一次处理 40 万汉字的「Yi」。这个大模型由创新工场董事长兼 CE0 李开复创立的大模型公司「零一万物」构建,包括了 Yi-6B 和 Yi-34B 两个版本。根据 Hugging Face 英文开源社区平台和 C-Eval 中文评测榜单,Yi-34B 推出时取得

可跨学科理解、多尺度建模,MIT LAMM 团队发布微调的大语言模型 MechGPT

编辑 | 萝卜皮 几个世纪以来,研究人员一直在寻找连接不同领域知识的方法。随着人工智能的出现,我们现在可以探索跨领域(例如,力学-生物学)或不同领域(例如,失效力学-艺术)的关系。为了实现这一目标,麻省理工学院(MIT)原子与分子力学实验室 (Laboratory for Atomistic and Molecular Mechanics,LAMM)的研究人员使用了经过微调的大型语言模型 (LLM),来获取多尺度材料失效的知识子集。该方法包括使用通用 LLM 从原始来源中提取问答对,然后进行 LLM 微调。由此产生

阿里巴巴“AI驱动”战略提速,夸克发布自研大模型

国产大模型阵营再添新锐选手。11月14日,阿里巴巴智能信息事业群发布全栈自研、千亿级参数的夸克大模型,将应用于通用搜索、医疗健康、教育学习、职场办公等众多场景。夸克App将借助自研大模型全面升级,加速迈向年轻人工作、学习、生活的AI助手。近期,在CMMLU权威大模型性能评测中,夸克大模型成绩位列榜首。最新评测显示,夸克大模型整体能力已经超过GPT-3.5,在写作、考试等部分场景中优于GPT-4。国产自研大模型中的“学霸”夸克大模型是基于Transformer架构、自主研发的多模态大模型,每天会对亿级的图文数据进行训

第二波!2023年11月精选实用设计工具合集

大家好,这是 2023 年 11 月的第 2 波干货合集!这次的合集有些有意思的东西,比如 open AI 出品的文本冒险游戏,基于 ChatGPT 的第三方插件或者说工具,有专业的玻璃拟物化设计系统,当然我最喜欢的还是适合社交媒体分享内容的卡片内容设计工具,因为它借助视觉模板搞定了相当一部分设计工作。

当然,在此之前记得看看往期干货中有没有你感兴趣的素材:下面我们具体看看这一期的干货:

1、质感十足的玻璃拟物化设计系统

DesignCode UI,整体的质感还是相当惊艳的,因为它采用了目前各大操作系统都拥抱的玻

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉