应用

英伟达梦想,富士康模式:Alexander Wang如何用24万数字游民打造数据标注王国

这位世界上最年轻的白手起家的亿万富翁,曾在首次登上福布斯排行榜后迅速跌落,但几年后就重新夺回了这一头衔。 给 Alexander Wang 带来这个极具传奇性的名号的,是他的数据工厂—— Scale AI。 最近,Scale AI 实现了将近 10 亿美元的年化收入,同比增长了足足 4 倍。

首个开源 AI 候选版定义稿发布:四大要求,训练数据上有妥协

如何定义开源人工智能(AI)?开源倡议组织(OSI)经过 2 年的努力,于昨日(10 月 9 日)发布了首个开源 AI 定义候选版本。首个候选版本主要澄清开源 AI 领域的各种争议,规定一个 AI 系统 / 模型需要具备以下 4 种基础自由要求,才能视为开源,AI在线附上相关要求如下:在未获许可的情况下,他人可出于任何目的使用该系统。可以深入研究系统的运行原理出于任何目的修改系统。与他人共享,无论是否修改。OSI 在训练数据方面选择妥协,要求提供“关于用于训练系统的数据的足够详细信息”,而非完整数据集。此举旨在平衡

Meta 推出革命性 AI 视频工具,让广告创意焕然一新

感谢科技媒体 The Verge 于 10 月 8 日发布博文,报道称 Meta 公司在 Advertising Week 活动中,推出了 Image Animation 和 Video Expansion 两款 AI 工具。Image Animation根据 Meta 公司分享的最新动图,用户可以选择一张静态照片,无需在 Instagram Reels 上使用任何现有的视频素材,就能生成创意视频。早期广告客户的反馈积极,图像动画帮助他们克服了资源有限的问题,并为广告创意提供了更长的使用寿命。Video Expan

消息称 Kimi AI 助手内测深度推理功能,月之暗面有团队国庆加班 7 天 3 倍工资

据“大厂青年”公众号 10 月 8 日爆料,国产 AI 大模型 Kimi 的开发团队 —— 北京月之暗面科技有限公司有团队国庆加班七天,3 倍工资,一周就顶 1 个月。爆料称,月之暗面准备上线一个“很牛的功能”,跟深度思考有关。大概下一个版本里,会在搜索入口下方搞一个“深入推理”的开关,能回答简单搜索无法解决的问题,甚至可以自我反思,所以国庆期间一直疯狂赶进度。AI 独角兽公司月之暗面于 2023 年 3 月创立,于 2023 年 10 月推出全球首个支持输入 20 万汉字的智能助手产品 Kimi。创始团队核心成员

字节跳动发布 GR-2 机器人 AI 大模型:任务平均完成率 97.7%,模拟人类学习处理复杂任务

字节跳动研究团队最新推出了第二代机器人大模型 GR-2(Generative Robot2.0),其亮点在于创新构建“机器人婴儿期”学习阶段,模仿人类成长学习复杂任务,具备卓越的泛化能力和多任务通用性。 GR-2 模型和其它很多 AI 模型一样,包括预训练和微调两个过程。在预训练阶段,GR-2“观看”了多达 3800 万个来自各类公开数据集的互联网视频以及 500 亿个 tokens,涵盖了家庭、户外、办公室等多种日常场景,让 GR-2 具备在后续策略学习中跨越广泛机器人任务和环境的泛化能力。在微调阶段,团队使用机

AI 教父、诺贝尔奖得主辛顿:我为我的学生解雇 OpenAI CEO 感到骄傲

刚获得 2024 年度诺贝尔物理学奖、有“AI 教父”之称的加拿大多伦多大学教授杰弗里・辛顿(Geoffrey Hinton)在 10 月 9 日接受直播群访时表示,“我有很多非常聪明的学生,比我聪明得多,他们做了许多实事,事业伟大。我特别自豪的是,我的一个学生开除(fire)了萨姆・阿尔特曼。”辛顿提及,这名学生正是 OpenAI 的前首席科学家 Ilya Sutskever。Ilya Sutskever 是 OpenAI 的联合创始人,也是 2023 年底 OpenAI 高层“宫斗”大戏中的主角之一,而萨姆・阿

2024 最全合集!13个AI视频产品评测&实战效果!

前言 - AI 视频闭源产品近半年发展

Sora 之后,DiT 架构成为视频生成产品的主流技术。这大半年里,横空出世的 Luma AI、Kling 成为视频生成领域最大黑马,而老牌选手 Runway 也推出了实力强劲的 Gen3 模型。AI 视频生成在画面表现力、语义理解、清晰度、可控性方面有了大幅提升,同时多家产品在音画同步、笔刷等工具上做了更新,提升了产品可控性。

这篇文章会带大家了解 AI 视频产品的最新能力,不同产品的优势,以及展示各个产品的实测效果。

这个系列预计分为闭源、开源两篇。以下是本文目录:一、先

OpenAI 预计 2029 年才能实现盈利,2026 年可能还要亏 140 亿美元

北京时间今天凌晨,据 The Information 报道,根据 OpenAI 公司的预测,直到 2029 年,公司才能实现盈利,届时公司收入将达到 1000 亿美元(AI在线备注:当前约 7063.46 亿元人民币)。根据 The Information 对 OpenAI 财务文件中数据的分析,在达到这一节点之前,到 2026 年的亏损可能会高达 140 亿美元(当前约 988.88 亿元人民币),几乎是今年预期亏损的三倍。这一估算尚不包含股票薪酬 —— 这是 OpenAI 最大的开支之一,但它并非以现金的形式支

提效+赚钱两不误!普通人如何抓住AI红利?

最近,越来越多的朋友问我:“ AI 到底怎么用来搞钱?它真能帮忙提高效率吗?”其实,AI 不仅在各大科技领域崭露头角,也早已悄然融入我们的日常生活和工作中。无论是帮助我们提升工作效率,还是创造出全新的赚钱方式,AI 正在以我们未曾预料的方式改变着世界。今天,我就想和大家分享一些我自己与 AI 相处的经历,以及它带给我的思考和启发...

一、AI 提效:工作和生活中的“隐形帮手”

老实说,AI 带来的变化没那么“高大上”,它更像是一个日常的“隐形帮手”。很多时候,它让你觉得“哎,这事简单多了”。尤其是在工作中,AI

NotebookLM新功能引发网络疯传 ,AI大神、Altman大赞,一手实测来了

AI好好用报道编辑:sia之前还是一个小透明,现在立马变成下一个 ChatGPT。它是谷歌目前最成功的 AIGC 产品。很多人喜欢在它前面再加一个形容词,「像病毒一样( a viral AI product)」。前特斯拉自动驾驶负责人、前 OpenAI 科学家 Andrej Karpathy 毫不掩饰对它的喜爱。他甚至想到了 ChatGPT,暗示产品新功能可能具有与 ChatGPT 类似的革命潜质。就连 OpenAI CEO Altman 也认为,它「很酷」。一直活跃在 AIGC 体验最前沿的宾大沃顿商学院副教授

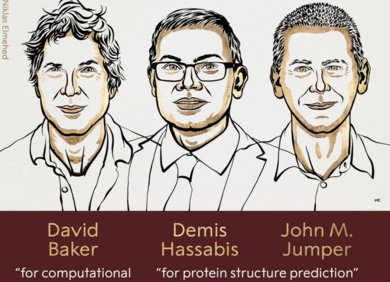

AI再夺诺奖!2024诺贝尔化学奖授予哈萨比斯等人

昨天,哈萨比斯还在祝福Hinton。今天,他自己也拿了诺奖。北京时间 10 月 9 日下午,瑞典皇家科学院宣布将 2024 年诺贝尔化学奖授予华盛顿大学的David Baker以及谷歌DeepMind 的Demis Hassabis 与John M. Jumper,以表彰他们在「计算蛋白质设计」和「蛋白质结构预测」方面的贡献。众所周知,这三位是AI蛋白质研究领域的知名人物。近年来,AI预测蛋白质结构成为了生物以及AI领域的重磅话题。这个领域有两大知名开源算法,一个是 DeepMind 的 AlphaFold2,另一

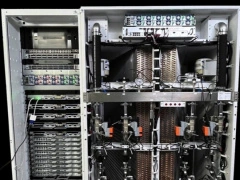

微软“炫耀”新装备:内置英伟达最新 GB200 AI 芯片的服务器

微软 Azure 官方 X 账号昨晚发文“炫耀”了自家的新装备:公司已经拿到了搭载英伟达 GB200 超级芯片的 AI 服务器,成为全球云服务供应商中首个用上 Blackwell 体系的公司。今年 3 月,据AI在线报道,英伟达在 GTC 2024 开发者大会上发布了旗下最强 AI 加速卡 GB200,该卡采用新一代 AI 图形处理器架构 Blackwell,采用台积电的 4 纳米(4NP)工艺蚀刻而成。Blackwell 的 AI 性能可达 20 petaflops,而 H100 仅为 4 petaflops。英

GR-2登场!ByteDance Research提出机器人大模型,具备世界建模和强大泛化能力

最近,ByteDance Research 的第二代机器人大模型 —— GR-2,终于放出了官宣视频和技术报告。GR-2 以其卓越的泛化能力和多任务通用性,预示着机器人大模型技术将爆发出巨大潜力和无限可能。GR-2 官方项目页面: GR-2:百炼出真金和许多大模型一样,GR-2 的训练包括预训练和微调两个过程。如果把机器人和人做比较,预训练过程就好像是人类的 “婴儿期”。而 GR-2 的婴儿期与其他机器人截然不同。在预训练的过程中,GR-2 在互联网的海洋中遨游。它在 3800 万个互联网视频片段上进行生成式训练,

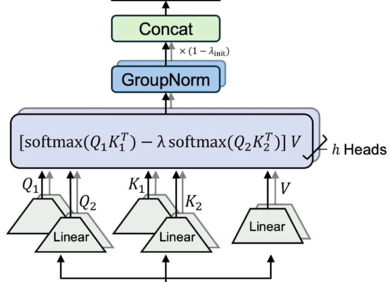

这篇论文非常火!差分Transformer竟能消除注意力噪声,犹如降噪耳机

Transformer 的强大实力已经在诸多大型语言模型(LLM)上得到了证明,但该架构远非完美,也有很多研究者致力于改进这一架构,比如AI在线曾报道过的 Reformer 和 Infini-Transformer。今天我们又将介绍另一种新型 Transformer 架构:Differential Transformer(差分 Transformer,简称 Diff Transformer)。该架构来自微软研究院和清华大学,有四位共一作者:Tianzhu Ye、Li Dong、Yuqing Xia、Yutao Su

两位AI先驱斩获诺奖,GPT-4o表示疑惑,同行大佬:物理学与AI的桥梁已架起

昨天,两位机器学习先驱 John J. Hopfield 和 Geoffrey E. Hinton 获得 2024 诺贝尔物理学奖的消息引爆了整个 AI 领域,让很多人直呼「物理学不存在了」。就连 AI(GPT-4o)都不敢相信今年的物理诺奖会花落机器学习和人工神经网络领域,认为这些领域通常不属于物理学范畴。诺贝尔奖官方推特(X)也发起了一项问卷调查,「你知道机器学习模型是基于物理等式吗?」从结果来看,不知道的人占比更高。但无论如何,两位泰斗级人物的获奖成为了 AI 圈的又一盛事。各路大佬纷纷为他们送上了祝贺,包括

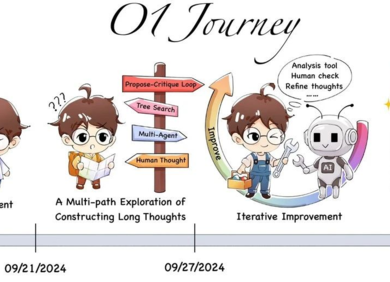

上交大发布首个OpenAI o1复现项目进展报告,满满的经验洞察

AIxiv专栏是AI在线发布学术、技术内容的栏目。过去数年,AI在线AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:[email protected];[email protected]团队介绍:本项目的核心开发团队主要由上海交通大学 GAIR 研究组的本科三年级、四年级学生以及直博一年级研究生组成。项目得到了来自 NYU 等一线大型语言模型领域顶尖研究科学家的指导。详细

继日本东京后,OpenAI 宣布在新加坡组建第二个亚洲办事处

感谢美国人工智能公司 OpenAI 周三宣布,计划今年晚些时候在新加坡开设办事处,并已开始在该国组建团队。该公司表示,新加坡将成为公司为亚太地区客户和合作伙伴提供支持的枢纽,其团队将帮助加强与当地和区域政府、企业和机构的关系。OpenAI 公司在声明中表示,新加坡人是 ChatGPT 人均用户最多的国家之一。据AI在线此前报道,OpenAI 今年 4 月宣布在亚洲的首个办事处落户日本东京,将业务扩展到亚洲。OpenAI 表示将致力于与当地政府、企业和研究机构合作,开发安全的人工智能工具,满足当地的独特需求。

AI 架构 Transformer 再进化:谷歌新方法突破长文本处理,注意力模块内存需求可降至 1/47

科技媒体 marktechpost 昨日(10 月 8 日)发布博文,报道称谷歌公司推出了选择性注意力(Selective Attention)方法,可以提高 Transformer 架构模型的性能。Transformer 架构简介Transformer 是一种革命性的神经网络架构,由谷歌在 2017 年提出,主要用于处理序列数据,特别是在自然语言处理(NLP)领域。Transformer 的核心是自注意力机制,允许模型在处理输入序列时捕捉词与词之间的关系,让模型能够关注输入序列中的所有部分,而不仅仅是局部信息。T

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉