引言

DeepSeek 作为一款优秀的语言模型,结合 Ollama 和 Cherry Studio 可以轻松实现本地部署。本文将深入浅出地介绍如何使用 Ollama 与 Cherry Studio 本地部署 DeepSeek。

Oallam简介

Ollama 是一个简单易用的工具,它允许用户在本地快速部署和运行各种语言模型。通过 Ollama,你可以方便地管理模型的下载、启动和使用,无需复杂的配置。

Cherry Studio

Cherry Studio 是一个集成开发环境(IDE),专门为人工智能开发设计。它提供了直观的界面和丰富的功能,帮助开发者更高效地与语言模型进行交互和开发。

整合步骤

1. 安装Oallam

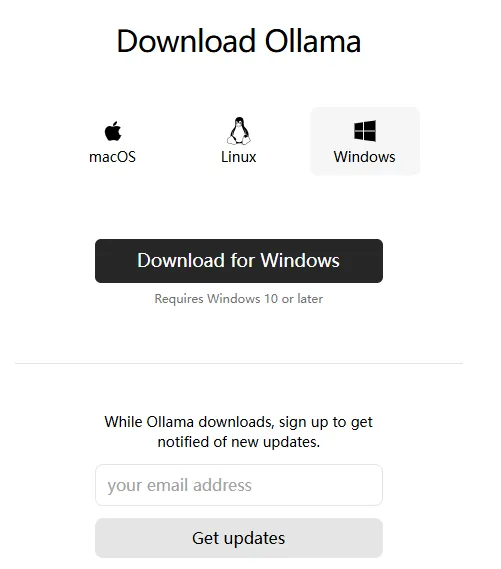

首先,需要在本地安装Oallam。根据操作系统选择合适的安装包进行下载和安装。安装完成后,可以通过命令行启动Oallam服务,并下载所需的大模型。^[6]^

- 下载并安装Oallam 直接访问官网下载

图片

图片

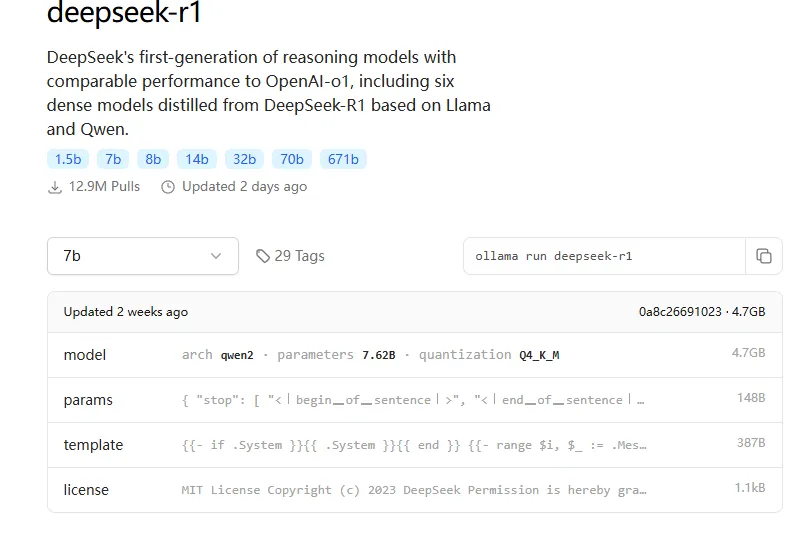

- 下载大模型 进入模型仓库(https://ollama.com/library)根据自己电脑配置,选择合适的模型下载并运行

ollama run deepseek-r1:7b

图片

图片

- 启动Oallam服务 如果是执行命令ollama pull * 下载模型,需要手动启动服务

ollama serve

也可以直接进入到Ollama的安装路径(C:\Users\用户\AppData\Local\Programs\Ollama) 执行ollama app.exe后,任务栏右下角有羊驼的标识,表示启动成功

2. 安装Cherry Studio

直接下载客户端(https://cherry-ai.com/download)

图片

图片

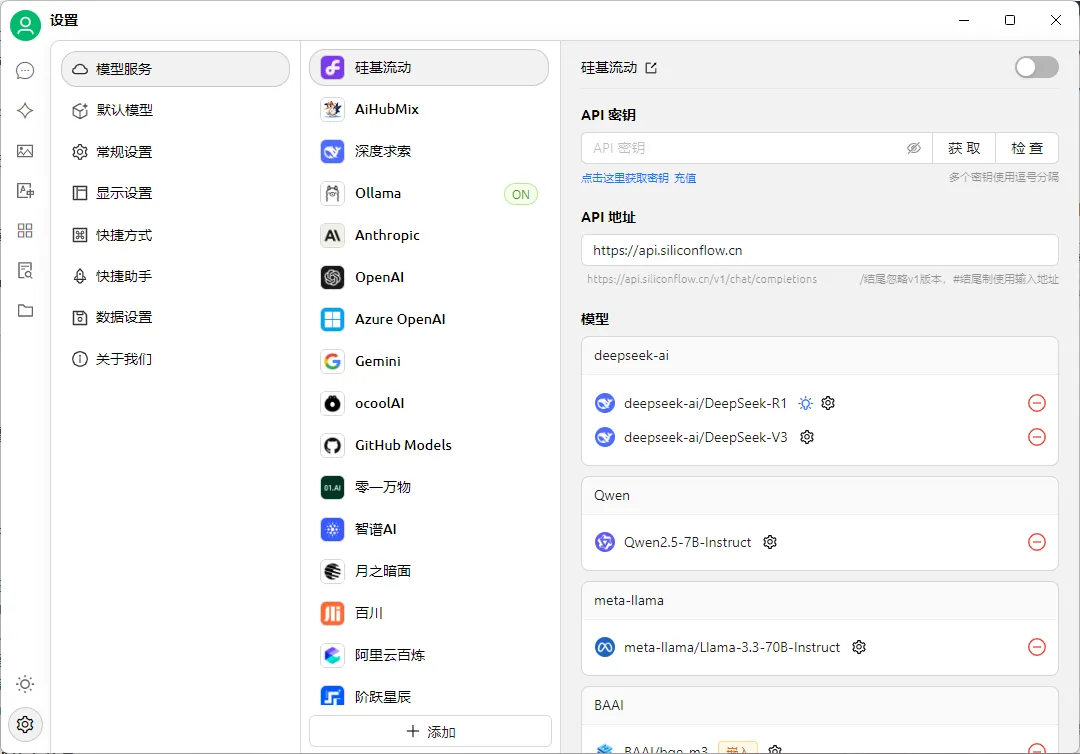

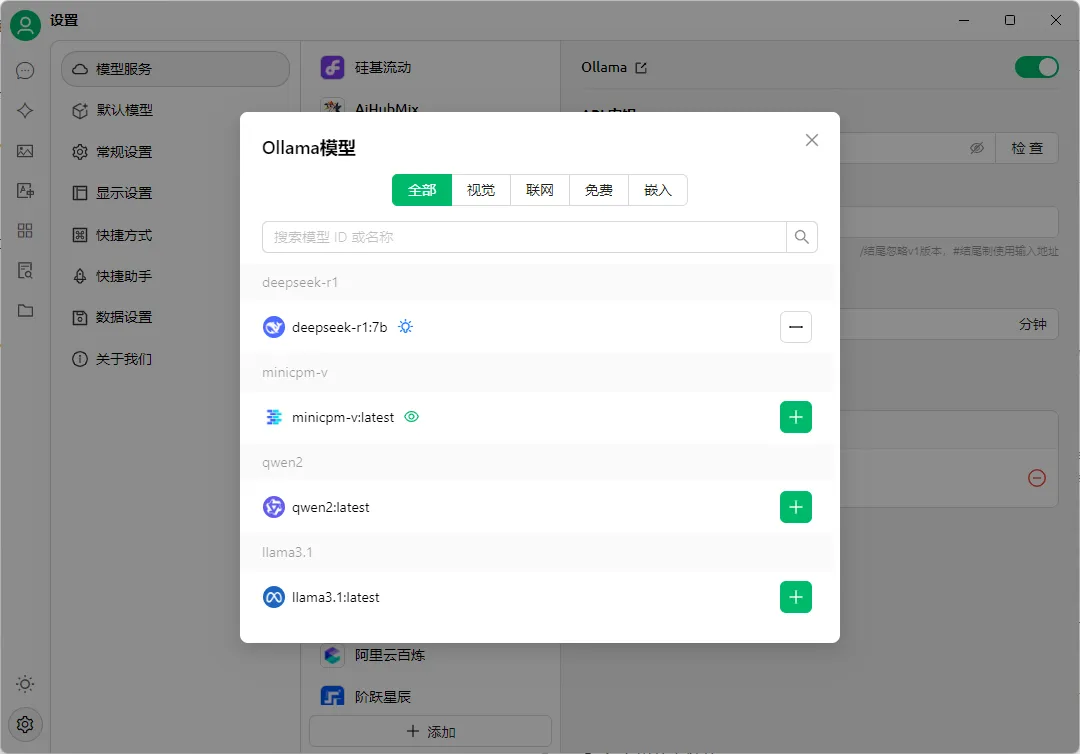

3. 配置Cherry以使用Oallam模型

- 点击右下角设置

图片

图片

- 选择Ollama

a.右上角开关打开

b.点击最下面的管理,并选择在Ollama中下载好的模型

图片

图片

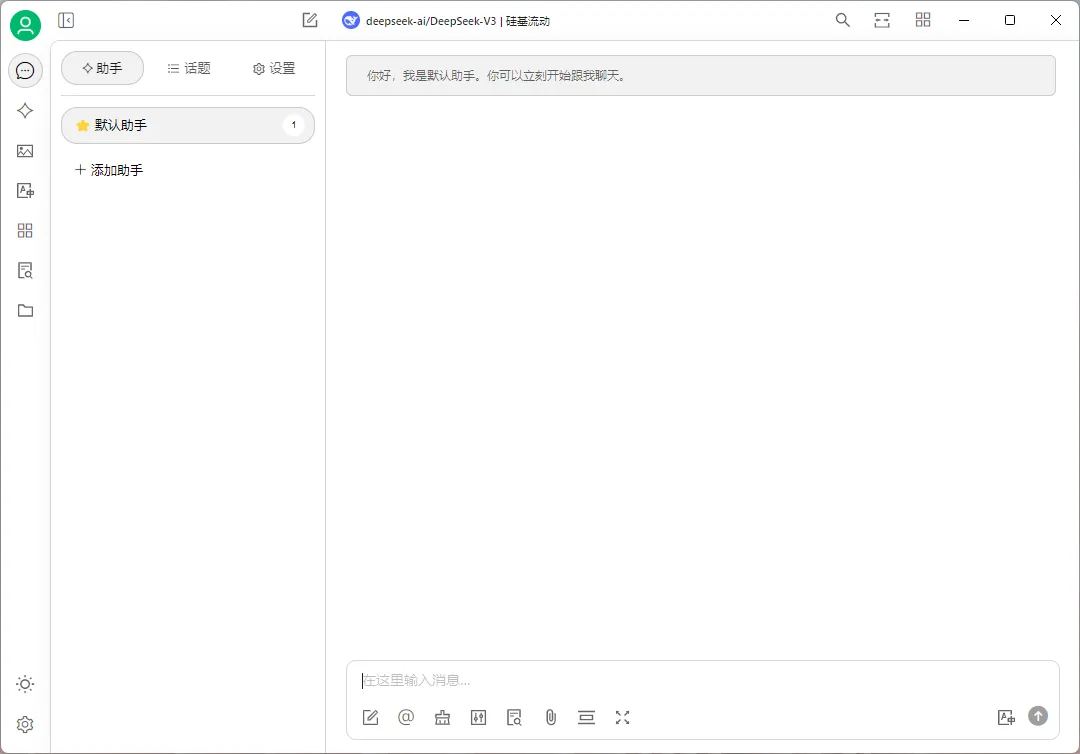

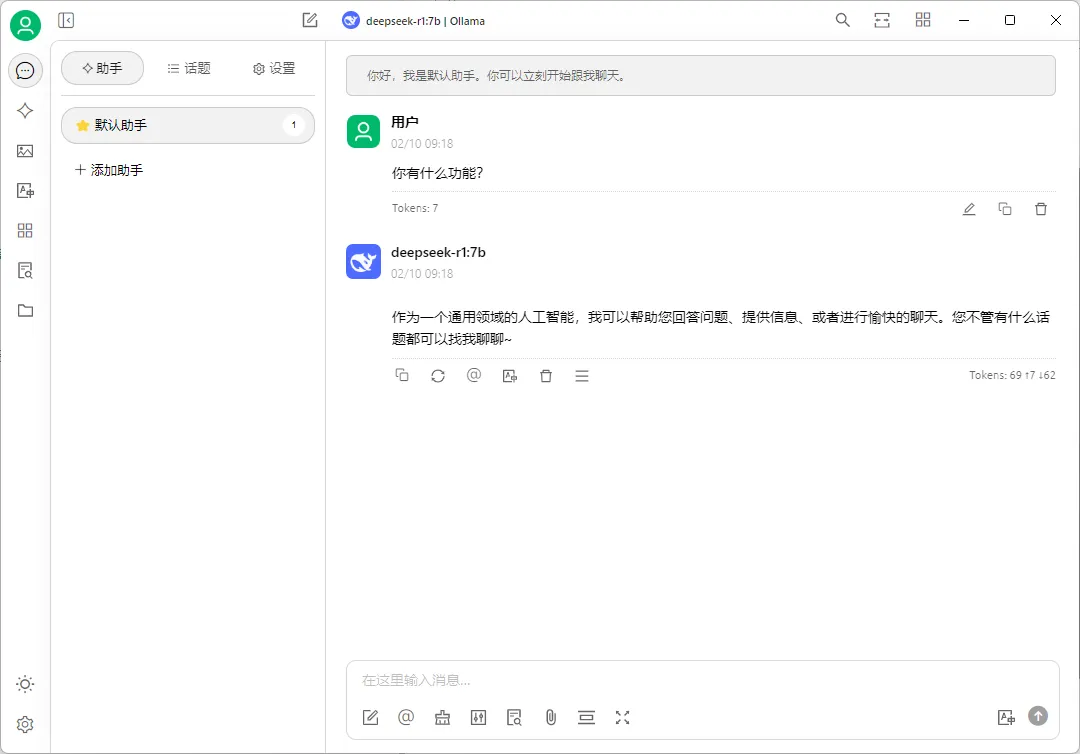

c.回到助手页面,点击最上面的模型名称切换模型服务

d.聊天

图片

图片

4. 基于API的调用

通过API调用可以实现前后端的高效交互,使得基于DeepSeek模型的应用开发更加灵活。API调用的具体实现如下:

- API端点:http://localhost:11434/v1/chat/completions

- 请求头:

a.Content-Type: application/json

- 请求体:

model: 指定使用的模型,例如deepseek-r1:7b

messages: 包含对话消息,格式为数组,每个元素包含role(用户或助手)和content(消息内容)

stream: 是否启用流式响应,true表示启用

{

"model": "deepseek-r1:7b",

"messages": [

{

"role": "user",

"content": "介绍一下人工智能"

}

],

"stream": true

}通过上述API配置,前端可以发送请求到后端,后端再通过Ollama调用DeepSeek模型进行处理,并将结果返回给前端。这种方式不仅简化了开发流程,还提高了系统的可扩展性和维护性。开发者可以根据实际需求调整API参数,实现更多功能,方便直接在前后端通过API的形式调用

结论

基于Ollama可以与各种客户端实现各种模型的使用,比如LangChain、Chatbox...,如果需要网页版本的支持,可以参考之前的文章,使用Ollama+LobeChat实现。