AK再次看衰RL本身,当然指的是长期来看

刚刚Prime Intellect公司开源了一个叫Environments Hub的平台,简单来说Environments Hub是一个开源的的强化学习环境(RL environments)平台,强化学习环境被认为是下一波人工智能进步的关键瓶颈,但大型实验室正在将其锁定

环境是Agent学习的地方,它们定义了世界、规则以及状态 → 动作 → 奖励的反馈循环。从编程/数学任务到游戏和多轮对话评估,一切都可以被视为环境。没有它们,强化学习就只是数学,没有任何交互可言

详细内容看这里:

https://www.primeintellect.ai/blog/environments

AK非常看好这个项目,以下是AK的观点:

在预训练(pretraining)时代,最重要的是互联网文本。你主要需要一个大规模、多样化、高质量的互联网文档集合来供模型学习

在监督微调(supervised finetuning)时代,关键则变成了对话。人们会雇佣合同工来为问题创建答案,有点像你在 Stack Overflow / Quora 等网站上看到的那样,但更专注于大型语言模型(LLM)的应用场景

以上两者都不会消失(在AK看来),但在当下的强化学习时代,核心要素变成了环境。与前两者不同,环境给了大型语言模型一个真正进行交互的机会——采取行动、观察结果等等。这意味着你有望做到比统计性的专家模仿好得多。并且,环境既可以用于模型训练,也可以用于评估。但和以前一样,现在的核心问题是需要一个大规模、多样化、高质量的环境集合,作为供大型语言模型练习的习题

在某些方面,这让AK想起了 OpenAI 的第一个项目(Gym),它正是一个希望在相同框架下构建大量环境集合的框架,但这远在大型语言模型出现之前。所以当时的环境都是一些简单的学术控制任务,比如车杆平衡、ATARI 游戏等

环境具有这样的特性:一旦框架的骨架搭建完成,原则上社区和行业就可以在许多不同领域并行推进,这非常令人兴奋

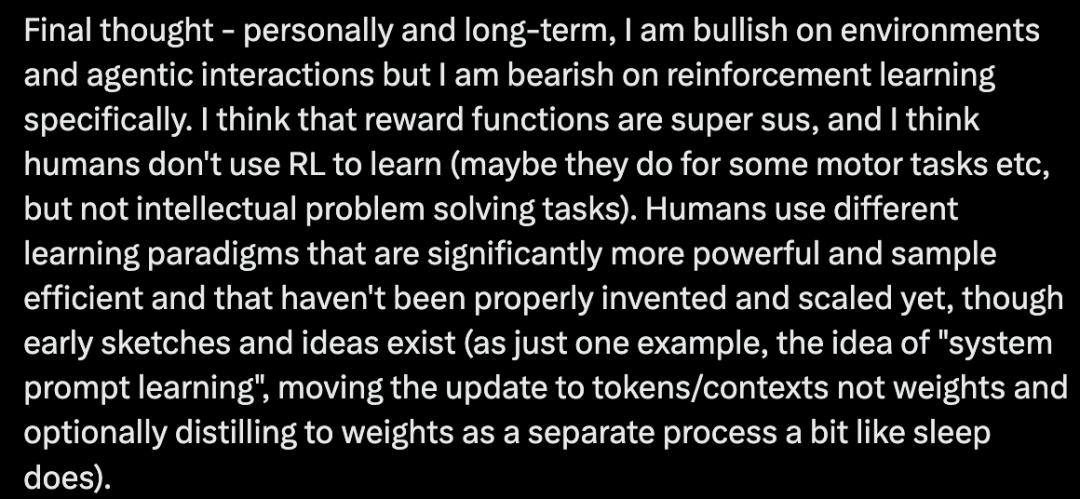

最后的想法——就个人和长期来看,AK十分看好环境和智能体交互(agentic interactions),但特别不看好强化学习本身。奖励函数非常可疑,而且AK认为人类学习时并不使用强化学习(也许在某些运动任务上会用,但在解决智力问题时不会)。人类使用的是不同学习范式,这些范式在能力和样本效率上要强大得多,但它们尚未被(在AI领域)真正地发明出来并规模化。尽管已经存在一些早期的草图和想法

举一个例子,系统提示词学习(system prompt learning)这个概念,它将更新从权重转移到词元/上下文(tokens/contexts),然后可以选择性地通过一个独立的、有点像睡眠的过程,将学习成果蒸馏到权重中