模型压缩

模型压缩技术揭秘:量化、剪枝、蒸馏三大法宝

核心内容1. 模型量化的原理与方法:降低参数精度,减少存储与计算成本2. 模型剪枝的技术分类:结构化与非结构化剪枝的优缺点对比3.

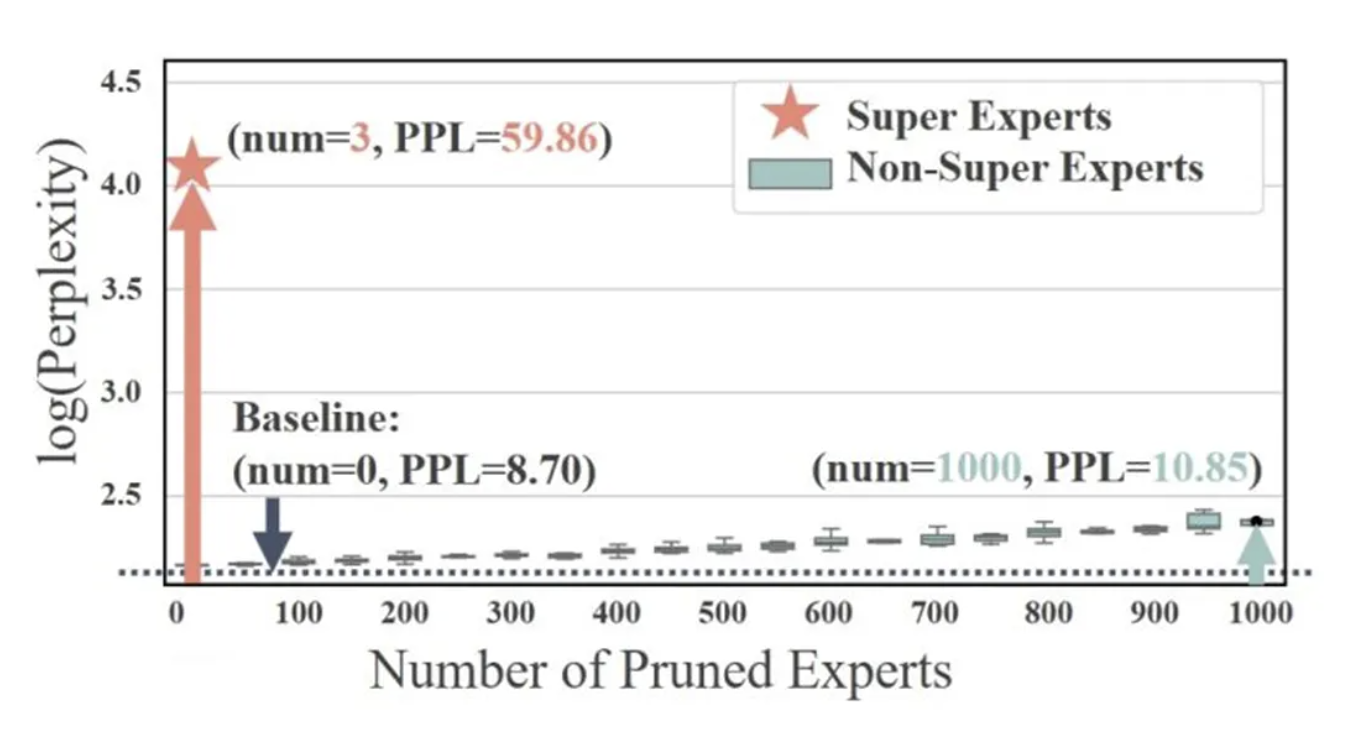

Attention Sink产生的起点?清华&美团首次揭秘MoE LLM中的超级专家机制

稀疏激活的混合专家模型(MoE)通过动态路由和稀疏激活机制,极大提升了大语言模型(LLM)的学习能力,展现出显著的潜力。 基于这一架构,涌现出了如 DeepSeek、Qwen 等先进的 MoE LLM。 然而,随着模型参数的迅速膨胀,如何高效部署和推理成了新的挑战。

终于把深度学习中的模型压缩搞懂了!

今天给大家分享几种常见的模型压缩技术。 在深度学习中,模型压缩是减少模型大小、降低计算复杂度,同时尽可能保持模型性能的一类技术。 它在移动端、嵌入式设备和边缘计算等资源受限的环境中尤其重要。

提升人工智能性能的三种关键的LLM压缩策略

译者 | 布加迪审校 | 重楼在当今快节奏的数字环境中,依赖人工智能的企业面临着新的挑战:运行人工智能模型的延迟、内存使用和计算能力成本。 随着人工智能快速发展,幕后推动这些创新的模型变得越来越复杂、资源密集。 虽然这些大模型在处理各种任务中取得了出色的性能,但它们通常伴随着很高的计算和内存需求。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉