Memory3

鄂维南院士领衔新作:大模型不止有RAG、参数存储,还有第3种记忆

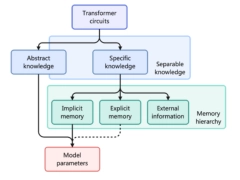

2.4B 的 Memory3比更大的 LLM 和 RAG 模型获得了更好的性能。近年来,大型语言模型 (LLM) 因其非凡的性能而获得了前所未有的关注。然而, LLM 的训练和推理成本高昂,人们一直在尝试通过各种优化方法来降低成本。本文来自上海算法创新研究院、北京大学等机构的研究者受人类大脑记忆层次结构的启发,他们通过为 LLM 配备显式记忆(一种比模型参数和 RAG 更便宜的记忆格式)来降低这一成本。从概念上讲,由于其大部分知识都外化为显式记忆,因而 LLM 可以享受更少的参数大小、训练成本和推理成本。论文地址:

院士领衔推出大模型的第 3 种记忆:比参数存储和 RAG 都便宜,2.4B 模型越级打 13B

给大模型加上第三种记忆格式,把宝贵的参数从死记硬背知识中解放出来!中科院院士鄂维南领衔,上海算法创新研究院等团队推出 Memory3,比在参数中存储知识以及 RAG 成本都更低,同时保持比 RAG 更高的解码速度。在实验中,仅有 2.4B 参数的 Memory3 模型不仅打败了许多 7B-13B 的模型,在专业领域任务如医学上的表现也超过了传统的 RAG 方法,同时推理速度更快,“幻觉”问题也更少。目前相关论文已上传到 arXiv,并引起学术界关注。知识按使用频率分类这一方法受人脑记忆原理启发,独立于存储在模型参数

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉