幻觉评估

使用人工智能幻觉评估图像真实感

译者 | 朱先忠审校 | 重楼引言最近,俄罗斯的一项新研究提出了通过一种非常规方法来检测不切实际的人工智能生成的图像。 这种方法的主要思想是:不是通过提高大型视觉语言模型(LVLM)的准确性,而是通过有意利用它们产生幻觉的倾向。 这种新方法使用LVLM提取有关图像的多个“原子事实”,然后应用自然语言推理(NLI)系统地衡量这些陈述之间的矛盾,从而有效地将模型的缺陷转化为检测违背常识的图像的诊断工具。

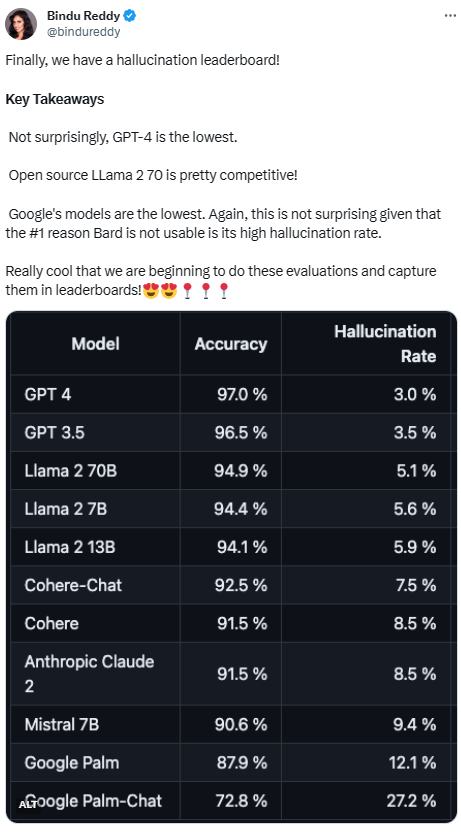

大模型幻觉率排行:GPT-4 3%最低,谷歌Palm竟然高达27.2%

排行榜一出,高下立见。人工智能发展进步神速,但问题频出。OpenAI 新出的 GPT 视觉 API 前脚让人感叹效果极好,后脚又因幻觉问题令人不禁吐槽。幻觉一直是大模型的致命缺陷。由于数据集庞杂,其中难免会有过时、错误的信息,导致输出质量面临着严峻的考验。过多重复的信息还会使大模型形成偏见,这也是幻觉的一种。但是幻觉并非无解命题。开发过程中对数据集慎重使用、严格过滤,构建高质量数据集,以及优化模型结构、训练方式都能在一定程度上缓解幻觉问题。流行的大模型有那么多,它们对于幻觉的缓解效果如何?这里有个排行榜明确地对比了

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉