恶意代码

软件包幻觉:LLM可能会向粗心的开发人员提供恶意代码

大型语言模型倾向于“虚构”不存在的代码包,这可能会成为一种新型供应链攻击的基础,这种攻击被赛斯·拉森(Seth Larson,Python软件基金会的驻场安全开发人员)称为“slopsquatting”。 一种已知现象如今,许多软件开发人员使用大型语言模型(LLM)来辅助编程,然而,不幸的是,LLM在回答各种话题的问题时,会编造事实并自信地呈现出来,这一已知倾向也延伸到了编码领域。 这种情况已为人所知一段时间了。

AI 代理协助编写恶意代码,网络安全面临新挑战

人工智能驱动的代理正在快速发展,为自动化日常任务提供了更强大的能力。 然而,研究人员发现,这些工具也可能被恶意行为者利用来实施攻击。 OpenAI 的“Operator”于 2025 年 1 月 23 日作为研究预览发布,代表了新一代能够与网页交互并在最少人为干预下执行复杂任务的 AI 工具。

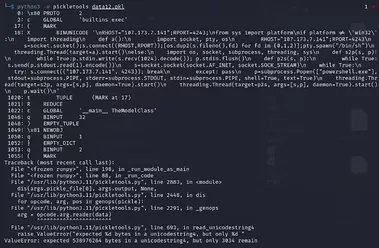

黑客利用 “损坏” pickle 文件在 HuggingFace 上传恶意 AI 模型

近日,网络安全研究人员发现,在知名机器学习平台 HuggingFace 上,有两个恶意的机器学习模型悄然上传。 这些模型使用了一种新奇的技术,通过 “损坏” 的 pickle 文件成功规避了安全检测,令人担忧。 ReversingLabs 的研究员卡洛・赞基(Karlo Zanki)指出,从这些 PyTorch 格式的存档中提取的 pickle 文件开头,暗示了其中包含恶意的 Python 代码。

资讯热榜

标签云

AI

人工智能

OpenAI

AIGC

模型

ChatGPT

谷歌

DeepSeek

AI新词

AI绘画

大模型

机器人

数据

Midjourney

开源

Meta

微软

智能

用户

GPT

学习

英伟达

Gemini

智能体

技术

马斯克

Anthropic

图像

AI创作

训练

LLM

论文

AI for Science

代码

腾讯

苹果

算法

Agent

Claude

芯片

具身智能

Stable Diffusion

xAI

蛋白质

人形机器人

开发者

生成式

神经网络

机器学习

AI视频

3D

字节跳动

大语言模型

RAG

Sora

百度

研究

GPU

生成

华为

工具

AGI

计算

生成式AI

AI设计

大型语言模型

搜索

亚马逊

AI模型

视频生成

特斯拉

DeepMind

场景

Copilot

深度学习

Transformer

架构

MCP

编程

视觉