引言

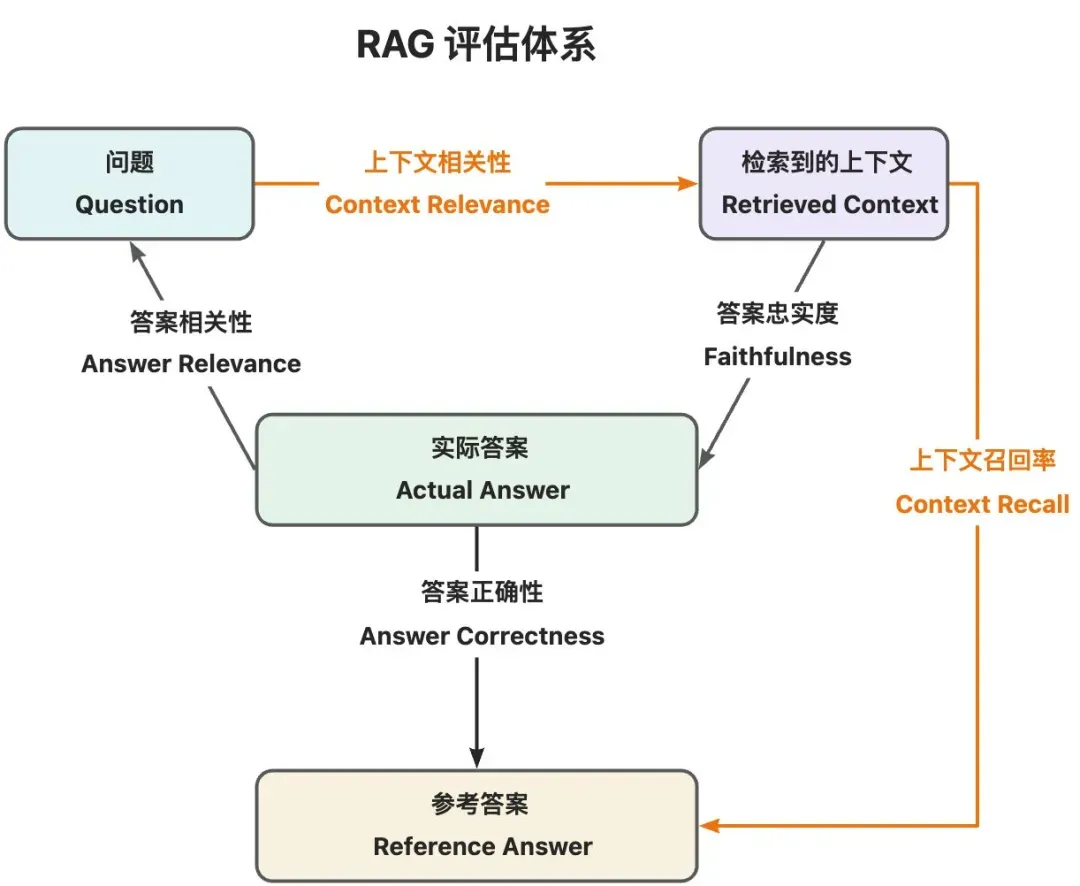

在 RAG系列:一文让你由浅到深搞懂RAG实现 中,我们将 RAG 系统主要分为问题理解、检索召回以及答案生成这三个模块,因此对 RAG 系统的评估也是围绕问题(Question)、检索到的上下文(Retrieved Context)、实际答案(Actual Answer)、参考答案(Reference Answer)这四个维度开展,通过衡量这四个维度之间的相关性来评估 RAG 系统的有效性。

下面我们对每个指标一一展开讲解。

评估指标

上下文召回率(Context Recall)

衡量检索到的上下文是否覆盖参考答案所需的所有关键信息,避免遗漏关键信息。

取值在 0 到 1 之间,数值越高表示检索到的上下文覆盖越全面。

计算公式:上下文召回率 = 上下文覆盖的关键信息数量 / 参考答案中关键信息总数量。

例如,参考答案需要 5 个关键信息,若检索到的上下文覆盖其中 4 个关键信息,则上下文召回率为 0.8。

提升方法:

- 问题优化与扩展:

a.通过 LLM 对原问题进行改写或扩写,生成多个相关问题扩大检索范围;

b .应用 HyDE(假设性文档嵌入)生成假设性答案作为查询向量,提升上下文召回率。

- 分块策略优化:

a.根据文档类型调整分块大小和相邻分块的重叠大小;

b.为每个文本块添加显式标题或背景,提升语义检索准确性;

c.结构化文档,如将 PDF 文件先转为 Markdown 文件再进行分块;

d.使用 LLM 生成主题连贯的文本块,替代传统递归分割,减少上下文断裂问题。

3.检索策略改进:

a.混合检索,结合稠密检索(向量搜索)与稀疏检索(如BM25),通过加权融合(如 60% 稠密 + 40% 稀疏)兼顾语义关联与关键词匹配,提升上下文召回率;

b.动态调整 Top-K 候选文档数量,根据查询复杂度优化检索策略。

上下文相关性(Context Relevance)

衡量检索到的上下文与问题之间的相关性,避免包含无关冗余内容。

取值在 0 到 1 之间,数值越高表示检索到的上下文相关性越高。

计算公式:上下文相关性 = 上下文中与问题相关的片段数量 / 上下文中片段总数量。

例如,检索到的上下文总共有 5 个片段,与问题相关的片段有 4 个,则上下文相关性为 0.8。

提升方法:

- 问题优化与扩展:

a.通过 LLM 对原问题进行改写或扩写,生成多个相关问题,覆盖用户意图的不同表达形式;

b.应用 HyDE(假设性文档嵌入)生成假设性答案作为查询向量,增强问题与上下文的匹配度。

- 分块策略优化:

a.根据文档类型调整分块大小和相邻分块的重叠大小;

b.为每个文本块添加显式标题或背景,提升语义检索准确性;

c.结构化文档,如将 PDF 文件先转为 Markdown 文件再进行分块;

d.使用 LLM 生成主题连贯的文本块,替代传统递归分割,减少上下文断裂问题。

3. Embedding 模型优化:

a.采用更高性能的 Embedding 模型;

b.通过领域知识库微调 Embedding 模型。

4. 检索策略改进:

a.混合检索,结合稠密检索(向量搜索)与稀疏检索(如BM25),通过加权融合(如 60% 稠密 + 40% 稀疏)兼顾语义关联与关键词匹配,提升上下文相关性;

b.检索与重排序结合,先扩大检索范围(如Top 100)实现最大化召回,然后使用重排序模型筛选 Top 5-10,兼顾效率与相关性;

c.引入知识图谱(Knowledge Graph)增强检索,通过实体链接和路径扩展挖掘深层语义关系,解决传统 RAG 对复杂关系推理的不足。

答案忠实度(Faithfulness)

衡量实际答案是否严格基于检索到的上下文,避免幻觉。

取值在 0 到 1 之间,数值越高表示实际答案越严格基于检索到的上下文。

计算公式:答案忠实度 = 上下文能够推断出事实的数量 / 答案拆解出的事实总数量。

例如,实际答案拆解出 5 个事实,若检索到的上下文覆盖其中 4 个事实,则答案忠实度为 0.8。

提升方法:

- 优化检索阶段的精准性,提高上下文召相关性;

- 生成阶段通过 Prompt 设计约束 LLM 严格按上下文生成答案。

答案相关性(Answer Relevance)

衡量实际答案是否直接完整回答用户问题,排除冗余或跑题。

取值在 0 到 1 之间,数值越高表示实际答案更直接完整回答用户问题。

计算公式:答案相关性 = 与实际问题相关的模拟问题数量 / 实际答案推导出的模拟问题总数量。

例如,实际答案推导出 5 个模拟问题,若其中 4 个与实际问题相关,则答案相关性为 0.8。

提升方法:

- 优化检索阶段的精准性与全面性,提高上下文召回率和相关性;

- 生成阶段通过 Prompt 设计约束 LLM 直接完整回答用户问题。

答案正确性(Answer Correctness)

衡量实际答案的准确性,需与参考答案对比。

取值在 0 到 1 之间,数值越高表示实际答案与参考答案匹配度越高,准确性也就越高。

计算公式:答案准确性 = 实际答案覆盖的关键信息数量 / 参考答案中关键信息总数量。

例如,参考答案需要 5 个关键信息,若实际答案覆盖其中 4 个关键信息,则答案正确性为 0.8。

提升方法:

- 优化检索阶段的精准性与全面性,提高上下文召回率和相关性;

- 生成阶段通过 Prompt 设计约束 LLM 直接完整回答用户问题。

评估系统

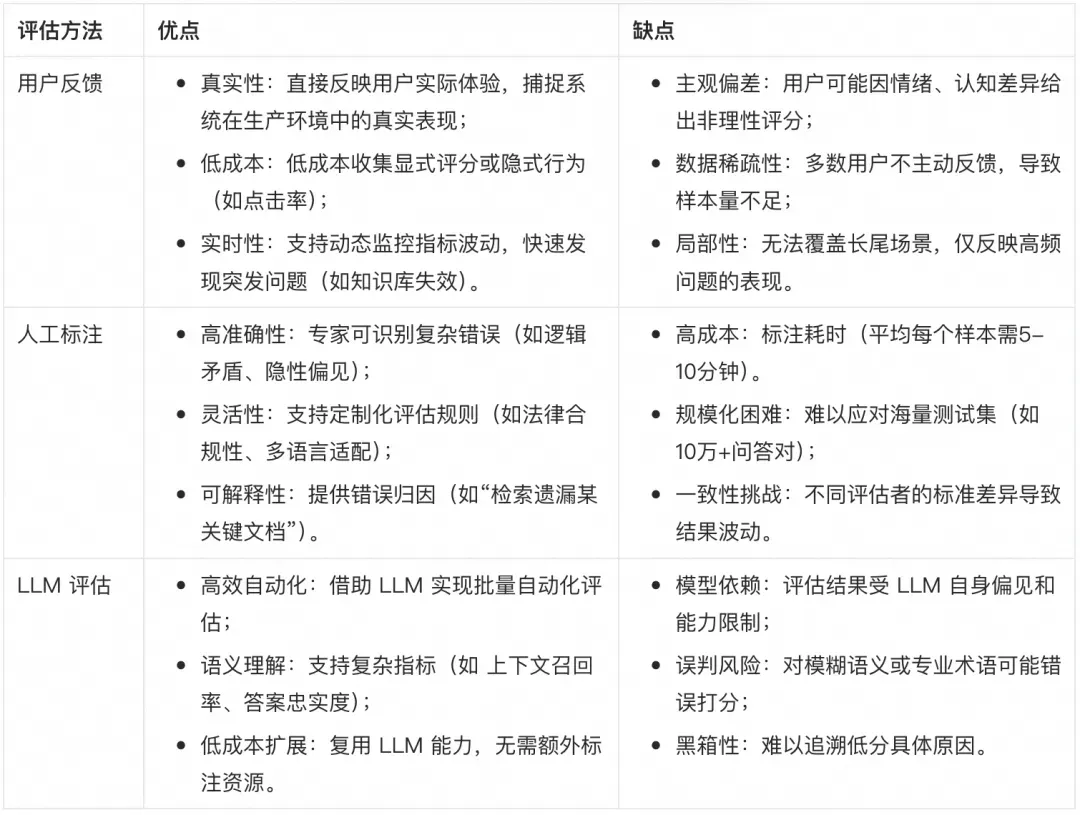

RAG 系统评估方法主要有用户反馈(User Feedback)、人工标注(Human Annotations)、LLM 评估(LLM-as-judge)。

鉴于用户反馈需要生产环境以及人工评估耗时耗力等原因,通过 LLM 来对 RAG 系统进行评估是目前的主流和发展方向。

目前主流的 RAG 评估系统有:RAGAS[1]、Trulens[2]、LangSmith[3]、LlamaIndex[4]等,其核心原理还是使用标注良好的数据集和 LLM 来完成自动化评估,大家可根据自己的需求选用。

- RAGAS:

定位:专注 RAG 系统评估,提供自动化、无参考标签的评估框架,评估指标覆盖全面;

覆盖指标:上下文相关性、上下文召回率、答案忠实度、答案相关性、答案正确性等;

支持开发语言:Python。

- Trulens

定位:提供 RAG Triad 评估模型(检索质量、生成准确性、对齐度),但指标较 RAGAS 粗略,属于 RAGAS 的子集;

覆盖指标:上下文相关性、答案忠实度、答案相关性等;

支持开发语言:Python。

•LangSmith:

定位:LangChain 生态的核心监控与调试工具,覆盖 LLM 应用全生命周期,也可与 RAGAS 联合评估 RAG 系统;

覆盖指标:上下文相关性、答案忠实度、答案相关性、答案正确性等;

支持开发语言:Python、TypeScript。

•LlamaIndex:

定位:一个专注于构建 RAG 应用的框架,提供数据索引、检索与生成的完整流程支持。支持部分指标评估,也可与 RAGAS 联合评估 RAG 系统;

覆盖指标:答案忠实度、答案相关性、答案正确性等;

支持开发语言:Python、TypeScript。

结语

通过本文我们了解了 RAG 系统的评估指标、评估方法以及主流的评估系统,后面我们将基于 LLM-as-judge 自己实现一套自动化评估系统,然后通过该评估系统评估我们在RAG系列:基于 DeepSeek + Chroma + LangChain 开发一个简单 RAG 系统 中搭建好的基础版 RAG 系统,然后以此为基准,学习不同的优化方法以及优化后的基础版 RAG 系统的提升效果。

引用链接

[1]RAGAS:https://docs.ragas.io/en/latest/getstarted/rag_eval/

[2]Trulens:https://www.trulens.org/getting_started/

[3]LangSmith:https://docs.smith.langchain.com/evaluation/tutorials/rag

[4]LlamaIndex:https://www.llamaindex.ai/