1. 一眼概览:

MonSter是一种创新性的双分支立体匹配方法,首次将单目深度估计与双目立体匹配协同优化,在多个主流数据集上取得全面领先的性能。

2. 核心问题:

传统立体匹配在遮挡、纹理缺失、重复结构和远距离区域表现不佳,难以恢复精确深度。该研究核心在于:如何利用单目深度的结构先验弥补双目匹配在病态区域中的信息缺失,同时消除单目深度的尺度漂移误差。

3. 技术亮点:

- 双分支协同架构:构建单目深度和双目匹配两大分支,通过迭代互导实现相互增强;

- 精细像素级校准机制:提出“立体引导对齐(SGA)”和“单目引导优化(MGR)”模块,实现像素级尺度-偏移校正与精细立体细化;

- 领先的泛化能力:在五个主流数据集(SceneFlow、KITTI 2012/2015、Middlebury、ETH3D)全面夺冠,零样本测试中显著优于现有SOTA方法。

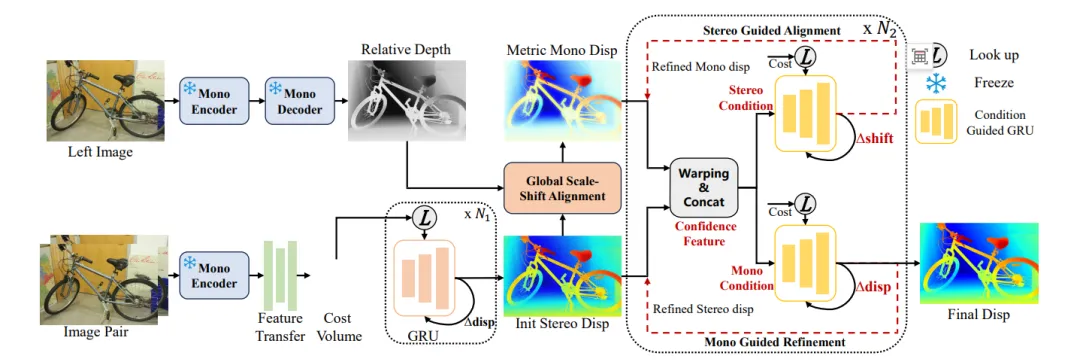

4. 方法框架:

图片

图片

MonSter整体流程如下:

- 单目估计与初始立体匹配:利用DepthAnythingV2获取单目深度,IGEV分支进行初步立体匹配;

- 全局尺度对齐:通过最小二乘优化将单目深度转换为粗对齐的“单目视差”;

- 双向迭代优化:

SGA模块利用高置信度立体结果,校正单目深度的像素级偏移;

MGR模块反过来使用更新后的单目视差优化立体匹配结果;

- 最终输出:经过多轮迭代后的立体分支输出作为最终结果。

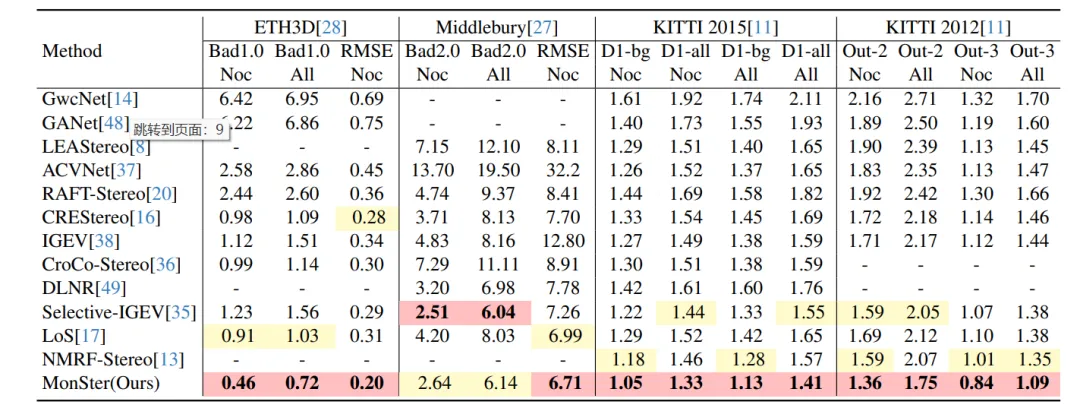

5. 实验结果速览:

图片

图片

MonSter在多个数据集上均达SOTA水准:

• Scene Flow:EPE 降至 0.37(提升15.9%);

• KITTI 2012/2015:D1-all 降至 1.33/1.41,优于Selective-IGEV 和 CREStereo;

• ETH3D:Bad1.0降至0.72,领先IGEV 52%;

• Middlebury:RMSE降至0.20;

• 零样本泛化:训练仅用Scene Flow,在ETH3D上Bad>1px降至2.03,优于所有现有方法。

6. 实用价值与应用:

MonSter具备强泛化与精度优势,特别适用于自动驾驶、机器人导航、增强现实、三维重建等场景,尤其在低纹理、远距离、反光表面等复杂环境中表现卓越,具备部署潜力。

7. 开放问题:

- • MonSter是否可扩展到多视角或光流估计任务中?

- • 面对极端天气或夜间环境时,其单目-双目协同机制是否仍稳定可靠?

- • 如何进一步压缩模型体积,使其适用于移动终端或嵌入式设备?