本文旨在提供一个全面且详细的DeepSeek本地部署指南,帮助大家在自己的设备上成功运行DeepSeek模型。无论你是AI领域的初学者还是经验丰富的开发者,都能通过本文的指导,轻松完成DeepSeek的本地部署。

一、本地部署的适用场景

DeepSeek本地部署适合以下场景:

- 高性能硬件配置:如果你的电脑配置较高,特别是拥有独立显卡和足够的存储空间,那么本地部署将能充分利用这些硬件资源。

- 数据安全需求:对于需要处理敏感数据的用户,本地部署可以避免数据上传至云端,确保数据的安全性和隐私性。

- 高频任务处理:对于需要频繁处理大量或复杂任务的用户,本地部署能提供更高的灵活性和响应速度。

- 成本控制:对于日常使用量大、API调用费用较高的用户,本地部署能显著降低运行成本。

- 个性化需求:本地部署允许用户对模型进行二次开发和定制,满足特定的应用场景和需求。

三、环境准备与依赖安装

1. 硬件要求

- 操作系统:推荐Linux(如Ubuntu 20.04及以上版本)或Windows系统。

- Python版本:需要安装Python 3.8及以上版本。

- GPU支持:需要支持CUDA的NVIDIA GPU,推荐显存16GB及以上。

2.硬件配置

模型 | 显存需求 | 内存需求 | 推荐显卡 |

7B | 10-12GB | 16GB | RTX 3060 |

14B | 20-24GB | 32GB | RTX 3090 |

32B | 40-48GB | 64GB | RTX 4090 |

2. 软件依赖

- CUDA与CUDNN:根据NVIDIA GPU型号和驱动版本,安装合适的CUDA(11.2及以上版本)和CUDNN(8.1及以上版本)。

3. 安装步骤

更新系统(Linux为例)

复制安装必要依赖

复制创建并激活虚拟环境

复制安装PyTorch

根据CUDA版本选择合适的PyTorch安装命令。例如,CUDA 11.2的安装命令如下:

复制四、DeepSeek模型下载与部署

1. 克隆DeepSeek代码库

复制2. 安装项目依赖

复制3. 下载并放置预训练模型

从官方提供的链接下载DeepSeek预训练模型权重,并将其放置在models/目录下。

复制4. 配置环境变量

设置模型路径和GPU设备号等环境变量

复制5. 运行模型

使用以下命令启动DeepSeek模型进行推理或训练。

复制五、简化部署方案:使用Ollama

对于初学者或不希望手动配置环境的用户,可以使用Ollama工具简化DeepSeek的本地部署过程。

1.下载安装Ollama

在本地部署DeepSeek会使用到Ollama,所以,需要现在本地下载安装Ollama。

Ollama官方地址:https://ollama.com

小伙伴们可以根据自己的需要下载MacOS、Linux和Windows版本的Ollama,由于冰河目前使用的是Windows系统,所以,这里我下载的是Windows版本的Ollama。

下载后在本地安装Ollama。

2.下载DeepSeek-R1

(1)定位Models

进入Ollama官网,找到Models。

(2)找到DeepSeek-R1模型

(3)选择对应的模型下载

DeepSeek-R1有很多不同的版本可供下载,例如1.5b、7b、8b、14b、32b、70b或671b,版本越高,模型越大,对于电脑的内存、显卡等资源的配置要求就越高。

这里为了方便安装演示,我先给大家演示如何部署8b的模型。后续带着大家在服务上部署更高版本的模型。

进入DeepSeek-R1模型的详情,选择8b模型,如下所示。

(4)打开电脑终端

以管理员身份打开电脑终端,如下所示。

(5)部署8b模型

首先,如下图所示复制8b模型的代码。

随后,将其粘贴到命令行终端,如下所示。

如果出现下图所示的进度,则说明正在下载模型。

等待一段时间,如果出现success字样,则说明部署成功,如下所示。

部署成功后,我们可以试着在命令行发送一条消息给DeepSeek,这里我发送一个“你好”给DeepSeek。

可以看到,向DeepSeek发送你好后,它也回复了一段内容。

至此,我们就可以和DeepSeek在命令行进行对话了。不过,只是在命令行与DeepSeek对话,那就显得有点不怎么方便了,所以,我们继续部署Chatbox。

3.安装Chatbox

通过部署Chatbox,我们可以使用在网页或者客户端与DeepSeek进行交互。Chatbox的安装步骤如下所示。

(1)下载安装Chatbox

Chatbox官网:https://chatboxai.app/zh

直接进入官网下载客户端,如下所示。

下载完成后,双击进行安装即可。

(2)配置DeepSeek-R1模型

打开Chatbox,选择设置—>Ollama API,如下所示。

选择已经安装好的DeepSeek-R1 8b模型,进行保存。

等待部署完成,就可以在Chatbox页面中与DeepSeek进行对话了。

六、安装Open-WebUI

1.安装Docker

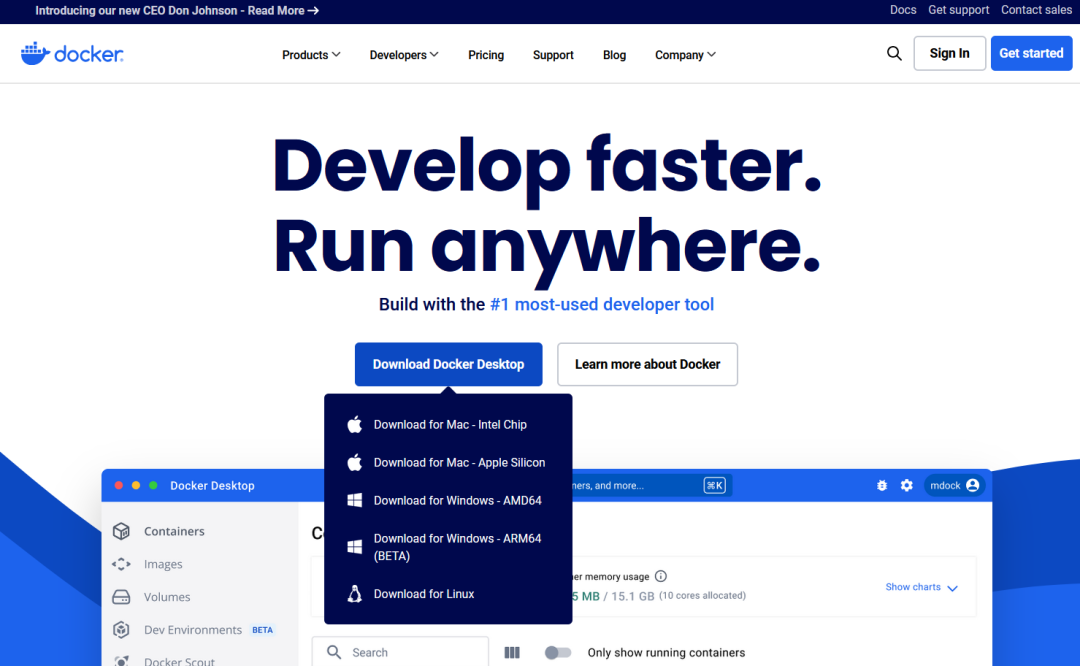

安装Open-WebUI前,我们可以先安装Docker。进入Docker官网:https://www.docker.com,下载Docker。

下载后安装到自己电脑即可。

2.安装open-webui

如果是在Linux系统下,则可以打开命令行,输入以下命令安装 Open-WebUI。

复制安装完成后,打开浏览器,访问 http://localhost:3000,注册一个账号并登录,即可进入open-webui。

在界面左上角选择对应的模型,即可开始对话。

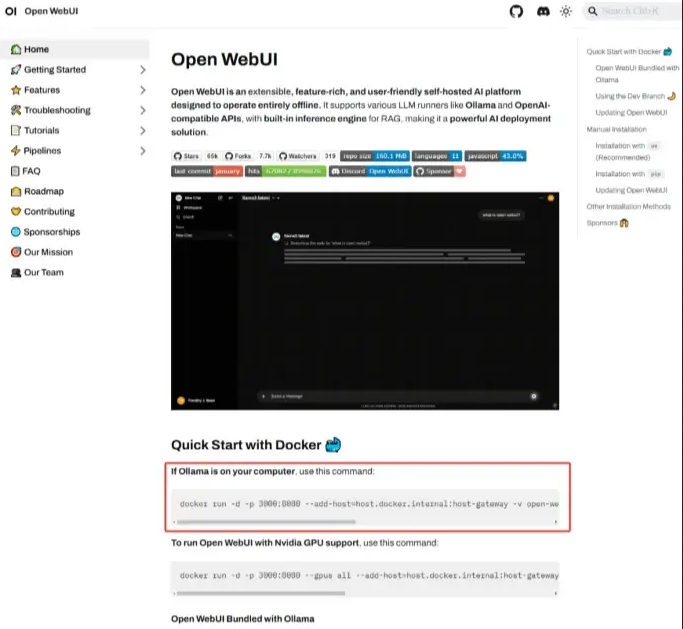

如果是Windows系统,则在浏览器搜索Open-WebUI,进入官网,并复制下图所示的命令。

随后打开Windows命令行,输入复制的命令后等待安装完成。

安装完成后,打开浏览器,访问 http://localhost:3000,注册一个账号并登录,即可进入open-webui。

七、常见问题解决方案

问题现象 | 解决方案 |

显存不足报错 | 使用量化模型或换用更小模型 |

响应速度慢 | 设置环境变量OLLAMA_NUM_THREADS=8 |

生成内容中断 | 输入/continue继续生成 |

中文输出夹杂英文 | 在提问末尾添加「请使用纯中文回答」 |

历史记忆混乱 | 输入/forget清除上下文 |