2025 年已经过半,在 LLM 领域,RAG(检索增强生成)技术一直是备受关注的焦点。近期,RAGFlow 团队发布了 2025 年过半的 RAG 进展报告下面来详细看下。

1、RAG 与智能体的关系

被误读的 "智能体化 RAG"

2025 年 AI 圈最热闹的话题莫过于智能体系统,随之而来的 "智能体无需 RAG" 论调一度引发行业困惑。事实上,这种说法更像是市场噱头 —— 从技术本质看,RAG 与智能体并非对立关系,而是形成了 "智能体赋能 RAG 推理,RAG 支撑智能体记忆" 的共生架构。

需要澄清的是,"智能体化 RAG(Agentic RAG)" 概念的源头可追溯至 RAGFlow 在 2024 年推出的 Agent 功能。其核心并非用智能体取代 RAG,而是通过工作流实现二者的交互协作,从而有效解决意图模糊、长上下文理解等推理方面的难题。

智能体赋能 RAG 的核心机制

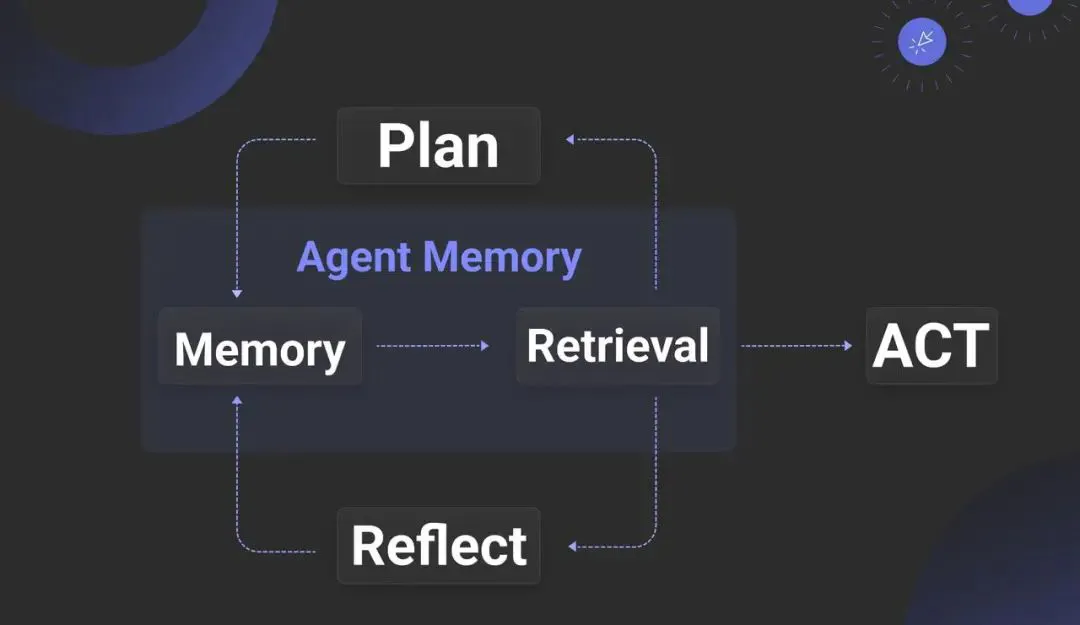

智能体对 RAG 的赋能核心体现在反思驱动与记忆支撑两大机制:

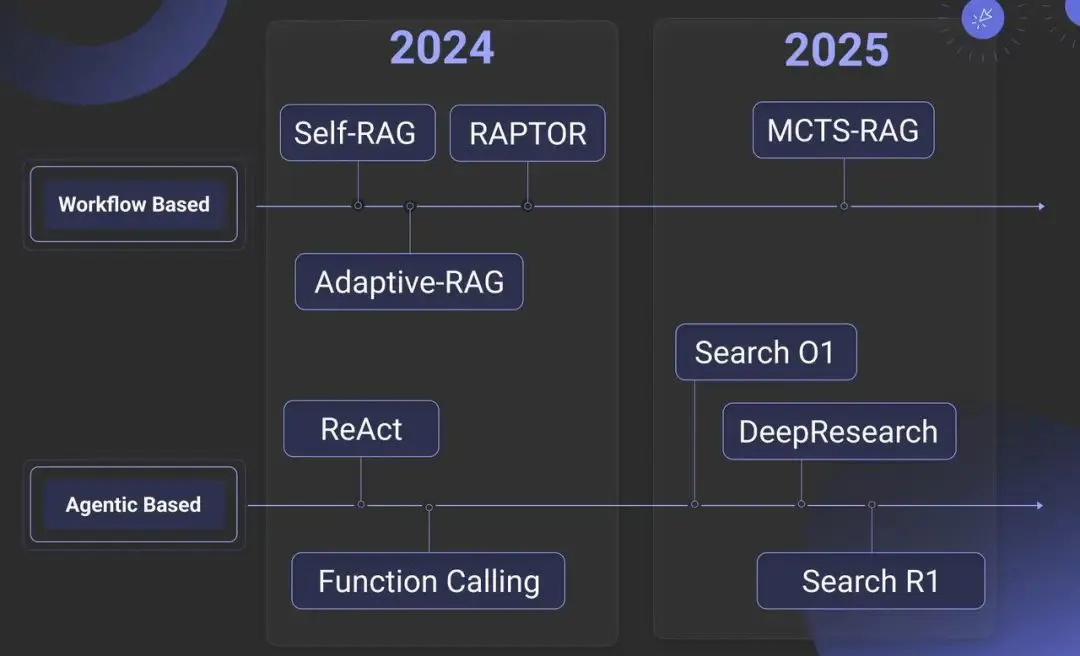

- 反思驱动的双路径进化:基于工作流的方法(如 Self-RAG、RAPTOR)通过预定义规则实现推理循环,适合场景明确的标准化任务;基于Agentic的方法(如 Search O1、Search R1)则依赖 LLM 提示或强化学习自主驱动反思,更适应复杂动态场景。两种路径的共同目标是解决 RAG 在意图模糊、长上下文理解等场景的推理短板。

- 记忆系统的分工协作:RAG 是智能体长期记忆的核心载体,通过索引、遗忘、整合三大功能管理任务元数据与上下文;而智能体的短期记忆则处理会话交互与个性化数据,二者协同形成完整的记忆架构,为智能体的持续运行和高效决策提供了有力支撑。例如,OpenAI 2025 年投资 Supabase 的动作,本质就是为智能体打造更高效的记忆管理工具,而 RAG 在其中承担着非结构化数据处理的关键角色。

2、RAG 的技术挑战与突破瓶颈

长文本推理的解决方案

长文本推理一直是 RAG 技术面临的难点,目前行业内的解决方案主要集中在以下三类:

- 无分块全文档检索:看似简单直接,实则仅适用于少量文档场景。当文档规模扩大,全局上下文理解能力不足会导致相关性急剧下降。

- 分层索引与文档内agentic RAG:通过构建树状索引还原文档结构(章节、小节),结合智能体遍历定位相关片段,实现 "先定位文档,再深挖细节" 的精准检索。

- 重叠分块与多粒度检索:通过文档、章节、段落的多层索引平衡召回率与精度,适合需要跨层级关联信息的场景。

此外,“注意力引擎(Attention Engine)” 技术,如 RetrievalAttention、AlayaDB,尝试通过稀疏注意力来优化长上下文推理。但该技术需要与 LLM 深度集成,目前仅在开源模型与本地部署场景中显现潜力,在实际应用中存在一定局限性。对于企业级应用,传统 RAG 在精确检索上仍具不可替代性。

多模态 RAG(MM-RAG)的困境

尽管多模态 RAG(MM-RAG)被视为重要趋势,但 2025 年的发展仍受制于基础设施瓶颈:

多模态 RAG 的发展面临着诸多挑战,其中核心障碍是基础设施的不成熟。多模态数据(如图像)的向量表示使得存储需求激增,例如,单张图像可能需要 1024 个 128 维向量表示,导致存储需求最高增加两个数量级,给数据存储和管理带来了巨大压力,成为商业化落地的首要障碍。

为缓解这一问题,行业内提出了多种解决方案:

- 在数据库层面,通过二进制量化将存储需求压缩至 1/32,配合量化向量索引与重排序器补偿精度损失;

- 在模型层面,则通过降维(如 64 维向量)、向量合并(如 1024→128 个补丁)减少数据量,但会牺牲部分召回准确性。

然而,这些方案只是权宜之计,多模态 RAG 的实际应用仍依赖于基础设施的完善和升级。

3、RAG 的现状与未来趋势

2025 年的 RAG 技术正处于典型的 "平台期"—— 核心突破有限,更多是增量改进。但这种平静背后,是 RAG 在 AI 架构中定位的悄然升级:

互补性

智能体的强大离不开 RAG 的记忆支撑,而 RAG 的进化也需要智能体的推理赋能。

RAG 与智能体之间存在着紧密的相互依赖关系。RAG 为智能体提供了长期记忆和非结构化数据管理能力,是智能体高效运行的基础;而智能体则通过反思机制,显著提升了 RAG 的推理效率。二者相辅相成,缺一不可,共同推动着 AI 技术在实际场景中的应用。

未来方向

- 从工具到架构层的跃迁:随着智能体应用的普及,RAG 不再是孤立的检索工具,而是成为连接非结构化数据与智能体系统的关键架构层。企业级智能体的落地,几乎离不开 RAG 提供的长期记忆支撑。

- 与 LLM 推理引擎的深度融合:稀疏注意力机制的探索(如将 KV 缓存与数据库技术结合),预示着 RAG 与 LLM 推理引擎的边界将逐渐模糊,形成 "检索即推理" 的新范式。

- 基础设施的协同进化:长文本处理的精准化、多模态存储的轻量化、智能体记忆的高效化,将推动 RAG 从 "检索增强生成" 向 "知识驱动决策" 升级。

4、总结

2025 年过去这半年中,RAG 虽然没有出现颠覆性的技术突破,但它与智能体的协同已成为核心发展方向。在企业级应用中,RAG 作为智能体长期记忆的基础,具有不可替代的作用。而 RAG 技术瓶颈的突破,并非一蹴而就,需要依赖基础设施与模型的共同进化和发展。我们有理由相信,随着技术的不断进步,RAG 将在 AI 领域发挥更加重要的作用,为各行各业带来更多创新和价值。