改写样本(Rephrased Samples)

13B模型全方位碾压GPT-4?这背后有什么猫腻

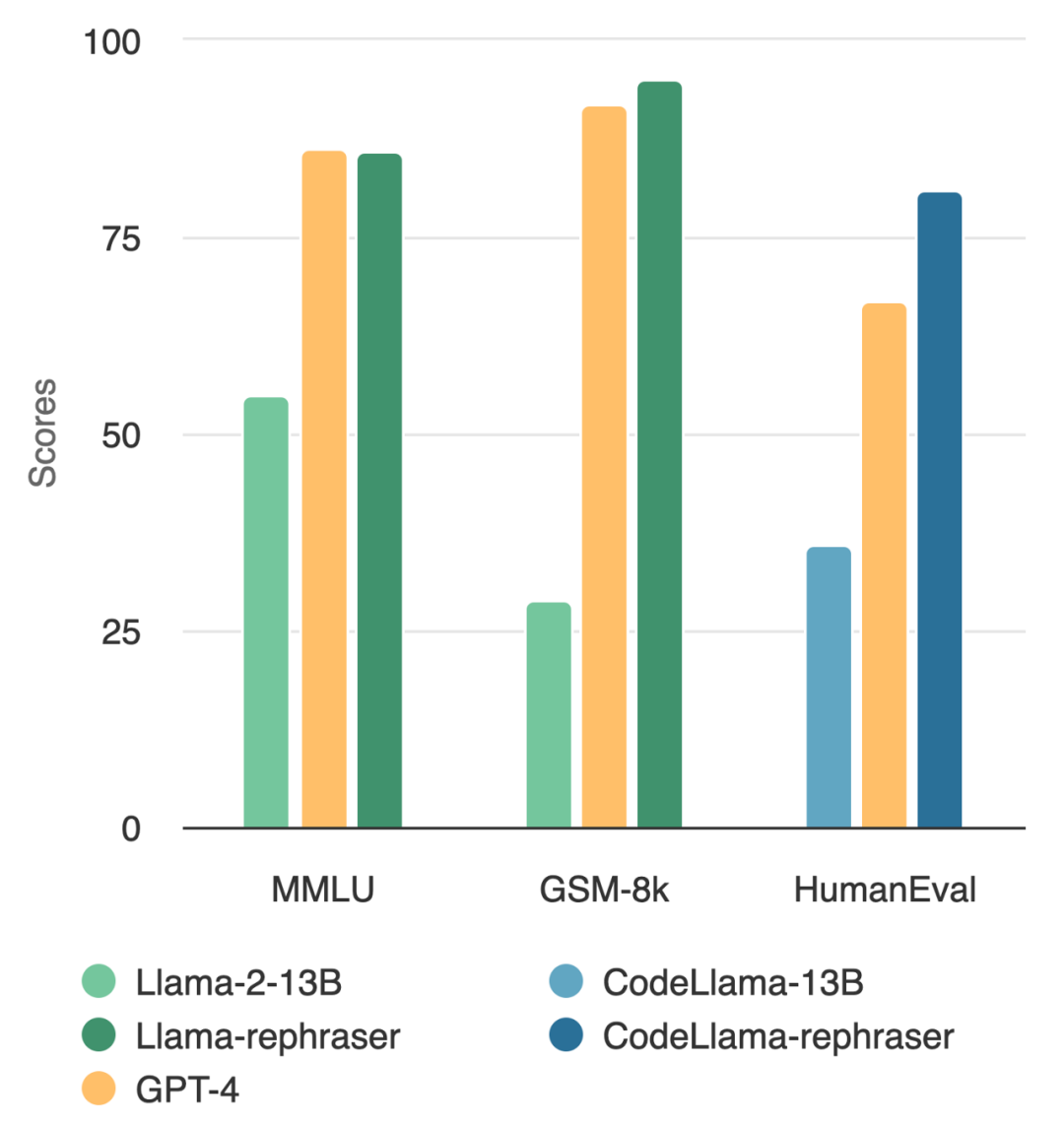

你的测试集信息在训练集中泄漏了吗?一个参数量为 13B 的模型竟然打败了顶流 GPT-4?就像下图所展示的,并且为了确保结果的有效性,这项测试还遵循了 OpenAI 的数据去污方法,更关键的是没有发现数据污染的证据。如果你细细查看图中的模型,发现只要带有「rephraser」这个单词,模型性能都比较高。这背后到底有何猫腻?原来是数据污染了,即测试集信息在训练集中遭到泄漏,而且这种污染还不易被检测到。尽管这一问题非常关键,但理解和检测污染仍然是一个开放且具有挑战性的难题。现阶段,去污最常用的方法是 n-gram 重叠

11/18/2023 10:24:00 AM

机器之心

- 1

资讯热榜

标签云

人工智能

AI

OpenAI

AIGC

模型

ChatGPT

DeepSeek

AI绘画

谷歌

数据

机器人

大模型

Midjourney

用户

智能

开源

微软

Meta

GPT

学习

图像

技术

Gemini

AI创作

马斯克

论文

代码

Anthropic

英伟达

算法

Stable Diffusion

芯片

智能体

训练

开发者

生成式

腾讯

蛋白质

苹果

AI新词

神经网络

3D

研究

生成

Claude

LLM

机器学习

计算

Sora

AI设计

GPU

AI for Science

AI视频

人形机器人

xAI

华为

百度

搜索

大语言模型

场景

Agent

字节跳动

预测

深度学习

伟达

工具

大型语言模型

Transformer

视觉

RAG

神器推荐

具身智能

模态

Copilot

亚马逊

LLaMA

文本

算力

驾驶

AGI